В прогнозных расчётах по уравнению регрессии определяется то, что уравнение не является реальным , для есть ещё стандартная ошибка . Поэтому интервальная оценка прогнозного значения

Выразим из уравнения ![]()

То есть стандартная ошибка зависит и ошибки коэффициента регрессии b,

Из теории выборки известно, что . Используя в качестве оценки остаточную дисперсию на одну степень свободы , получим формулу расчёта ошибки среднего значения переменной y: .

Ошибка коэффициента регрессии:  .

.

В прогнозных расчетах по уравнению регрессии определяется уравнение как точечный прогноз при , то есть путём подстановки в уравнение регрессии  . Однако точечный прогноз явно нереален.

. Однако точечный прогноз явно нереален.

- формула стандартной ошибки предсказываемого значения y при заданных , характеризует ошибку положения линии регрессии. Величина стандартной ошибки , достигает min при , и возрастает по мере того, как «удаляется» от в любом направлении. То есть чем больше разность между и x, тем больше ошибка , с которой предсказывается среднее значение y для заданного значения .

- формула стандартной ошибки предсказываемого значения y при заданных , характеризует ошибку положения линии регрессии. Величина стандартной ошибки , достигает min при , и возрастает по мере того, как «удаляется» от в любом направлении. То есть чем больше разность между и x, тем больше ошибка , с которой предсказывается среднее значение y для заданного значения .

Можно ожидать наилучшие результаты прогноза, если признак - фактор x находится в центре области наблюдений х и нельзя ожидать хороших результатов прогноза при удалении от .

Если же значение оказывается за пределами наблюдаемых значений х, используемых при построении ЛР, то результаты прогноза ухудшаются в зависимости то того, насколько отклоняется от области наблюдаемых значений фактора х. Доверит. интервалы при .

На графике доверительной границы представляет собой гиперболы, расположенные по обе стороны от линии регрессии.

Две гиперболы по обе стороны от ЛР определяют 95%-ные доверительные интервалы для среднего значения y при заданном значении x.

Однако фактические значения y варьируют около среднего значения . Индивидуальные значения y могут отклоняться от на величину случайной ошибки , дисперсия которой оценивается как остаточная дисперсия на одну степень свободы . Поэтому ошибка предсказываемого индивидуального значения y должна включать не только стандартную ошибку , но и случайную ошибку.

Средняя ошибка прогнозируемого индивидуального значения y составит:

.

.

При прогнозировании на основе УР следует помнить, что величина прогноза зависит не только от стандартной ошибки индивидуального значения y, но и от точности прогноза значений фактора x.

Его величина может задаваться на основе анализа других моделей исходя из конкретной ситуации, а также из анализа динамики данного фактора.

Рассмотренная формула средней ошибки индивидуального значения признака y() может быть использована также для оценки существенности различия предсказываемого значения исходя из регрессионной модели и выдвинутой гипотезы развития событий.

Понятие о множественной регрессии. Классическая линейная модель множественной регрессии (КЛММР). Определение параметров уравнения множественной регрессии методом наименьших квадратов.

Парная регрессия используется при моделировании, если влияние других факторов, воздействующих на объект исследования можно пренебречь.

Например, при построении модели потребления того или иного товара от дохода исследователь предполагает, что в каждой группе дохода одинаково влияние на потребление таких факторов, как цена товара, размер семьи, ее состав. Однако, уверенности в справедливости данного утверждения нет.

Прямой путь решения такой задачи состоит в отборе единиц совокупности с одинаковыми значениями всех других факторов, кроме дохода. Он приводит к планированию эксперимента – метод, который используется в естественно-научных исследованиях. Экономист лишен возможности регулировать другие факторы. Поведение отдельных экономических переменных контролировать нельзя, т.е. не удается обеспечить равенство прочих условий для оценки влияния одного исследуемого фактора.

Как поступить в этом случае? Надо выявить влияние других факторов, введя их в модель, т.е. построить уравнение множественной регрессии.

такого рода уравнения используется при изучении потребления.

Коэффициенты b j – частные производные у по факторами х i

![]() при условии, что все остальные х i = const

при условии, что все остальные х i = const

Рассмотрим современную потребительскую функцию (впервые 30е годы предложил Кейнс Дж.М.) как модель вида С = f(y,P,M,Z)

c- потребление. у – доход

P – цена, индекс стоимости.

M – наличные деньги

Z – ликвидные активы

При этом

Множественная регрессия широко используется в решении проблем спроса, доходности акций, при изучении функций издержек производства, в макроэкономических вопросах и других вопросах эконометрики.

В настоящее время множественная регрессия – один из наиболее распространенных методов в эконометрике.

Основная цель множественной регрессии – построить модель с большим числом факторов, определив при этом влияние каждого их них в отдельности, а также совокупное воздействие на моделируемый показатель.

Построение уравнения множественной регрессии начинается с решения вопроса о спецификации модели. Она включает в себя 2 круга вопросов:

1. отбор факторов

2. выбор уравнения регрессии.

Включение в уравнение множественной регрессии того или иного набора факторов связано с представлением исследователя о природе взаимосвязи моделируемого показателя с другими экономическими явлениями. Требования к факторам, включаемым во множественную регрессию

1. они должны быть количественно измеримы, если необходимо включить в модель качественный фактор, не имеющий количественного измерения, то ему нужно придать количественную определенность (например, в модели урожайности качество почвы задается в виде баллов; в модели стоимости объектов недвижимости: районы должны быть проранжированы).

2. факторы не должны быть интеркоррелированы и тем более находиться в точной функциональной связи.

Включение в модель факторов с высокой интеркорреляцией, когда R у x 1 Если между факторами существует высокая корреляция, то нельзя определить их изолированное влияние на результативный показатель и параметры уравнения регрессии оказываются интерпретируемыми. В уравнение предполагается, что факторы х 1 и х 2 независимы друг от друга, r х1х2 = 0, тогда параметр b1 измеряет силу влияния фактора х 1 на результат у при неизменном значении фактора х 2 . Если r х1х2 =1, то с изменением фактора х 1 фактор х 2 не может оставаться неизменным. Отсюда b 1 и b 2 нельзя интерпретировать как показатели раздельного влияния х 1 и х 2 и на у. Пример, рассмотрим регрессию себестоимости единицы продукции у (руб.) от заработной платы работника х (руб.) и производительности труда z (ед. в час). у = 22600 - 5x - 10z + e коэффициент b 2 = -10, показывает, что с ростом производительности труда на 1 ед. себестоимость единицы продукции снижается на 10 руб. при постоянном уровне оплаты. Вместе с тем параметр при х нельзя интерпретировать как снижение себестоимости единицы продукции за счет роста заработной платы. Отрицательное значение коэффициента регрессии при переменной х обусловлено высокой корреляцией между х и z (r х z = 0,95). Поэтому роста заработной платы при неизменности производительности труда (не учитывая инфляции) быть не может. Включенные во множественную регрессию факторы должны объяснить вариацию независимой переменной. Если строиться модель с набором р факторов, то для нее рассчитывается показатель детерминации R 2 , которая фиксирует долю объясненной вариации результативного признака за счет рассматриваемых в регрессии р факторов. Влияние других неучтенных в модели факторов оценивается как 1-R 2 c соответствующей остаточной дисперсией S 2 . При дополнительном включении в регрессию р+1 фактора коэффициент детерминации должен возрастать, а остаточная дисперсия уменьшается. R 2 p +1 >= R 2 p и S 2 p +1 <= S 2 p Если же этого не происходит и данные показатели практически мало отличаются друг от друга, то включенный в анализ фактор x р+1 не улучшает модель и практически является лишним фактором. Если для регрессии, включающей 5 факторов R 2 = 0,857, и включенный 6 дало R 2 = 0,858, то нецелесообразно включать в модель этот фактор. Насыщение модели лишними факторами не только не снижает величину остаточной дисперсии и не увеличивает показатель детерминации, но и приводит к статистической не значимости параметров регрессии по критерию t-Стьюдента. Таким образом, хотя теоретически регрессионная модель позволяет учесть любое число факторов, практически в этом нет необходимости. Отбор факторов производиться на основе теоретико-экономического анализа. Однако, он часто не позволяет однозначно ответить на вопрос о количественной взаимосвязи рассматриваемых признаков и целесообразности включения фактора в модель. Поэтому отбор факторов осуществляется в две стадии: на первой – подбирают факторы, исходя из сущности проблемы. на второй – на основе матрицы показателей корреляции определяют t-статистики для параметров регрессии. Коэффициенты интеркоррелиции (т.е. корреляция между объясняющими переменными) позволяют исключить из моделей дублирующие факторы. Считается, что две переменные явно коллинеарны, т.е. находятся между собой в линейной зависимости, если r х i х j >=0.7. Поскольку одним из условий построения уравнения множественной регрессии является независимость действия факторов, т.е. Rх i x j = 0, коллинеарность факторов нарушает это условие. Если факторы явно коллинеарны, то они дублируют друг друга и один из них рекомендуется исключить из регрессии. Предпочтение при этом отдается не фактору, более тесно связанному с результатом, а тому фактору, который при достаточно тесной связи с результатом имеет наименьшую тесноту связи с другими факторами. В этом требовании проявляется специфика множественной регрессии как метода исследования комплексного воздействия факторов в условиях их независимости друг от друга. Рассмотрим матрицу парных коэффициентов корреляции при изучении зависимости у = f(x, z, v) Очевидно, факторы x и z дублируют друг друга. В анализ целесообразно включит фактор z, а не х, так как корреляция z с у слабее чем корреляция фактора х с у (r у z < r ух), но зато слабее межфакторная корреляция (r zv < r х v) Поэтому в данном случае в уравнение множественной регрессии включает факторы z и v По величине парных коэффициентов корреляции обнаруживается лишь явная коллинеарность факторов. Но наиболее трудности возникают при наличии мультиколлинеарности факторов, когда более чем два фактора связаны между собой линейной зависимостью, т.е. имеет место совокупное воздействие факторов друг на друга. Наличие мультиколлинеарности факторов может означать, что некоторые факторы будут всегда действовать в унисон. В результате вариация в исходных данных перестает быть полностью независимой, и нельзя оценить воздействие каждого фактора в отдельности. Чем сильнее мультиколлинеарности факторов, тем менее надежна оценка распределения суммы объясненной вариации по отдельным факторам с помощью МНК. Если рассмотренная регрессия у = a + bx + cx + dv + e, то для расчета параметров, применяется МНК общая сумма = факторная + остаточная

В прогнозных расчетах по уравнению регрессии определяется предсказываемое (y p

) значение как точечный прогноз при x p = x k

, т.е. путем подстановки в уравнение регрессии соответствующего значения x

. Однако точечный прогноз явно не реален. Поэтому он дополняется расчетом стандартной ошибки , т.е. и соответственно, интервальной оценкой прогнозного значения: Чтобы понять, как строится формула для определения величин стандартной ошибки , обратимся к уравнению линейной регрессии: . Подставим в это уравнение выражение параметра a

: тогда уравнение регрессии примет вид: Отсюда вытекает, что стандартная ошибка зависит от ошибки y

и ошибки коэффициента регрессии b

, т.е. Из теории выборки известно, что Ошибка коэффициента регрессии, как уже было показано, определяется формулой: Считая, что прогнозное значение фактора x p = x k

, получим следующую формулу расчета стандартной ошибки предсказываемого по линии регрессии значения, т.е. : Соответственно имеет выражение: Рассмотренная формула стандартной ошибки предсказываемого среднего значения y

при заданном значении x k

характеризует ошибку положения линии регрессии. Величина стандартной ошибки , как видно из формулы, достигает минимума при , и возрастает по мере того, как "удаляется" от в любом направлении. Иными словами, чем больше разность между x k

и x

, тем больше ошибка , с которой предсказывается среднее значение y

для заданного значения x k

. Можно ожидать наилучшие результаты прогноза, если признак-фактор x

находится в центре области наблюдений x

и нельзя ожидать хороших результатов прогноза при удалении x k

от . Если же значение x k

оказывается за пределами наблюдаемых значений x

, используемых при построении линейной регрессии, то результаты прогноза ухудшаются в зависимости от того, насколько x k

отклоняется от области наблюдаемых значений фактора x

. На графике доверительные границы для представляют собой гиперболы, расположенные по обе стороны от линии регрессии (рис. 1.5). Рис. 1.5 показывает, как изменяются пределы в зависимости от изменения x k

: две гиперболы по обе стороны от линии регрессии определяют 95% -ые доверительные интервалы для среднего значения y

при заданном значении x

. Однако фактические значения y

варьируют около среднего значения . Индивидуальные значения y

могут отклоняться от на величину случайной ошибки e

, дисперсия которой оценивается как остаточная дисперсия на одну степень свободы S 2

. Поэтому ошибка предсказываемого индивидуального значения y

должна включать не только стандартную ошибку , но и случайную ошибку S

. Средняя ошибка прогнозируемого индивидуального значения y

составит: При прогнозировании на основе уравнения регрессии следует помнить, что величина прогноза зависит не только от стандартной ошибки индивидуального значения y

, но и от точности прогноза значения фактора x

. Его величина может задаваться на основе анализа других моделей, исходя из конкретной ситуации, а также анализа динамики данного фактора. Рассмотренная формула средней ошибки индивидуального значения признака y

() может быть использована также для оценки существенности различия предсказываемого значения, исходя из регрессионной модели и выдвинутой гипотезы развития событий. Оценка статистической значимости параметров регрессии проводится с помощью t-статистики Стьюдента и путем расчета доверительного интервала для каждого из показателей. Выдвигается гипотеза Н 0 о статистически значимом отличие показателей от 0 a = b = r = 0. Рассчитываются стандартные ошибки параметров a,b, r и фактическое значение t-критерия Стьюдента. Определяется статистическая значимость параметров. t a > T табл - параметр a статистически значим. t b > T табл - параметр b статистически значим. Находятся границы доверительных интервалов. Анализ верхней и нижней границ доверительных интервалов приводит к выводу о том, что параметры a и b находясь в указанных границах не принимают нулевых значений, т.е. не является статистически незначимыми и существенно отличается от 0. Магнус Я.Р., Катышев П.К., Пересецкий А.А. Эконометрика. - М.: Дело, 2001. - С. 45. Если между экономическими явлениями существуют нелинейные соотношения, то они выражаются с помощью соответствующих нелинейных функций: например, равносторонней гиперболы, параболы второй степени и д.р. Различают два класса нелинейных регрессий: Примером нелинейной регрессии по включаемым в нее объясняющим переменным могут служить следующие функции: полиномы разных степеней; равносторонняя гипербола. К нелинейным регрессиям по оцениваемым параметрам относятся функции: степенная; показательная; экспоненциальная. Нелинейная регрессия по включенным переменным не таит каких-либо сложностей в оценке ее параметров. Она определяется, как и в линейной регрессии, методом наименьших квадратов (МНК), ибо эти функции линейны по параметрам. Так, в параболе второй степени y=a 0 +a 1 x+a 2 x 2 +е заменяя переменные x=x 1 ,x 2 =x 2 , получим двухфакторное уравнение линейной регрессии: у=а 0 +а 1 х 1 +а 2 х 2 + е. Парабола второй степени целесообразна к применению, если для определенного интервала значений фактора меняется характер связи рассматриваемых признаков: прямая связь меняется на обратную или обратная на прямую. В этом случае определяется значение фактора, при котором достигается максимальное (или минимальное), значение результативного признака: приравниваем к нулю первую производную параболы второй степени: , т.е. b+2cx=0 и x=-b/2c. Применение МНК для оценки параметров параболы второй степени приводит к следующей системе нормальных уравнений: Решение ее возможно методом определителей: В моделях, нелинейных по оцениваемым параметрам, но приводимых к линейному виду, МНК применяется к преобразованным уравнениям. Если в линейной модели и моделях, нелинейных по переменным, при оценке параметров исходят из критерия min, то в моделях, нелинейных по оцениваемым параметрам, требование МНК применяется не к исходным данным результативного признака, а к их преобразованным величинам, т.е. ln y, 1/y. Так, в степенной функции МНК применяется к преобразованному уравнению lny = lnб + в ln x ln е. Это значит, что оценка параметров основывается на минимизации суммы квадратов отклонений в логарифмах. Соответственно если в линейных моделях то в моделях, нелинейных по оцениваемым параметрам, . Вследствие этого оценка параметров оказываются несколько смещенной. Уравнение нелинейной регрессии, так же как и в линейной зависимости, дополняется показателем корреляции, а именно индексом корреляции (R): Величина данного показателя находится в границах: 0 ? R ? 1, чем ближе к 1, тем теснее связь рассматриваемых признаков, тем более надежно найденное уравнение регрессии. Индекс детерминации используется для проверки существенности в целом урпвнения нелинейной регрессии по F- критерию Фишера: Данный способ расчета наиболее обоснован теоретически и дает самые точные результаты в практическом применении. Но дело осложняется рядом обстоятельств. Во-первых, качество большинства видов продукции, а, следовательно, и его уровень формируются чаще не одним, а несколькими свойствами, причем значимость их в формировании полезности различна. Встает сложная проблема определения их значимости. Во-вторых, полезность продукта находится чаще в нелинейной зависимости от значения свойств (частных качественных характеристик), а это означает непостоянство их значимости. Указанные сложности преодолимы, но не всегда. Теснота связи между переменными величинами может иметь различные значения, если рассматривать ее с позиции характера зависимости (линейная, нелинейная). Если установлена слабая связь между переменными в линейной зависимости, то это совсем не означает, что такая связь должна быть в нелинейной зависимости. Показателем, характеризующим значимость факторов при различной форме связи, является корреляционное отношение. Оценка факторов по корреляционному отношению уже на этом этапе анализа позволяет предварительно уст0новить вид многофакторной связи, что служит хорошей предпосылкой при выборе конкретной модели исследуемого показателя. В случае нелинейной зависимости линейный коэффициент корреляции теряет смысл, и для измерения тесноты связи применяют так называемое корреляционное отношение, известное также под названием «индекс корреляции»: Для нахождения лучшей подстановки можно использовать визуальный метод, когда «на глаз» определяется вид нелинейной зависимости, связывающей результирующий параметр и независимый фактор, а можно выбор наилучшей замены осуществлять, используя коэффициент корреляции. Та подстановка, у которой коэффициент корреляции является максимальным, и является наилучшей. Ланге О. Введение в эконометрику. - М.: Прогресс, 1964. - С. 76. Пусть требуется

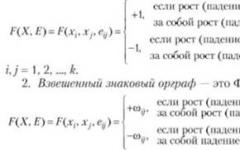

оценить прогнозное значение

признака-результата для заданного

значения признака-фактора . Прогнозируемое

значение признака-результата с

доверительной вероятностью равной

(1-a) принадлежит интервалу прогноза: где -

точечный

прогноз; t

-

коэффициент

доверия, определяемый по таблицам

распределения Стьюдента в зависимости

от уровня значимости a и числа

степеней свободы (n-2); Средняя ошибка прогноза. Точечный прогноз

рассчитывается по линейному уравнению

регрессии: Средняя ошибка

прогноза в свою очередь: Фактическое значение

результативного признака y отличается

от теоретических значений ,

рассчитанных по уравнению регрессии.

Чем меньше это отличие, тем ближе

теоретические значения подходят к

эмпирическим, и лучше качество модели. Величина отклонений

фактических и расчетных значений

результативного признака по

каждому наблюдению представляет

собойошибку

аппроксимации

. Поскольку может

быть как величиной положительной, так

и отрицательной, то ошибки аппроксимации

для каждого наблюдения принято определять

в процентах по модулю. Отклонения можно

рассматривать как абсолютную ошибку

аппроксимации, а-

как относительную ошибку аппроксимации. Чтобы иметь общее

суждение о качестве модели из относительных

отклонений по каждому наблюдению

определяют среднюю ошибку аппроксимации: Возможно и иное

определение средней ошибки аппроксимации: Если А£10-12%, то можно

говорить о хорошем качестве модели. Уравнение нелинейной

регрессии, так же как и в линейной

зависимости, дополняется показателем

корреляции, а именно индексом

корреляции

(R): Величина данного

показателя находится в границах: 0 ≤ R

≤

1, чем ближе к единице, тем теснее связь

рассматриваемых признаков, тем более

надежно найденное уравнение регрессии. Поскольку в расчете

индекса корреляции используется

соотношение факторной и общей суммы

квадратов отклонений, то R2

имеет

тот же смысл, что и коэффициент

детерминации. В специальных

исследованиях величину R2

для

нелинейных связей называют индексом

детерминации

. Оценка существенности

индекса корреляции проводится, так же

как и оценка надежности коэффициента

корреляции. Индекс детерминации

используется для проверки существенности

в целом уравнения нелинейной регрессии

по F-критерию

Фишера

: где R2

-

индекс

детерминации; n

-

число наблюдений; т

-

число параметров при переменных х.

Величина т

характеризует

число степеней свободы для факторной

суммы квадратов, а (n

- т

-

1) - число степеней свободы для остаточной

суммы квадратов. Индекс

детерминации R2yx

можно

сравнивать с коэффициентом детерминации r2yx

для обоснования возможности применения

линейной функции. Чем больше кривизна

линии регрессии, тем величина коэффициента

детерминации r2yx

меньше

индекса детерминации R2yx.

Близость

этих показателей означает, что нет

необходимости усложнять форму уравнения

регрессии и можно использовать линейную

функцию. Практически если величина (R2yx

- г2yx)

не

превышает 0,1, то предположение о линейной

форме связи считается оправданным. В

противном случае проводится оценка

существенности различия R2yx,

вычисленных

по одним и тем же исходным данным,

через t-критерий

Стьюдента

: где m|R

- r|

- ошибка

разности между R2yx

и r2yx

.

Если tфакт > tтабл

.,

то различия между рассматриваемыми

показателями корреляции существенны

и замена нелинейной регрессии уравнением

линейной функции невозможна. Практически

если величина t <

2

, то

различия между Ryx

и ryx

несущественны,

и, следовательно, возможно применение

линейной регрессии, даже если есть

предположения о некоторой нелинейности

рассматриваемых соотношений признаков

фактора и результата. Чтобы иметь общее

суждение о качестве модели из относительных

отклонений по каждому наблюдению,

определяют среднюю ошибку аппроксимации

как среднюю арифметическую простую. Ошибка аппроксимации

в пределах 5-7 % свидетельствует о хорошем

подборе модели к исходным данным. Если модель регрессии признана адекватной, то переходят к построению прогноза. Прогнозируемое значение переменной у

получается при подстановке в уравнение регрессии ожидаемой величины независимой переменной х прогн

: Данный прогноз называется точечным. Вероятность реализации точечного прогноза практически равна нулю, поэтому рассчитывается доверительный интервал прогноза с большой надежностью: где t

– t-критерий Стьюдента, определяемый по таблице при уровне значимости 0,05 и числе степеней свободы k=n-2 (для парной регрессии); – остаточная дисперсия на одну степень свободы, определяемая по формуле: s

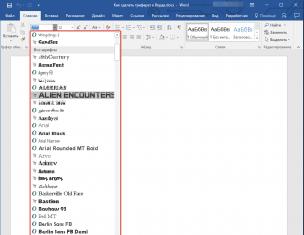

– стандартная ошибка предсказания, определяемая по формуле: По статистическим данным, описывающим зависимость удельного веса бракованной продукции от удельного веса рабочих со специальной подготовкой на предприятиях построить уравнение парной регрессии и определить его значимость. 1. Построим диаграмму рассеяния для определения наличия зависимости между признаками и типа этой зависимости. Диаграмма рассеяния или корреляционное поле показывает наличие линейной обратной связи. 2. Определим линейный коэффициент корреляции по формуле Линейный коэффициент корреляции будет равен: С помощью встроенной функции КОРРЕЛ Excel получаем такое же значение линейного коэффициента корреляции. Для этого в ячейку необходимо ввести =КОРРЕЛ(массив1; массив2), причем не имеет значения последовательность ввода массивов. Таким образом, делаем вывод о сильной обратной линейной зависимости между изучаемыми признаками. 2. Построим уравнение парной линейной регрессии . Оценим параметры уравнения регрессии а

и b

с помощью МНК. Для этого построим вспомогательную таблицу. Система нормальных уравнений для нахождения параметров парной линейной регрессии имеет вид: Подставим необходимые данные и получим: Решив систему, получим С помощью встроенной функции ЛИНЕЙН Excel получаем такие же значения параметров уравнения регрессии. Для этого необходимо выделить две ячейки в одной строке, выбрать в главном меню Вставка/Функция

, далее выбрать из категории Статистические

функцию ЛИНЕЙН

. В образовавшемся окне заполнить аргументы функции: Известные значения y

– диапазон, содержащий данные результативного признака; Известные значения x

– диапазон, содержащий данные факторного признака; Константа

– логическое значение, которое указывает на наличие или отсутствие свободного члена в уравнении регрессии, может принимать значение 0 или 1. Указываем 1. Статистика

– логическое значение, которое указывает, выводить дополнительную информацию по регрессионному анализу или нет. Если указать 0, будут выведены только значения параметров уравнения регрессии а

и b

в двух выделенных ячейках. Чтобы вывести всю статистику по уравнению регрессии изначально необходимо выделить диапазон из пяти строк и двух столбцов и задать логическое значение 1 в аргументе функции ЛИНЕЙН Статистика

. Дополнительная регрессионная статистика будет выводится в порядке, указанном в следующей схеме: Для разбираемого примера таблица будет выглядеть следующим образом: Таким образом, уравнение регрессии будет иметь вид: t-критерий Стьюдента для параметра а будет равен Т.к. коэффициент детерминации , коэффициент корреляции равен Расчетное значение F-критерия Фишера равно 73,46, табличное значение F-критерия Фишера равно 6,61. Поскольку расчетное значение F-критерия больше табличного или критического, уравнение парной линейной регрессии в целом признается статистически значимым с вероятностью 95%. t-критерий Стьюдента для линейного коэффициента корреляции определяется по формуле: ![]() S y = S факт +S e

S y = S факт +S e . Используя в качестве оценки s 2

остаточную дисперсию на одну степень свободы S 2

, получим формулу расчета ошибки среднего значения переменной y

:

. Используя в качестве оценки s 2

остаточную дисперсию на одну степень свободы S 2

, получим формулу расчета ошибки среднего значения переменной y

: .

. . (1.26)

. (1.26)

. (1.27)

. (1.27)

Нелинейная регрессия

![]()

![]()

![]()

![]()

![]()

![]() .

.

10.Средняя ошибка аппроксимации

![]()

12.Корреляция и детерминация для нелинейной регрессии.

или

или

![]()

;

; .

.

![]() . Для этого построим вспомогательную таблицу:

. Для этого построим вспомогательную таблицу: Номер предприя-тия

Удельный вес рабочих со специальной подготовкой, %

х

Удельный вес бракован-ной продукции, %

y

(x-xср)^2

(y-yср)^2

xy

857,6531

83,59184

371,9388

9,877551

86,22449

1,306122

0,510204

0,734694

114,7959

8,163265

429,0816

14,87755

661,2245

34,30612

Сумма

2521,429

152,8571

Среднее значение

44,28571

8,857143

360,2041

21,83673

306,4286

Номер

х

у

x^2

xy

Сумма

-0,23824

19,40793

0,027796

1,339265

0,936275

1,395765

73,46237

143,1163

9,740793

![]() .

.![]() . Табличное значение t-критерия Стьюдента составляет 2,57. Поскольку расчетное значение больше табличного параметр а признается статистически значимым.

. Табличное значение t-критерия Стьюдента составляет 2,57. Поскольку расчетное значение больше табличного параметр а признается статистически значимым.![]() . Поскольку , параметр b признается статистически значимым.

. Поскольку , параметр b признается статистически значимым.![]() и будет иметь отрицательное значение, поскольку связь обратная, на что указывает отрицательный коэффициент при х

в уравнении регрессии.

и будет иметь отрицательное значение, поскольку связь обратная, на что указывает отрицательный коэффициент при х

в уравнении регрессии. , что больше табличного значения, поэтому линейный коэффициент корреляции признается статистически значимым.

, что больше табличного значения, поэтому линейный коэффициент корреляции признается статистически значимым.