В прошлых статьях, на практических примерах, мной были показаны способы решения задач классификации (задача кредитного скоринга) и основ анализа текстовой информации (задача о паспортах). Сегодня же мне бы хотелось коснуться другого класса задач, а именно восстановления регрессии . Задачи данного класса, как правило, используются при прогнозировании .

Для примера решения задачи прогнозирования, я взял набор данных Energy efficiency из крупнейшего репозитория UCI . В качестве инструментов по традиции будем использовать Python c аналитическими пакетами pandas и scikit-learn .

Описание набора данных и постановка задачи

Дан набор данных , котором описаны следующие атрибуты помещения:В нем - характеристики помещения на основании которых будет проводиться анализ, а - значения нагрузки, которые надо спрогнозировать.

Предварительный анализ данных

Для начала загрузим наши данные и посмотрим на них:From pandas import read_csv, DataFrame

from sklearn.neighbors import KNeighborsRegressor

from sklearn.linear_model import LinearRegression, LogisticRegression

from sklearn.svm import SVR

from sklearn.ensemble import RandomForestRegressor

from sklearn.metrics import r2_score

from sklearn.cross_validation import train_test_split

dataset = read_csv("EnergyEfficiency/ENB2012_data.csv",";")

dataset.head()

| X1 | X2 | X3 | X4 | X5 | X6 | X7 | X8 | Y1 | Y2 | |

|---|---|---|---|---|---|---|---|---|---|---|

| 0 | 0.98 | 514.5 | 294.0 | 110.25 | 7 | 2 | 0 | 0 | 15.55 | 21.33 |

| 1 | 0.98 | 514.5 | 294.0 | 110.25 | 7 | 3 | 0 | 0 | 15.55 | 21.33 |

| 2 | 0.98 | 514.5 | 294.0 | 110.25 | 7 | 4 | 0 | 0 | 15.55 | 21.33 |

| 3 | 0.98 | 514.5 | 294.0 | 110.25 | 7 | 5 | 0 | 0 | 15.55 | 21.33 |

| 4 | 0.90 | 563.5 | 318.5 | 122.50 | 7 | 2 | 0 | 0 | 20.84 | 28.28 |

Теперь давайте посмотрим не связаны ли между собой какие-либо атрибуты. Сделать это можно рассчитав коэффициенты корреляции для всех столбцов. Как это сделать было описано в предыдущей статье :

Dataset.corr()

| X1 | X2 | X3 | X4 | X5 | X6 | X7 | X8 | Y1 | Y2 | |

|---|---|---|---|---|---|---|---|---|---|---|

| X1 | 1.000000e+00 | -9.919015e-01 | -2.037817e-01 | -8.688234e-01 | 8.277473e-01 | 0.000000 | 1.283986e-17 | 1.764620e-17 | 0.622272 | 0.634339 |

| X2 | -9.919015e-01 | 1.000000e+00 | 1.955016e-01 | 8.807195e-01 | -8.581477e-01 | 0.000000 | 1.318356e-16 | -3.558613e-16 | -0.658120 | -0.672999 |

| X3 | -2.037817e-01 | 1.955016e-01 | 1.000000e+00 | -2.923165e-01 | 2.809757e-01 | 0.000000 | -7.969726e-19 | 0.000000e+00 | 0.455671 | 0.427117 |

| X4 | -8.688234e-01 | 8.807195e-01 | -2.923165e-01 | 1.000000e+00 | -9.725122e-01 | 0.000000 | -1.381805e-16 | -1.079129e-16 | -0.861828 | -0.862547 |

| X5 | 8.277473e-01 | -8.581477e-01 | 2.809757e-01 | -9.725122e-01 | 1.000000e+00 | 0.000000 | 1.861418e-18 | 0.000000e+00 | 0.889431 | 0.895785 |

| X6 | 0.000000e+00 | 0.000000e+00 | 0.000000e+00 | 0.000000e+00 | 0.000000e+00 | 1.000000 | 0.000000e+00 | 0.000000e+00 | -0.002587 | 0.014290 |

| X7 | 1.283986e-17 | 1.318356e-16 | -7.969726e-19 | -1.381805e-16 | 1.861418e-18 | 0.000000 | 1.000000e+00 | 2.129642e-01 | 0.269841 | 0.207505 |

| X8 | 1.764620e-17 | -3.558613e-16 | 0.000000e+00 | -1.079129e-16 | 0.000000e+00 | 0.000000 | 2.129642e-01 | 1.000000e+00 | 0.087368 | 0.050525 |

| Y1 | 6.222722e-01 | -6.581202e-01 | 4.556712e-01 | -8.618283e-01 | 8.894307e-01 | -0.002587 | 2.698410e-01 | 8.736759e-02 | 1.000000 | 0.975862 |

| Y2 | 6.343391e-01 | -6.729989e-01 | 4.271170e-01 | -8.625466e-01 | 8.957852e-01 | 0.014290 | 2.075050e-01 | 5.052512e-02 | 0.975862 | 1.000000 |

Как можно заметить из нашей матрицы, коррелируют между собой следующие столбы (Значение коэффициента корреляции больше 95%):

- y1 --> y2

- x1 --> x2

- x4 --> x5

Как можно заметить и матрицы с коэффициентами корреляции на y1 ,y2 больше значения оказывают X2 и X5 , нежели X1 и X4, таким образом мы можем последние столбцы мы можем удалить.

Dataset = dataset.drop(["X1","X4"], axis=1)

dataset.head()

Помимо этого, можно заметить, что поля Y1

и Y2

очень тесно коррелируют между собой. Но, т. к. нам надо спрогнозировать оба значения мы их оставляем «как есть».

Выбор модели

Отделим от нашей выборки прогнозные значения:Trg = dataset[["Y1","Y2"]]

trn = dataset.drop(["Y1","Y2"], axis=1)

После обработки данных можно перейти к построению модели. Для построения модели будем использовать следующие методы:

Теорию о данным методам можно почитать в курсе лекций К.В.Воронцова по машинному обучению .

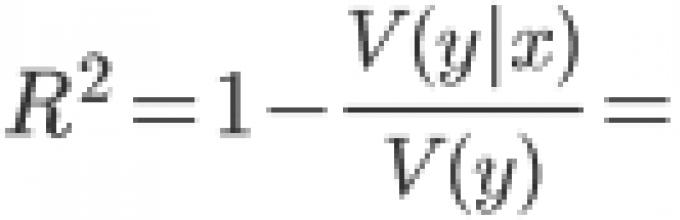

Оценку будем производить с помощью коэффициента детерминации (R-квадрат

). Данный коэффициент определяется следующим образом:

![]()

Где - условная дисперсия зависимой величины у

по фактору х

.

Коэффициент принимает значение на промежутке и чем он ближе к 1 тем сильнее зависимость.

Ну что же теперь можно перейти непосредственно к построению модели и выбору модели. Давайте поместим все наши модели в один список для удобства дальнейшего анализа:

Models =

Итак модели готовы, теперь мы разобьем наши исходные данные на 2 подвыборки: тестовую

и обучающую

. Кто читал мои предыдущие статьи знает, что сделать это можно с помощью функции train_test_split() из пакета scikit-learn:

Xtrn, Xtest, Ytrn, Ytest = train_test_split(trn, trg, test_size=0.4)

Теперь, т. к. нам надо спрогнозировать 2 параметра , надо построить регрессию для каждого из них. Кроме этого, для дальнейшего анализа, можно записать полученные результаты во временный DataFrame

. Сделать это можно так:

#создаем временные структуры

TestModels = DataFrame()

tmp = {}

#для каждой модели из списка

for model in models:

#получаем имя модели

m = str(model)

tmp["Model"] = m[:m.index("(")]

#для каждого столбцам результирующего набора

for i in xrange(Ytrn.shape):

#обучаем модель

model.fit(Xtrn, Ytrn[:,i])

#вычисляем коэффициент детерминации

tmp["R2_Y%s"%str(i+1)] = r2_score(Ytest[:,0], model.predict(Xtest))

#записываем данные и итоговый DataFrame

TestModels = TestModels.append()

#делаем индекс по названию модели

TestModels.set_index("Model", inplace=True)

Как можно заметить из кода выше, для расчета коэффициента используется функция r2_score().

Итак, данные для анализа получены. Давайте теперь построим графики и посмотрим какая модель показала лучший результат:

Fig, axes = plt.subplots(ncols=2, figsize=(10,4))

TestModels.R2_Y1.plot(ax=axes, kind="bar", title="R2_Y1")

TestModels.R2_Y2.plot(ax=axes, kind="bar", color="green", title="R2_Y2")

Анализ результатов и выводы

Из графиков, приведенных выше, можно сделать вывод, что лучше других с задачей справился метод RandomForest (случайный лес). Его коэффициенты детерминации выше остальных по обоим переменным:ля дальнейшего анализа давайте заново обучим нашу модель:

Model = models

model.fit(Xtrn, Ytrn)

При внимательном рассмотрении, может возникнуть вопрос, почему в предыдущий раз и делили зависимую выборку Ytrn

на переменные(по столбцам), а теперь мы этого не делаем.

Дело в том, что некоторые методы, такие как RandomForestRegressor

, может работать с несколькими прогнозируемыми переменными, а другие (например SVR

) могут работать только с одной переменной. Поэтому на при предыдущем обучении мы использовали разбиение по столбцам, чтобы избежать ошибки в процессе построения некоторых моделей.

Выбрать модель это, конечно же, хорошо, но еще неплохо бы обладать информацией, как каждый фактор влиет на прогнозное значение. Для этого у модели есть свойство feature_importances_

.

С помощью него, можно посмотреть вес каждого фактора в итоговой моделей:

Model.feature_importances_

array([ 0.40717901, 0.11394948, 0.34984766, 0.00751686, 0.09158358,

0.02992342])

В нашем случае видно, что больше всего на нагрузку при обогреве и охлаждении влияют общая высота и площадь. Их общий вклад в прогнозной модели около 72%.

Также необходимо отметить, что по вышеуказанной схеме можно посмотреть влияние каждого фактора отдельно на обогрев и отдельно на охлаждение, но т. к. эти факторы у нас очень тесно коррелируют между собой (), мы сделали общий вывод по ним обоим который и был написан выше.

Заключение

В статье я постарался показать основные этапы при регрессионном анализе данных с помощью Python и аналитческих пакетов pandas и scikit-learn .Необходимо отметить, что набор данных специально выбирался таким образом чтобы быть максимально формализованым и первичная обработка входных данных была бы минимальна. На мой взгляд статья будет полезна тем, кто только начинает свой путь в анализе данных, а также тем кто имеет хорошую теоретическую базу, но выбирает инструментарий для работы.

Регрессионный анализ — это статистический метод исследования, позволяющий показать зависимость того или иного параметра от одной либо нескольких независимых переменных. В докомпьютерную эру его применение было достаточно затруднительно, особенно если речь шла о больших объемах данных. Сегодня, узнав как построить регрессию в Excel, можно решать сложные статистические задачи буквально за пару минут. Ниже представлены конкретные примеры из области экономики.

Виды регрессии

Само это понятие было введено в математику в 1886 году. Регрессия бывает:

- линейной;

- параболической;

- степенной;

- экспоненциальной;

- гиперболической;

- показательной;

- логарифмической.

Пример 1

Рассмотрим задачу определения зависимости количества уволившихся членов коллектива от средней зарплаты на 6 промышленных предприятиях.

Задача. На шести предприятиях проанализировали среднемесячную заработную плату и количество сотрудников, которые уволились по собственному желанию. В табличной форме имеем:

Количество уволившихся | Зарплата |

||

30000 рублей |

|||

35000 рублей |

|||

40000 рублей |

|||

45000 рублей |

|||

50000 рублей |

|||

55000 рублей |

|||

60000 рублей |

Для задачи определения зависимости количества уволившихся работников от средней зарплаты на 6 предприятиях модель регрессии имеет вид уравнения Y = а 0 + а 1 x 1 +…+а k x k , где х i — влияющие переменные, a i — коэффициенты регрессии, a k — число факторов.

Для данной задачи Y — это показатель уволившихся сотрудников, а влияющий фактор — зарплата, которую обозначаем X.

Использование возможностей табличного процессора «Эксель»

Анализу регрессии в Excel должно предшествовать применение к имеющимся табличным данным встроенных функций. Однако для этих целей лучше воспользоваться очень полезной надстройкой «Пакет анализа». Для его активации нужно:

- с вкладки «Файл» перейти в раздел «Параметры»;

- в открывшемся окне выбрать строку «Надстройки»;

- щелкнуть по кнопке «Перейти», расположенной внизу, справа от строки «Управление»;

- поставить галочку рядом с названием «Пакет анализа» и подтвердить свои действия, нажав «Ок».

Если все сделано правильно, в правой части вкладки «Данные», расположенном над рабочим листом «Эксель», появится нужная кнопка.

в Excel

Теперь, когда под рукой есть все необходимые виртуальные инструменты для осуществления эконометрических расчетов, можем приступить к решению нашей задачи. Для этого:

- щелкаем по кнопке «Анализ данных»;

- в открывшемся окне нажимаем на кнопку «Регрессия»;

- в появившуюся вкладку вводим диапазон значений для Y (количество уволившихся работников) и для X (их зарплаты);

- подтверждаем свои действия нажатием кнопки «Ok».

В результате программа автоматически заполнит новый лист табличного процессора данными анализа регрессии. Обратите внимание! В Excel есть возможность самостоятельно задать место, которое вы предпочитаете для этой цели. Например, это может быть тот же лист, где находятся значения Y и X, или даже новая книга, специально предназначенная для хранения подобных данных.

Анализ результатов регрессии для R-квадрата

В Excel данные полученные в ходе обработки данных рассматриваемого примера имеют вид:

Прежде всего, следует обратить внимание на значение R-квадрата. Он представляет собой коэффициент детерминации. В данном примере R-квадрат = 0,755 (75,5%), т. е. расчетные параметры модели объясняют зависимость между рассматриваемыми параметрами на 75,5 %. Чем выше значение коэффициента детерминации, тем выбранная модель считается более применимой для конкретной задачи. Считается, что она корректно описывает реальную ситуацию при значении R-квадрата выше 0,8. Если R-квадрата<0,5, то такой анализа регрессии в Excel нельзя считать резонным.

Анализ коэффициентов

Число 64,1428 показывает, каким будет значение Y, если все переменные xi в рассматриваемой нами модели обнулятся. Иными словами можно утверждать, что на значение анализируемого параметра оказывают влияние и другие факторы, не описанные в конкретной модели.

Следующий коэффициент -0,16285, расположенный в ячейке B18, показывает весомость влияния переменной Х на Y. Это значит, что среднемесячная зарплата сотрудников в пределах рассматриваемой модели влияет на число уволившихся с весом -0,16285, т. е. степень ее влияния совсем небольшая. Знак «-» указывает на то, что коэффициент имеет отрицательное значение. Это очевидно, так как всем известно, что чем больше зарплата на предприятии, тем меньше людей выражают желание расторгнуть трудовой договор или увольняется.

Множественная регрессия

Под таким термином понимается уравнение связи с несколькими независимыми переменными вида:

y=f(x 1 +x 2 +…x m) + ε, где y — это результативный признак (зависимая переменная), а x 1 , x 2 , …x m — это признаки-факторы (независимые переменные).

Оценка параметров

Для множественной регрессии (МР) ее осуществляют, используя метод наименьших квадратов (МНК). Для линейных уравнений вида Y = a + b 1 x 1 +…+b m x m + ε строим систему нормальных уравнений (см. ниже)

Чтобы понять принцип метода, рассмотрим двухфакторный случай. Тогда имеем ситуацию, описываемую формулой

Отсюда получаем:

где σ — это дисперсия соответствующего признака, отраженного в индексе.

МНК применим к уравнению МР в стандартизируемом масштабе. В таком случае получаем уравнение:

в котором t y , t x 1, … t xm — стандартизируемые переменные, для которых средние значения равны 0; β i — стандартизированные коэффициенты регрессии, а среднеквадратическое отклонение — 1.

Обратите внимание, что все β i в данном случае заданы, как нормируемые и централизируемые, поэтому их сравнение между собой считается корректным и допустимым. Кроме того, принято осуществлять отсев факторов, отбрасывая те из них, у которых наименьшие значения βi.

Задача с использованием уравнения линейной регрессии

Предположим, имеется таблица динамики цены конкретного товара N в течение последних 8 месяцев. Необходимо принять решение о целесообразности приобретения его партии по цене 1850 руб./т.

номер месяца | название месяца | цена товара N |

|

1750 рублей за тонну |

|||

1755 рублей за тонну |

|||

1767 рублей за тонну |

|||

1760 рублей за тонну |

|||

1770 рублей за тонну |

|||

1790 рублей за тонну |

|||

1810 рублей за тонну |

|||

1840 рублей за тонну |

|||

Для решения этой задачи в табличном процессоре «Эксель» требуется задействовать уже известный по представленному выше примеру инструмент «Анализ данных». Далее выбирают раздел «Регрессия» и задают параметры. Нужно помнить, что в поле «Входной интервал Y» должен вводиться диапазон значений для зависимой переменной (в данном случае цены на товар в конкретные месяцы года), а в «Входной интервал X» — для независимой (номер месяца). Подтверждаем действия нажатием «Ok». На новом листе (если так было указано) получаем данные для регрессии.

Строим по ним линейное уравнение вида y=ax+b, где в качестве параметров a и b выступают коэффициенты строки с наименованием номера месяца и коэффициенты и строки «Y-пересечение» из листа с результатами регрессионного анализа. Таким образом, линейное уравнение регрессии (УР) для задачи 3 записывается в виде:

Цена на товар N = 11,714* номер месяца + 1727,54.

или в алгебраических обозначениях

y = 11,714 x + 1727,54

Анализ результатов

Чтобы решить, адекватно ли полученное уравнения линейной регрессии, используются коэффициенты множественной корреляции (КМК) и детерминации, а также критерий Фишера и критерий Стьюдента. В таблице «Эксель» с результатами регрессии они выступают под названиями множественный R, R-квадрат, F-статистика и t-статистика соответственно.

КМК R дает возможность оценить тесноту вероятностной связи между независимой и зависимой переменными. Ее высокое значение свидетельствует о достаточно сильной связи между переменными «Номер месяца» и «Цена товара N в рублях за 1 тонну». Однако, характер этой связи остается неизвестным.

Квадрат коэффициента детерминации R 2 (RI) представляет собой числовую характеристику доли общего разброса и показывает, разброс какой части экспериментальных данных, т.е. значений зависимой переменной соответствует уравнению линейной регрессии. В рассматриваемой задаче эта величина равна 84,8%, т. е. статистические данные с высокой степенью точности описываются полученным УР.

F-статистика, называемая также критерием Фишера, используется для оценки значимости линейной зависимости, опровергая или подтверждая гипотезу о ее существовании.

(критерий Стьюдента) помогает оценивать значимость коэффициента при неизвестной либо свободного члена линейной зависимости. Если значение t-критерия > t кр, то гипотеза о незначимости свободного члена линейного уравнения отвергается.

В рассматриваемой задаче для свободного члена посредством инструментов «Эксель» было получено, что t=169,20903, а p=2,89Е-12, т. е. имеем нулевую вероятность того, что будет отвергнута верная гипотеза о незначимости свободного члена. Для коэффициента при неизвестной t=5,79405, а p=0,001158. Иными словами вероятность того, что будет отвергнута верная гипотеза о незначимости коэффициента при неизвестной, равна 0,12%.

Таким образом, можно утверждать, что полученное уравнение линейной регрессии адекватно.

Задача о целесообразности покупки пакета акций

Множественная регрессия в Excel выполняется с использованием все того же инструмента «Анализ данных». Рассмотрим конкретную прикладную задачу.

Руководство компания «NNN» должно принять решение о целесообразности покупки 20 % пакета акций АО «MMM». Стоимость пакета (СП) составляет 70 млн американских долларов. Специалистами «NNN» собраны данные об аналогичных сделках. Было принято решение оценивать стоимость пакета акций по таким параметрам, выраженным в миллионах американских долларов, как:

- кредиторская задолженность (VK);

- объем годового оборота (VO);

- дебиторская задолженность (VD);

- стоимость основных фондов (СОФ).

Кроме того, используется параметр задолженность предприятия по зарплате (V3 П) в тысячах американских долларов.

Решение средствами табличного процессора Excel

Прежде всего, необходимо составить таблицу исходных данных. Она имеет следующий вид:

- вызывают окно «Анализ данных»;

- выбирают раздел «Регрессия»;

- в окошко «Входной интервал Y» вводят диапазон значений зависимых переменных из столбца G;

- щелкают по иконке с красной стрелкой справа от окна «Входной интервал X» и выделяют на листе диапазон всех значений из столбцов B,C, D, F.

Отмечают пункт «Новый рабочий лист» и нажимают «Ok».

Получают анализ регрессии для данной задачи.

Изучение результатов и выводы

«Собираем» из округленных данных, представленных выше на листе табличного процессора Excel, уравнение регрессии:

СП = 0,103*СОФ + 0,541*VO - 0,031*VK +0,405*VD +0,691*VZP - 265,844.

В более привычном математическом виде его можно записать, как:

y = 0,103*x1 + 0,541*x2 - 0,031*x3 +0,405*x4 +0,691*x5 - 265,844

Данные для АО «MMM» представлены в таблице:

Подставив их в уравнение регрессии, получают цифру в 64,72 млн американских долларов. Это значит, что акции АО «MMM» не стоит приобретать, так как их стоимость в 70 млн американских долларов достаточно завышена.

Как видим, использование табличного процессора «Эксель» и уравнения регрессии позволило принять обоснованное решение относительно целесообразности вполне конкретной сделки.

Теперь вы знаете, что такое регрессия. Примеры в Excel, рассмотренные выше, помогут вам в решение практических задач из области эконометрики.

I have a big bookshelf including many books divided in many varieties. On the top shelf are religious books like Fiqh books, Tauhid books, Tasawuf books, Nahwu books, etc. They are lined up neatly in many rows and some of them are lined up neatly according to the writers. On the second level are my studious books like Grammar books, Writing books, TOEFL books, etc. These are arranged based on the sizes. On the next shelf are many kinds of scientific and knowledgeable books; for example, Philosophies, Politics, Histories, etc. There are three levels for these. Eventually, in the bottom of my bookshelf are dictionaries, they are Arabic dictionaries and English dictionaries as well as Indonesian dictionaries. Indeed, there are six levels in my big bookshelf and they are lined up in many rows. The first level includes religious books, the second level includes my studious books, the third level having three levels includes many kinds of scientific and knowledgeable books and the last level includes dictionaries. In short, I love my bookshelf.

Specific-to-general order

The skills needed to write range from making the appropriate graphic marks, through utilizing the resources of the chosen language, to anticipating the reactions of the intended readers. The first skill area involves acquiring a writing system, which may be alphabetic (as in European languages) or nonalphabetic (as in many Asian languages). The second skill area requires selecting the appropriate grammar and vocabulary to form acceptable sentences and then arranging them in paragraphs. Third, writing involves thinking about the purpose of the text to be composed and about its possible effects on the intended readership. One important aspect of this last feature is the choice of a suitable style. Unlike speaking, writing is a complex sociocognitive process that has to be acquired through years of training or schooling. (Swales and Feak, 1994, p. 34)

General-to-specific order

"Working part-time as a cashier at the Piggly Wiggly has given me a great opportunity to observe human behavior. Sometimes I think of the shoppers as white rats in a lab experiment, and the aisles as a maze designed by a psychologist. Most of the rats--customers, I mean--follow a routine pattern, strolling up and down the aisles, checking through my chute, and then escaping through the exit hatch. But not everyone is so dependable. My research has revealed three distinct types of abnormal customer: the amnesiac, the super shopper, and the dawdler. . ."

There are many factors that contribute to student success in college. The first factor is having a goal in mind before establishing a course of study. The goal may be as general as wanting to better educate oneself for the future. A more specific goal would be to earn a teaching credential. A second factor related to student success is self-motivation and commitment. A student who wants to succeed and works towards this desire will find success easily as a college student. A third factor linked to student success is using college services. Most beginning college students fail to realize how important it can be to see a counselor or consult with a librarian or financial aid officer.

There are three reasons why Canada is one of the best countries in the world. First, Canada has an excellent health care service. All Canadians have access to medical services at a reasonable price. Second, Canada has a high standard of education. Students are taught be well-trained teachers and are encouraged to continue studying at university. Finally, Canada’s cities are clean and efficiently organized. Canadian cities have many parks and lots of space for people to live. As a result, Canada is a desirable place to live.

York was charged by six German soldiers who came at him with fixed bayonets. He drew a bead on the sixth man, fired, and then on the fifth. He worked his way down the line, and before he knew it, the first man was all by himself. York killed him with a single shot.

As he looked around campus, which had hardly changed, he unconsciously relieved those moments he had spent with Nancy. He recalled how the two of them would seat by the pond, chatting endlessly as they fed the fish and also how they would take walks together, lost in their own world. Yes, Nancy was one of the few friends that he had ever had. ….He was suddenly filled with nostalgia as he recalled that afternoon he had bid farewell to Nancy. He sniffed loudly as his eyes filled with tears.

Примеры решения задач по множественной регрессии

Пример 1. Уравнение регрессии, построенное по 17 наблюдениям, имеет вид:

Расставить пропущенные значения, а также построить доверительный интервал для b 2 с вероятностью 0,99.

Решение. Пропущенные значения определяем с помощью формул:

Таким образом, уравнение регрессии со статистическими характеристиками выглядит так:

Доверительный интервал для b 2 строим по соответствующей формуле. Здесь уровень значимости равен 0,01, а число степеней свободы равно n – p – 1 = 17 – 3 – 1 = 13, где n = 17 – объём выборки, p = 3 – число факторов в уравнении регрессии. Отсюда

или . Этот доверительный интервал накрывает истинное значение параметра с вероятностью, равной 0,99.

Пример 2. Уравнение регрессии в стандартизованных переменных выглядит так:

При этом вариации всех переменных равны следующим величинам:

Сравнить факторы по степени влияния на результирующий признак и определить значения частных коэффициентов эластичности.

Решение. Стандартизованные уравнения регрессии позволяют сравнивать факторы по силе их влияния на результат. При этом, чем больше по абсолютной величине коэффициент при стандартизованной переменной, тем сильнее данный фактор влияет на результирующий признак. В рассматриваемом уравнении самое сильное воздействие на результат оказывает фактор х 1 , имеющий коэффициент – 0,82, самое слабое – фактор х 3 с коэффициентом, равным – 0,43.

В линейной модели множественной регрессии обобщающий (средний) коэффициент частной эластичности определяется выражением, в которое входят средние значения переменных и коэффициент при соответствующем факторе уравнения регрессии натурального масштаба. В условиях задачи эти величины не заданы. Поэтому воспользуемся выражениями для вариации по переменным:

Коэффициенты b j связаны со стандартизованными коэффициентами β j соответствующим соотношением, которое подставим в формулу для среднего коэффициента эластичности:

.

.

При этом знак коэффициента эластичности будет совпадать со знаком β j :

Пример 3. По 32 наблюдениям получены следующие данные:

Определить значения скорректированного коэффициента детерминации, частных коэффициентов эластичности и параметра а .

Решение. Значение скорректированного коэффициента детерминации определим по одному из формул для его вычисления:

Частные коэффициенты эластичности (средние по совокупности) вычисляем по соответствующим формулам:

Поскольку линейное уравнение множественной регрессии выполняется при подстановке в него средних значений всех переменных, определяем параметр а :

Пример 4. По некоторым переменным имеются следующие статистические данные:

Построить уравнение регрессии в стандартизованном и натуральном масштабах.

Решение. Поскольку изначально известны коэффициенты парной корреляции между переменными, начать следует с построения уравнения регрессии в стандартизованном масштабе. Для этого надо решить соответствующую систему нормальных уравнений, которая в случае двух факторов имеет вид:

![]()

или, после подстановки исходных данных:

Решаем эту систему любым способом, получаем: β 1 = 0,3076, β 2 = 0,62.

Запишем уравнение регрессии в стандартизованном масштабе:

Теперь перейдем к уравнению регрессии в натуральном масштабе, для чего используем формулы расчета коэффициентов регрессии через бета-коэффициенты и свойство справедливости уравнения регрессии для средних переменных:

Уравнение регрессии в натуральном масштабе имеет вид:

Пример 5.

При построении линейной множественной регрессии ![]() по 48 измерениям коэффициент детерминации составил 0,578. После исключения факторов х 3

, х 7

и х 8

коэффициент детерминации уменьшился до 0,495. Обоснованно ли было принятое решение об изменении состава влияющих переменных на уровнях значимости 0,1, 0,05 и 0,01?

по 48 измерениям коэффициент детерминации составил 0,578. После исключения факторов х 3

, х 7

и х 8

коэффициент детерминации уменьшился до 0,495. Обоснованно ли было принятое решение об изменении состава влияющих переменных на уровнях значимости 0,1, 0,05 и 0,01?

Решение. Пусть - коэффициент детерминации уравнения регрессии при первоначальном наборе факторов, - коэффициент детерминации после исключения трех факторов. Выдвигаем гипотезы:

![]() ;

; ![]()

Основная гипотеза предполагает, что уменьшение величины было несущественным, и решение об исключении группы факторов было правильным. Альтернативная гипотеза говорит о правильности принятого решения об исключении.

Для проверки нуль – гипотезы используем следующую статистику:

![]() ,

,

где n = 48, p = 10 – первоначальное количество факторов, k = 3 – количество исключаемых факторов. Тогда

Сравним полученное значение с критическим F (α ; 3; 39) на уровнях 0,1; 0,05 и 0,01:

F (0,1; 3; 37) = 2,238;

F (0,05; 3; 37) = 2,86;

F (0,01; 3; 37) = 4,36.

На уровне α = 0,1 F набл > F кр , нуль – гипотеза отвергается, исключение данной группы факторов не оправдано, на уровнях 0,05 0,01 нуль – гипотеза не может быть отвергнута, и исключение факторов можно считать оправданным.

Пример 6 . На основе квартальных данных с 2000 г. по 2004 г. получено уравнение . При этом ESS=110,3, RSS=21,4 (ESS – объясненная СКО, RSS – остаточная СКО). В уравнение были добавлены три фиктивные переменные, соответствующие трем первым кварталам года, и величина ESS увеличилась до 120,2. Присутствует ли сезонность в этом уравнении?

Решение . Это задача на проверку обоснованности включения группы факторов в уравнение множественной регрессии. В первоначальное уравнение с тремя факторами были добавлены три переменные, соответствующие первым трем кварталам года.

Определим коэффициенты детерминации уравнений. Общая СКО определяется как сумма факторной и остаточной СКО:

ТSS = ESS 1 + RSS 1 = 110,3 + 21,4 = 131,7

Проверяем гипотезы . Для проверки нуль – гипотезы используем статистику

Здесь n = 20 (20 кварталов за пять лет – с 2000 г. по 2004 г.), p = 6 (общее количество факторов в уравнении регрессии после включения новых факторов), k = 3 (количество включаемых факторов). Таким образом:

![]()

Определим критические значения статистики Фишера на различных уровнях значимости:

На уровнях значимости 0,1 и 0,05 F набл > F кр , нуль – гипотеза отвергается в пользу альтернативной, и учет сезонности в регрессии является обоснованным (добавление трех новых факторов оправдано), а на уровне 0,01 F набл < F кр , и нуль – гипотеза не может быть отклонена; добавление новых факторов не оправдано, сезонность в регрессии не является существенной.

Пример 7. При анализе данных на гетероскедастичность вся выборка была после упорядочения по одному из факторов разбита на три подвыборки. Затем по результатам трехфакторного регрессионного анализа было определено, что остаточная СКО в первой подвыборке составила 180, а в третьей – 63. Подтверждается ли наличие гетероскедастичности, если объем данных в каждой подвыборке равен 20?

Решение . Рассчитаем–статистику для проверки нуль–гипотезы о гомоскедастичности по тесту Голдфелда–Квандта:

![]() .

.

Найдем критические значения статистики по Фишеру:

Следовательно, на уровнях значимости 0,1 и 0,05 F набл > F кр , и гетероскедастичность имеет место, а на уровне 0,01 F набл < F кр , и гипотезу о гомоскедастичности отклонить нельзя.

Пример 8 . На основе квартальных данных получено уравнение множественной регрессии , для которого ESS = 120,32 и RSS = 41,4. Для этой же модели были раздельно проведены регрессии на основе следующих данных: 1 квартал 1991 г. – 1 квартал 1995 г. и 2 квартал 1995 г. – 4 квартал 1996 г. В этих регрессиях остаточные СКО соответственно составили 22,25 и 12,32. Проверить гипотезу о наличии структурных изменений в выборке.

Решение . Задача о наличии структурных изменений в выборке решается с помощью теста Чоу.

Гипотезы имеют вид: , где s 0 , s 1 и s 2 – остаточные СКО соответственно для единого уравнения по всей выборке и уравнений регрессии двух подвыборок общей выборки. Основная гипотеза отрицает наличие структурных изменений в выборке. Для проверки нуль – гипотезы рассчитывается статистика (n = 24; p = 3):

Поскольку F – статистика меньше единицы, нуль – гипотезу нельзя отклонить ни для какого уровня значимости. Например, для уровня значимости 0,05.

Задачей множественной линейной регрессии является построение линейной модели связи между набором непрерывных предикторов и непрерывной зависимой переменной. Часто используется следующее регрессионное уравнение:

Здесь а i - регрессионные коэффициенты, b 0 - свободный член(если он используется), е - член, содержащий ошибку - по поводу него делаются различные предположения, которые, однако, чаще сводятся к нормальности распределения с нулевым вектором мат. ожидания и корреляционной матрицей .

Такой линейной моделью хорошо описываются многие задачи в различных предметных областях, например, экономике, промышленности, медицине. Это происходит потому, что некоторые задачи линейны по своей природе.

Приведем простой пример. Пусть требуется предсказать стоимость прокладки дороги по известным ее параметрам. При этом у нас есть данные о уже проложенных дорогах с указанием протяженности, глубины обсыпки, количества рабочего материала, числе рабочих и так далее.

Ясно, что стоимость дороги в итоге станет равной сумме стоимостей всех этих факторов в отдельности. Потребуется некоторое количество, например, щебня, с известной стоимостью за тонну, некоторое количество асфальта также с известной стоимостью.

Возможно, для прокладки придется вырубать лес, что также приведет к дополнительным затратам. Все это вместе даст стоимость создания дороги.

При этом в модель войдет свободный член, который, например, будет отвечать за организационные расходы (которые примерно одинаковы для всех строительно-монтажных работ данного уровня) или налоговые отчисления.

Ошибка будет включать в себя факторы, которые мы не учли при построении модели (например, погоду при строительстве - ее вообще учесть невозможно).

Пример: множественный регрессионный анализ

Для этого примера будут анализироваться несколько возможных корреляций уровня бедности и степень, которая предсказывает процент семей, находящихся за чертой бедности. Следовательно мы будем считать переменную характерезующую процент семей, находящихся за чертой бедности, - зависимой переменной, а остальные переменные непрерывными предикторами.

Коэффициенты регрессии

Чтобы узнать, какая из независимых переменных делает больший вклад в предсказание уровня бедности, изучим стандартизованные коэффициенты (или Бета) регрессии.

Рис. 1. Оценки параметров коэффициентов регрессии.

Коэффициенты Бета это коэффициенты, которые вы бы получили, если бы привели все переменные к среднему 0 и стандартному отклонению 1. Следовательно величина этих Бета коэффициентов позволяет сравнивать относительный вклад каждой независимой переменной в зависимую переменную. Как видно из Таблицы, показанной выше, переменные изменения населения с 1960 года (POP_ CHING), процент населения, проживающего в деревне (PT_RURAL) и число людей, занятых в сельском хозяйстве (N_Empld) являются самыми главными предикторами уровня бедности, т.к. только они статистически значимы (их 95% доверительный интервал не включает в себя 0). Коэффициент регрессии изменения населения с 1960 года (Pop_Chng) отрицательный, следовательно, чем меньше возрастает численность населения, тем больше семей, которые живут за чертой бедности в соответствующем округе. Коэффициент регрессии для населения (%), проживающего в деревне (Pt_Rural) положительный, т.е., чем больше процент сельских жителей, тем больше уровень бедности.

Значимость эффектов предиктора

Просмотрим Таблицу с критериями значимости.

Рис. 2. Одновременные результаты для каждой заданной переменной.

Как показывает эта Таблица, статистически значимы только эффекты 2 переменных: изменение населения с 1960 года (Pop_Chng) и процент населения, проживающего в деревне (Pt_Rural), p < .05.

Анализ остатков. После подгонки уравнения регрессии, почти всегда нужно проверять предсказанные значения и остатки. Например, большие выбросы могут сильно исказить результаты и привести к ошибочным выводам.

Построчный график выбросов

Обычно необходимо проверять исходные или стандартизованные остатки на большие выбросы.

Рис. 3. Номера наблюдений и остатки.

Шкала вертикальной оси этого графика отложена по величине сигма, т.е., стандартного отклонения остатков. Если одно или несколько наблюдений не попадают в интервал ± 3 умноженное на сигма, то, возможно, стоит исключить эти наблюдения (это можно легко сделать через условия выбора наблюдений) и еще раз запустить анализ, чтобы убедится, что результаты не изменяются этими выбросами.

Расстояния Махаланобиса

Большинство статистических учебников уделяют много времени выбросам и остаткам относительно зависимой переменной. Тем не менее роль выбросов в предикторах часто остается не выявленной. На стороне переменной предиктора имеется список переменных, которые участвуют с различными весами (коэффициенты регрессии) в предсказании зависимой переменной. Можно считать независимые переменные многомерным пространством, в котором можно отложить любое наблюдение. Например, если у вас есть две независимых переменных с равными коэффициентами регрессии, то можно было бы построить диаграмму рассеяния этих двух переменных и поместить каждое наблюдение на этот график. Потом можно было отметить на этом графике среднее значение и вычислить расстояния от каждого наблюдения до этого среднего (так называемый центр тяжести) в двумерном пространстве. В этом и заключается основная идея вычисления расстояния Махаланобиса . Теперь посмотрим на гистограмму переменной изменения населения с 1960 года.

Рис. 4. Гистограмма распределения расстояний Махаланобиса.

Из графика следует, что есть один выброс на расстояниях Махаланобиса.

Рис. 5. Наблюдаемые, предсказанные и значения остатков.

Обратите внимание на то, что округ Shelby (в первой строке) выделяется на фоне остальных округов. Если посмотреть на исходные данные, то вы обнаружите, что в действительности округ Shelby имеет самое большое число людей, занятых в сельском хозяйстве (переменная N_Empld). Возможно, было бы разумным выразить в процентах, а не в абсолютных числах, и в этом случае расстояние Махаланобиса округа Shelby, вероятно, не будет таким большим на фоне других округов. Очевидно, что округ Shelby является выбросом .

Удаленные остатки

Другой очень важной статистикой, которая позволяет оценить серьезность проблемы выбросов, являются удаленные остатки . Это стандартизованные остатки для соответствующих наблюдений, которые получаются при удалении этого наблюдения из анализа. Помните, что процедура множественной регрессии подгоняет поверхность регрессии таким образом, чтобы показать взаимосвязь между зависимой и переменной и предиктором. Если одно наблюдение является выбросом (как округ Shelby), то существует тенденция к "оттягиванию" поверхности регрессии к этому выбросу. В результате, если соответствующее наблюдение удалить, будет получена другая поверхность (и Бета коэффициенты). Следовательно, если удаленные остатки очень сильно отличаются от стандартизованных остатков, то у вас будет повод считать, что регрессионный анализа серьезно искажен соответствующим наблюдением. В этом примере удаленные остатки для округа Shelby показывают, что это выброс, который серьезно искажает анализ. На диаграмме рассеяния явно виден выброс.

Рис. 6. Исходные остатки и Удаленные остатки переменной, означающей процент семей, проживающих ниже прожиточного минимума.

Большинство из них имеет более или менее ясные интерпретации, тем не менее обратимся к нормальным вероятностным графикам.

Как уже было упомянуто, множественная регрессия предполагает, что существует линейная взаимосвязь между переменными в уравнении и нормальное распределение остатков. Если эти предположения нарушены, то вывод может оказаться неточным. Нормальный вероятностный график остатков укажет вам, имеются ли серьезные нарушения этих предположений или нет.

Рис. 7. Нормальный вероятностный график; Исходные остатки.

Этот график был построен следующим образом. Вначале стандартизованные остатки ранжируюся по порядку. По этим рангам можно вычислить z значения (т.е. стандартные значения нормального распределения) на основе предположения, что данные подчиняются нормальному распределению. Эти z значения откладываются по оси y на графике.

Если наблюдаемые остатки (откладываемые по оси x) нормально распределены, то все значения легли бы на прямую линию на графике. На нашем графике все точки лежат очень близко относительно кривой. Если остатки не являются нормально распределенными, то они отклоняются от этой линии. Выбросы также становятся заметными на этом графике.

Если имеется потеря согласия и кажется, что данные образуют явную кривую (например, в форме буквы S) относительно линии, то зависимую переменную можно преобразовать некоторым способом (например, логарифмическое преобразование для "уменьшения" хвоста распределения и т.д.). Обсуждение этого метода находится за пределами этого примера (Neter, Wasserman, и Kutner, 1985, pp. 134-141, представлено обсуждение преобразований, убирающих ненормальность и нелинейность данных). Однако исследователи очень часто просто проводят анализ напрямую без проверки соответствующих предположений, что ведет к ошибочным выводам.