Лекция 13 Случайные процессы Основные понятия. Закон распределения и . Стационарные, эргодичес

Лекция 13Случайные процессы

Основные понятия. Закон распределения и основные характеристики

случайных процессов. Стационарные, эргодические, элементарные случайные

процессы

(Ахметов С.К.)

Определения

Случайным процессом X(t) называется процесс, значение которого прилюбом фиксированном t = ti является СВ X(ti)

Реализацией случайного процесса X(t) называется неслучайная функция

х(t), в которую превращается случайный процесс X(t) в результате опыта

Сечение случайного процесса (случайной функции) – это случайная

величина X(ti) при t = ti.

Случайный процесс X(t) называется процессом с дискретным

временем, если система, в которой он протекает, может менять

свои состояния только в моменты t1, t2, t3….. tn, число которых

конечно или счетно

временем, если переходы системы из состояния в состояние могут

происходить в любой момент времени t наблюдаемого периода

Случайный процесс X(t) называется процессом с непрерывным

состоянием, если его сечение в любой момент t представляет

собой не дискретную, а непрерывную величину

Случайный процесс X(t) называется процессом с дискретным

состоянием, если в любой момент времени t множество его

состояний конечно или счетно, то есть, если его сечение в любой

момент t характеризуется дискретной случайной величиной

Классификация случайных процессов

Таким образом, все СП можно разделить на 4 класса:Процессы

временем;

Процессы

временем;

Процессы

временем;

Процессы

временем.

с дискретным состоянием и дискретным

с дискретным состоянием и непрерывным

с непрерывным состоянием и дискретным

с непрерывным состоянием и непрерывным

Большинство гидрологических процессов являются

процессами с непрерывным состоянием и непрерывным

временем. Но при вводе шага дискретности по времени они

превращаются из процесса с непрерывным временем в

процесс с дискретным временем. При этом процесс остается

непрерывным по состоянию

Основные характеристики случайных процессов

Сечение случайного процесса х(t) при любом фиксированном значенииаргумента t представляет собой СВ, которая имеет закон распределения

F (t, x) = P{X(t) < x}

Это одномерный закон распределения случайного процесса X(t)

Но, он не является исчерпывающей характеристикой СП, так как

характеризует свойства любого, но отдельно взятого сечения и не дает

представления о совместном распределении двух или более сечений.

Это видно на рисунке, где показаны два СП с разными вероятностными

структурами, но примерное одинаковыми распределениями СВ в каждом

сечении

Основные характеристики случайных процессов

Поэтому более полной характеристикой СП является двумерный законраспределения

F(t1,t2,x1,x2) = P {X(t1) < x1, X(t2) < x2}

В общем случае исчерпывающей характеристикой СП является n мерный закон распределения

На практике вместо многомерных законов распределения используют

основные характеристики СП, такие как МО, дисперсия, начальные и

центральные моменты, но только для СП эти характеристики будут не

числами, а функциями

Математическое ожидание СП X(t) - неслучайная функция mx(t),

которая при любом значении аргумента t равна математическому

ожиданию соответствующего сечения СП:

где f1(x,t) – одномерная плотность распределения СП X(t)

Основные характеристики случайных процессов

МО СП представляет собой некоторую «среднею» функцию, вокругкоторой происходит разброс СП

Если из СП X(t) вычесть его МО, то получим центрированный СП:

X0(t) = X(t) – mx(t)

Дисперсией СП X(t) называется неслучайная функция СП X(t), которая

при любом значении аргумента t равна дисперсии соот – го сечения СП X(t)

СП X(t) = D = M{2}

Среднеквадратическим отклонением СП X(t) называется неслучайная

функция σx(t), которая равна корню квадратному из дисперсии СП:

σx(t) = σ = √Dx(t)

Основные характеристики случайных процессов

Для полной характеристики СП необходимо учитывать взаимосвязьмежду различными сечениями. Поэтому, к комплексу перечисленных

характеристик нужно добавить также корреляционную функцию СП:

Корреляционной (или ковариационной) функцией СП X(t) называется

неслучайная функция Kx(t,t’), которая при каждой паре значений

аргументов t и t’ равна корреляции соответствующих сечений X(t) и X(t’)

Kx(t,t’) = M{ x }

или

Kx(t,t’) = M = M - mx(t) mx(t’)

Свойства корреляционной функции:

- при равенстве t = t’ корреляционная функция равна дисперсии СП, т. е.

Kx(t,t’) = Dx(t)

- корреляционная функция Kx(t,t’) симметрична относительно своих

аргументов, то есть

Kx(t,t’) = Kx(t’,t)

Основные характеристики случайных процессов

Нормированной корреляционной функцией rx(t,t’) СП X(t) называетсяфункция, полученная делением корреляционной функции на произведение

среднеквадратических отклонений σx(t) σx(t’)

rx(t,t’) = /(σx(t)σx(t’)) = /(√(Dx(t)Dx(t’))

Свойства нормированной корреляционной функции:

- при равенстве аргументов t и t’ нормированная корреляционная функция

равна единице rx(t,t’) = 1

-нормированная корреляционная функция симметрична относительно

своих аргументов, то есть rx(t,t’) = rx(t’,t)

- нормированная корреляционная функция по модулю не превышает

единицу rx(t,t’) ≤ 1

Основные характеристики случайных процессов

Скалярный СП – это когда речь идет об одном СП, как было до сихпор.

Векторный СП – это когда рассматриваются 2 и более СП.

Допустим заданы расходы воды в нескольких створах во времени

В этом случае для характеристики СП нужно знать для каждого

скалярного процесса:

-МО

-корреляционную функцию

-взаимную корреляционную функцию

Взаимной корреляционной функцией Ri,j(t,t’) двух случайных

процессов X(t) и X(t’) называется неслучайная функция двух

аргументов t и t’, которая при каждой паре значений t и t’ равна

ковариации (линейной связи) двух сечений СП X(t) и X(t’)

Ri,j(t,t’) = M

Стационарные случайные процессы

Стационарные СП – это СП, у которых все вероятностныехарактеристики не зависят от времени, то есть:

- mx = const

- Dx = const

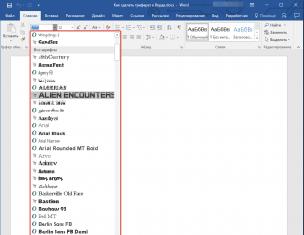

Отличие стационарных и нестационарных СП показано на рисунке

а) стационарный СП

б) нестационарный СП по МО

с) нестационарный СП по дисперсии

Свойства корреляционной функции стационарного СП

Четность функции от своего аргумента, то есть kx(τ) = kx(-τ)τ – сдвиг всех временных аргументов СП на одинаковую величину Θ

k – корреляционная функция СП при Kx(t1,t2) = kx(τ)

Значение корреляционной функции стационарного СП при нулевом

сдвиге τ равно дисперсии СП

Dx = Kx(t1,t2) = kx(t - t) = kx(0)

|kx(τ)| ≤ kx(0)

Помимо корреляционной функции используется нормированная

корреляционная функция стационарного СП, которую называют

автокорреляционной функцией

rx(τ) = kx(τ)/Dx = kx(τ)/kx(0)

Эргодические случайные процессы

Эргодическое свойство СП – это когда по одной достаточнопродолжительной реализации СП можно судить о СП в целом

Достаточным условием эргодичности СП является условие

lim kx(τ) = 0

при τ → ∞, т.е. при увеличении сдвига между сечениями

корреляционная функция затухает

На рисунке показаны а) неэргодический и б) эргодический СП

На практике (чаще всего) мы вынуждены принимать гипотезу о

стационарности и эргодичности гидрологических процессов, чтобы по

имеющемуся раду судить о всей генеральной совокупности

Элементарные случайные процессы

Элементарный СП (э.с.п) – это такая функция аргумента t, длякоторой зависимость от t представлена обычной неслучайной функцией,

в которую в качестве аргумента входит одна или несколько обычных СВ

То есть каждая СВ порождает свою реализацию СП

К примеру, если в каком – то створе ветвь спада половодья является

устойчивой и описывается уравнением

Q(t) = Qнe-at

a - районный параметр (a>0)

Qн - расход воды в начальный момент времени t = t0

то процесс спада половодья можно считать э.с.п., где a - неслучайная

величина, Qн -случайная величина

Предварительные замечания. Найдем изображение Фурье от d -функции.

Очевидно, справедливо и обратное преобразование Фурье:

А также:

1. Пусть процесс представляет собой постоянную величину x(t)=A o . Как уже было выяснено ранее, корреляционная функция такого процесса равна Найдем спектральную плотность процесса путем прямого преобразования Фурье функции R(t):

![]()

Спектр процесса состоит из единственного пика типа импульсной функции, расположенной в начале координат. Таким образом, если в процессе присутствует только одна частота w =0, то это значит, что вся мощность процесса сосредоточена на этой частоте, что и подтверждает вид функции S(w). Если случайная функция содержит постоянную составляющую, т.е. среднее значение , то S(w) будет иметь разрыв непрерывности в начале координат и будет характеризоваться наличием d -функции в точке w =0.

2. Для гармонической функции X=A o sin(w 0 t+j) корреляционная функция:

![]()

Спектральная плотность равна

График S(w) будет иметь два пика типа импульсной функции, расположенных симметрично относительно начала координат при w= +w 0 и w= -w 0 . Это говорит о том, что мощность процесса сосредоточена на двух частотах +w 0 и -w 0 .

Если случайная функция имеет гармонические составляющие, то спектральная плотность имеет разрывы непрерывности в точках w = ±w 0 и характеризуется наличием двух дельта-функций, расположенных в этих точках.

Белый шум . Под белым шумом понимают случайный процесс, имеющий одинаковые значения спектральной плотности на всех частотах от -¥ до +¥ : S(w ) = Const.

Примером такого процесса при определенных допущениях являются тепловые шумы, космическое излучение и др. Корреляционная функция такого процесса равна

![]()

Таким образом R(t) представляет собой импульсную функцию, расположенную в начале координат.

Этот процесс является чисто случайным процессом, т.к. при любом t ¹0 отсутствует корреляция между последующими и предыдущими значениями случайной функции. Процесс с такой спектральной плотностью является физически нереальным, т.к. ему соответствуют бесконечно большие дисперсия и средний квадрат случайной величины:

![]()

Такому процессу соответствует бесконечно большая мощность и источник с бесконечно большой энергией.

2. Белый шум с ограниченной полосой частот. Такой процесс характеризуется спектральной плотностью вида

S(w)=C при ½w½ <w n ,

S(w) =0 при ½w½>w n .

где (-w n , w n) полоса частот для спектральной плотности.

Это такой случайный процесс, спектральная плотность которого остается практически постоянной в диапазоне частот, могущих оказать влияние на рассматриваемую систему управления, т.е. в диапазоне частот, пропускаемых системой. Вид кривой S (w ) вне этого диапазона не имеет значения, т.к. часть кривой, соответствующая высшим частотам, не окажет влияния на работу системы. Этому процессу соответствует корреляционная функция

Дисперсия процесса равна

5. Типовой входной сигнал следящей системы. В качестве типового сигнала принимают сигнал, график которого показан на рис.63. Скорость вращения задающего вала следящей системы сохраняет постоянное значение в течение некоторых интервалов времени t 1 , t 2 ,...

Переход от одного значения к другому совершается мгновенно. Интервалы времени подчиняются закону распределения Пуассона. Математическое ожидание

Рис.63. Типовой сигнал

График такого вида получается в первом приближении при слежении РЛС за движущейся целью. Постоянные значения скорости соответствуют движению цели по прямой. Перемена знака или величины скорости соответствует маневру цели.

Пусть m -среднее число перемен скорости за 1 с. Тогда Т=1/m будет среднее значение интервалов времени, в течение которых угловая скорость сохраняет свое постоянное значение. Применительно к РЛС это значение будет средним временем движения цели по прямой. Для определения корреляционной функции необходимо найти среднее значение произведения

![]()

При нахождении этого значения могут быть два случая.

1. Моменты времени t и t+t относятся к одному интервалу. Тогда среднее произведения угловых скоростей будет равно среднему квадрату угловой скорости или дисперсии:

2. Моменты времениt и t+t относятся к разным интервалам. Тогда среднее произведения скоростей будет равно нулю, так как величины W(t) и W(t+t) для разных интервалов можно считать независимыми величинами:

Корреляционная функция равна:

где, Р 1 - вероятность нахождения моментов времени t и t+t в одном интервале, а Р 2 =1- Р 1 вероятность нахождения их в разных интервалах.

Оценим величину Р 1 . Вероятность появления перемены скорости на малом интервале времени Dt пропорциональна этому интервалу и равна mDt или Dt/Т. Вероятность отсутствия перемены скорости для этого же интервала будет равна 1-Dt/Т. Для интервала времени t вероятность отсутствия перемены скорости т.е. вероятность нахождения моментов времени t и t+t в одном интервале постоянной скорости будет равна произведению вероятности отсутствий перемены скорости на каждом элементарном промежутке Dt, т.к. эти события независимые. Для конечного промежутка получаем, что число промежутков равно t/Dt и

![]()

Перейдя к пределу, получим

Во всех предыдущих параграфах этой главы предполагалось, что управляющие и возмущающие воздействия являются определенными функциями времени. Однако для систем автоматического управления, работающих в реальных условиях, характерно, что эти воздействия носят случайный характер и принципиально непредсказуемы.

Рассмотрим, например, работу следящей системы, управляющей антенной радиолокатора. Для этой системы управляющим воздействием является положение цели, а возмущающими воздействиями можно считать ветровые нагрузки на антенну, отклонения луча от направления на цель из-за рефракции в атмосфере, собственные шумы в усилительном тракте системы, помехи от источников питания и т. п. Все эти процессы обусловлены множеством взаимодействующих причин и носят настолько сложный характер, что их нельзя представить какой-либо заданной функцией времени. То же самое можно сказать и относительно управляющего воздействия. На практике его нельзя считать типовым, например ступенчатым, линейно-растущим, синусоидальным или каким-либо регулярным сигналом. Реально цель маневрирует, поэтому ее положение в любой последующий момент не может быть точно предсказано. На этом маневрирование накладывается постоянное блуждание отражающей точки по корпусу цели.

Таким образом, сигналы управления и возмущения в реальных условиях являются случайными процессами. Случайным, или стохастическим процессом

называют такую функцию времени которая при каждом значении аргумента является случайной величиной. Если вместо времени употребляют другую независимую переменную, то используют термин случайная функция. При многократном воспроизведении условий протекания случайного процесса последний принимает каждый раз различные конкретные значения. Эти значения как функции времени называют реализациями случайного процесса. Типичный вид нескольких реализаций стохастического процесса ошибки угловой координаты цели, отслеживаемой радиолокационной станцией, представлен на рис. XIII. 14.

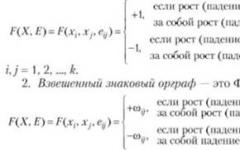

Математическое описание случайного процесса. При фиксированном значении аргумента случайный процесс является случайной величиной, полное описание которой дает функция распределения

т. е. вероятность того, что в данный момент случайная величина примет значение, меньшее Как известно из теории вероятностей, вместо функции распределения часто удобнее пользоваться плотностью вероятности, являющейся ее производной (в обобщенном смысле):

![]()

Если зафиксировать два момента времени то значения случайного процесса образуют систему двух случайных величин или двумерный случайный вектор. Для его полного описания требуется знать двумерную функцию распределения

Рис. ХIII.14. Стохастический процесс ошибки измерения угловой координаты цели, отслеживаемой радиолокационной станцией

или двумерную плотность

которые зависят от как от параметров.

Для более подробного описания случайного процесса в произвольные моменты времени аналогично вводятся функции распределения и плотности более высоких порядков. Таким образом, полное статистическое описание случайной функции (процесса) даетесконечная последовательность ее функций распределения:

или последовательность их производных

Каждый из членов этих последовательностей имеет обычные свойства функций распределения или соответственно плотностей. Кроме того, каждый следующий член последовательности определяет все предыдущие. Например, если положить то

аналогичные формулы имеем и для любых других моментов времени.

Это условие называют условием согласованности семейства функций распределения. Справедливо также условие симметрии:

В общем случае плотности или функции распределения более высокого порядка не определяются плотностями или функциями более низких порядков.

Однако часто полезно рассматривать так называемый абсолютно случайный процесс, значения которого независимы в совокупности для любых Для такого процесса плотность распределения любого порядка определяется через одномерную:

Такой процесс является математическим упрощением, поскольку при достаточно близких значениях значения любого реального процесса близки, и, следовательно, зависимы. Другим крайним случаем является вырожденный, или сингулярный процесс, определяемый одной или несколькими случайными величинами; например,

где - случайная величина; - известные константы. Такой процесс становится полностью известным, если можно измерить его в какой-либо момент времени. В более общем случае сингулярный случайный процесс характеризуется совокупностью случайных величин например,

![]()

где - обычные (детерминированные функции времени).

Рис. XIII.15. Возможные реализации двух случайных функций: а - с высокочастотными составляющими; б - с низкочастотными составляющими

Моментные функции. В практических задачах обычно пользуются более простыми характеристиками случайных процессов - моментными функциями. Моментом первого порядка или математическим ожиданием процесса называют выражение

Если эту функцию рассматривать в зависимости от то около среднего значения функции будут группироваться все реализации случайного процесса (рис. XIII.15).

Математические ожидания более высоких степеней носятназвания начальных моментов порядка

Случайная функция имеет нулевое среднее значение и называется центрированной. Центральным моментом -порядка процесса называется математическое ожидание степени центрированного процесса

Меру рассеяния значений случайного процесса относительно математического ожидания его определяет момент второго порядка, называемый чаще дисперсией:

Однако характеристики случайного процесса, основанные на первой плотности не отражают изменения реализаций во времени. Например, два процесса с одной и той же первой плотностью (рис. XIII. 15, а и б) различаются по скорости изменения реализаций, т. е. по степени взаимосвязи между двумя значениями, принимаемыми в одной реализации в различные моменты времени. Для описания временной внутренней структуры случайных процессов используют корреляционную функцию

Эту функцию часто называют также автокорреляционной, или ковариацией, она играет основную роль в теории случайных процессов.

Легко показать, что корреляционная функция симметрична относительно своих аргументов а при ее значение равно дисперсии случайного процесса . В самом деле,

Для характеристики точности систем автоматического регулирования удобно использовать нецентрированную корреляционную функцию:

называемую также вторым начальным моментом процесса.

Связь между устанавливается следующими преобразованиями:

При средний квадрат процесса будет

В системах автоматического регулирования часто действует несколько случайных возмущающих или управляющих сигналов, независимых или взаимосвязанных. Мерой взаимосвязи двух случайных процессов служит взаимная корреляционная функция

где - совместная плотность вероятности для независимых процессов

Для взаимной корреляционной функции справедливо равенство

Теория случайных процессов, в которой используются лишь моменты первого и второго порядков называется корреляционной теорией. Она была создана основополагающими работами А. Н. Колмогорова , Д. Я. Хинчина , Н. Вииера. Большой вклад в ее развитие внесли советские ученые В. С. Пугачев , В. В. Солодовников и др.

Стационарные случайные процессы. При рассмотрении различных случайных процессов выделяют группу процессов, статистические свойства которых не изменяются при сдвиге во времени. Такие процессы называются стационарными. Рассматривая множество реализаций случайного процесса, приведенного на рис. XIII. 14, можно предположить, что в данном случае начало отсчета времени может быть выбрано произвольно, т. е. налицо стационарный процесс. Напротив, на рис. XIII. 15, очевидно, имеем примеры нестационарных процессов.

Исследование систем, случайные процессы в которых стационарны, значительно проще, чем исследование систем с нестационарными процессами. Однако процессы во многих системах регулирования можно приближенно рассматривать как стационарные. Это имеет большое прикладное значение в теории стационарных случайных процессов.

По определению стационарного случайного процесса его математическое ожидание должно быть постоянно при сдвиге аргумента на любой тервал Т:

а корреляционная функция удовлетворяет соотношению

Полагая находим, что корреляционная функция стационарного процесса зависит только от разности отсчетов

Эргодические свойства случайных процессов. Если мы имеем совокупность, или, как говорят, ансамбль реализаций, то математическое ожидание и корреляционная функция получаются усреднением по ансамблю реализаций случайного процесса, т. е. «поперек» процесса в одном или соответственно двух его сечениях. Интересно рассмотреть также результаты усреднения реализаций стационарного процесса по времени вдоль оси на интервале , определив эту операцию естественным образом:

Эта величина различна для разных реализаций случайного процесса и сама является случайной. Можно показать, что ее математическое ожидание для стационарного процесса равно . В то же время дисперсия этой величины, как показывают непосредственные расчеты,

Рис. XIII.16. Структурная схема коррелятора

Условия эргодичности процесса по , сформулированные В. С. Пугачевым , содержат более высокие моменты случайного процесса и здесь не приводятся.

Свойства эргодичности случайных процессов позволяют заменить усреднение по множеству реализаций, практически редко осуществимое, усреднением по времени, взятым по одной реализации, когда Т велико..

Не все стационарные процессы имеют эргодические свойства. Например, процесс, все реализации которого есть случайные величины, не изменяющиеся во времени, как легко убедиться, неэргодичен. Отсюда следует, что физический смысл эргодичности заключается в «хорошей перемешиваемости» реализаций случайного процесса. Поскольку это имеет место практически во всех приложениях, в дальнейшем будем предполагать рассматриваемые процессы эргодическими.

Для таких процессов можно экспериментально определить среднее значение и корреляционную функцию процесса с помощью специальных приборов - корреляторов. Принцип действия корреляторов ясен из рис. XIII.16.

Подавая на вход коррелятора единичный сигнал, на его выходе при достаточно большом времени интегрирования Т будем иметь среднее значение процесса х, приблизительно совпадающее с его математическим ожиданием Если же то в результате будем иметь второй начальный момент по которому легко определить и корреляционную функцию.

Лабораторная работа № 4СЛУЧАЙНЫЕ ПРОЦЕССЫ

И ИХ ХАРАКТЕРИСТИКИ

4.1. ЦЕЛЬ РАБОТЫ

Ознакомление с основными понятиями теории случайных процессов. Выполнение измерений моментных характеристик и оценки ПРВ мгновенных значений случайных процессов. Анализ вида автокорреляционной функции (АКФ) и спектральной плотности мощности (СПМ) случайного процесса. Исследование преобразований случайного процесса линейными стационарными и нелинейными безынерционными цепями.4.2. ТЕОРЕТИЧЕСКИЕ СВЕДЕНИЯ

Случайные события и случайные величины

Событие , которое может произойти или не произойти в некотором опыте, называется случайным событием и характеризуется вероятностью осуществления . Случайная величина

(СВ)

. Случайная величина

(СВ)  может принять в опыте одно значение

может принять в опыте одно значение  из некоторого множества

из некоторого множества  ; это значение называется реализацией данной СВ. может быть, например, множеством вещественных чисел

; это значение называется реализацией данной СВ. может быть, например, множеством вещественных чисел  или его подмножеством. Если множество конечно или счетно (дискретная СВ), можно говорить о вероятности

или его подмножеством. Если множество конечно или счетно (дискретная СВ), можно говорить о вероятности  осуществления события, которое заключается в принятии случайной величиной значения , т. е. на множестве значений дискретной случайной величины задается распределение вероятностей

. Если множество несчетно (например, вся вещественная прямая), то полное описание случайной величины дает функция распределения,

определяемая выражением

осуществления события, которое заключается в принятии случайной величиной значения , т. е. на множестве значений дискретной случайной величины задается распределение вероятностей

. Если множество несчетно (например, вся вещественная прямая), то полное описание случайной величины дает функция распределения,

определяемая выражением  ,

,

где  . Если функция распределения непрерывна и дифференцируема, то можно определить плотность распределения вероятностей

(ПРВ), называемую также для краткости плотностью вероятности

. Если функция распределения непрерывна и дифференцируема, то можно определить плотность распределения вероятностей

(ПРВ), называемую также для краткости плотностью вероятности

(а иногда просто плотностью):

, при этом

, при этом  .

.

Очевидно, функция распределения – неотрицательная неубывающая функция со свойствами  ,

,  . Следовательно,

. Следовательно,

ПРВ – неотрицательная функция, удовлетворяющая условию нормировки

.

.

Иногда ограничиваются числовыми характеристиками случайной величины, чаще всего моментами

. Начальный

момент  -го порядка (-й начальный момент)

-го порядка (-й начальный момент)

,

,

где горизонтальная черта и  – символические обозначения интегрального оператора усреднения по ансамблю

. Первый начальный момент

– символические обозначения интегрального оператора усреднения по ансамблю

. Первый начальный момент  , называется математическим ожиданием

или центром распределения.

, называется математическим ожиданием

или центром распределения.

Центральный момент -го порядка (-й центральный момент)

Наиболее употребительным из центральных моментов является второй центральный момент, или дисперсия

Вместо дисперсии часто оперируют среднеквадратическим отклонением

(СКО) случайной величины  .

.

^

Средний квадрат

, или второй начальный момент  , связан с дисперсией и математическим ожиданием:

, связан с дисперсией и математическим ожиданием:

Для описания формы ПРВ используют коэффициент асимметрии

и коэффициент эксцесса

и коэффициент эксцесса

(иногда эксцесс характеризуют величиной

(иногда эксцесс характеризуют величиной  ).

).

Часто используется нормальное, или гауссовское (гауссово), распределение с ПРВ

,

,

где  и

и  – параметры распределения (математическое ожидание и СКО соответственно). Для гауссовского распределения

– параметры распределения (математическое ожидание и СКО соответственно). Для гауссовского распределения  ,

,  .

.

Две случайные величины и  характеризуются совместной

плотностью распределения

характеризуются совместной

плотностью распределения  . Числовыми характеристиками совместной плотности служат начальные и центральные смешанные

моменты

. Числовыми характеристиками совместной плотности служат начальные и центральные смешанные

моменты

,

,  ,

,

где и  – произвольные целые положительные числа;

– произвольные целые положительные числа;  и

и  – математические ожидания СВ x

и y

.

– математические ожидания СВ x

и y

.

Наиболее часто используются смешанные моменты второго порядка – начальный (корреляционный момент):

и центральный (ковариационный момент, или ковариация )

.

.

Для пары гауссовских случайных величин двумерная совместная ПРВ имеет вид

где  ,

,  – среднеквадратические отклонения;

– среднеквадратические отклонения;  – математические ожидания;

– математические ожидания;  – коэффициент корреляции

– нормированный ковариационный момент

– коэффициент корреляции

– нормированный ковариационный момент

.

.

При нулевом коэффициенте корреляции очевидно,

,

,

т. е. некоррелированные

гауссовские случайные величины независимы.

^

Случайные процессы

Случайный процесс – это последовательность случайных величин, упорядоченная по возрастанию некоторой переменной (чаще всего времени). Перейти от описания случайной величины к описанию случайного процесса можно, рассматривая совместные распределения двух, трех и более значений процесса в некоторые различные моменты времени. В частности, рассматривая процесс в временных сечениях

(при  ), получаем -мерные совместные функцию распределения и плотность распределения вероятностей случайных величин

), получаем -мерные совместные функцию распределения и плотность распределения вероятностей случайных величин  …

…  , определяемые выражением

, определяемые выражением

.

.

Случайный процесс считается полностью определенным, если для любого

можно записать его совместную ПРВ при любом выборе моментов времени

.

.

Часто при описании случайного процесса можно ограничиться совокупностью его смешанных начальных моментов (если они существуют, т.е. сходятся соответствующие интегралы)

и смешанных центральных моментов

при целых неотрицательных  и целом .

и целом .

В общем случае моменты совместной ПРВ зависят от расположения сечений на оси времени и называются моментными функциями . Чаще всего используют второй смешанный центральный момент

,

,

называемый функцией автокорреляции или автокорреляционной функцией (АКФ). Напомним, что здесь и далее явно не указана зависимость от времени, а именно – функциями времени являются  ,

,  и

и  .

.

Можно рассматривать совместно два случайных процесса  и

и  ; такое рассмотрение предполагает их описание в виде совместной многомерной ПРВ, а также в виде совокупности всех моментов, в том числе смешанных. Наиболее часто при этом используют второй смешанный центральный момент

; такое рассмотрение предполагает их описание в виде совместной многомерной ПРВ, а также в виде совокупности всех моментов, в том числе смешанных. Наиболее часто при этом используют второй смешанный центральный момент

,

,

называемый взаимно корреляционной функцией  .

.

Среди всех случайных процессов выделяют СП, для которых совместная -мерная ПРВ не изменяется при одновременном изменении (сдвиге) всех временных сечений на одну и ту же величину. Такие процессы называются стационарными в узком смысле или строго стационарными .

Чаще рассматривают более широкий класс случайных процессов с ослабленным свойствам стационарности. СП называется стационарным в широком смысле

, если при одновременном сдвиге сечений не изменяются лишь его моменты не выше второго

порядка. Практически это означает, что СП стационарен в широком смысле, если он имеет постоянные среднее

(математическое ожидание ) и дисперсию

, а АКФ зависит только от разности моментов времени, но не от их положений на временнóй оси:

, а АКФ зависит только от разности моментов времени, но не от их положений на временнóй оси:

1)  ,

,

2) ,  .

.

Заметим, что  , откуда и следует постоянство дисперсии.

, откуда и следует постоянство дисперсии.

Нетрудно убедиться, что процесс, стационарный в узком смысле, стационарен и в широком смысле. Обратное утверждение вообще неверно, хотя существуют процессы, для которых стационарность в широком смысле влечет стационарность в узком смысле.

Совместная -мерная ПРВ отсчетов  гауссовского процесса, взятых во временных сечениях , имеет вид

гауссовского процесса, взятых во временных сечениях , имеет вид

, (4.1)

, (4.1)

где  – определитель квадратной матрицы, составленной из попарных коэффициентов корреляции отсчетов;

– определитель квадратной матрицы, составленной из попарных коэффициентов корреляции отсчетов;  – алгебраическое дополнение элемента

– алгебраическое дополнение элемента  этой матрицы.

этой матрицы.

Совместная гауссовская ПРВ при любом полностью определяется математическими ожиданиями, дисперсиями и коэффициентами корреляции отсчетов, т. е. моментными функциями не выше второго порядка. Если гауссовский процесс стационарен в широком смысле, то все математические ожидания одинаковы, все дисперсии (а значит, и СКО) равны друг другу, а коэффициенты корреляции определяются только тем, насколько временные сечения отстоят друг от друга. Тогда, очевидно, ПРВ (4.1) не изменится, если все временные сечения сдвинуть влево или вправо на одну и ту же величину. Отсюда следует, что гауссовский процесс, стационарный в широком смысле, стационарен и в узком смысле (строго стационарен).

Среди строго стационарных случайных процессов часто выделяют более узкий класс эргодических случайных процессов. Для эргодических процессов моменты, найденные усреднением по ансамблю, равны соответствующим моментам, найденным усреднением по времени:

,

,

(здесь  – символическое обозначение оператора усреднения по времени).

– символическое обозначение оператора усреднения по времени).

В частности, для эргодического процесса математическое ожидание, дисперсия и АКФ равны соответственно

,

,

,

,

Эргодичность весьма желательна, так как дает возможность практически измерять (оценивать) числовые характеристики случайного процесса. Дело в том, что обычно наблюдателю доступна лишь одна (хотя, возможно, достаточно длинная) реализация случайного процесса. Эргодичность означает, по существу, что эта единственная реализация является полноправным представителем всего ансамбля .

Измерение характеристик эргодического процесса может быть выполнено при помощи простых измерительных устройств; так, если процесс представляет собой напряжение, зависящее от времени, то вольтметр магнитоэлектрической

системы измеряет его математическое ожидание (постоянную составляющую), вольтметр электромагнитной или термоэлектрической системы, подключенный через разделительную емкость (для исключения постоянной составляющей), – его среднеквадратическое значение (СКО). Устройство, структурная схема которого показана на рис. 4.1, позволяет измерить значения функции автокорреляции при различных  . Фильтр нижних частот играет здесь роль интегратора, конденсатор выполняет центрирование процесса, так как не пропускает постоянную составляющую тока. Это устройство называется коррелометром

.

. Фильтр нижних частот играет здесь роль интегратора, конденсатор выполняет центрирование процесса, так как не пропускает постоянную составляющую тока. Это устройство называется коррелометром

.

Рис. 4.1

Достаточными условиями эргодичности стационарного случайного процесса служат условие  , а также менее сильное условие Слуцкого

, а также менее сильное условие Слуцкого

.

.

^

Дискретные алгоритмы оценивания параметров СП

Приведенные выше выражения для нахождения оценок параметров СП и корреляционной функции справедливы для непрерывного времени. В данной лабораторной работе (как и во многих современных технических системах и приборах) аналоговые сигналы генерируются и обрабатываются цифровыми устройствами, что приводит к необходимости некоторого изменения соответствующих выражений. В частности, для определения оценки математического ожидания используется выражение выборочного среднего

,

,

где  – последовательность отсчетов процесса (выборка

объема

– последовательность отсчетов процесса (выборка

объема  ). Оценкой дисперсии служит выборочная дисперсия

, определяемая выражением

). Оценкой дисперсии служит выборочная дисперсия

, определяемая выражением

.

.

Оценка автокорреляционной функции, иначе называемая коррелограммой , находится как

.

.

Оценкой плотности распределения вероятностей мгновенного значения ССП служит гистограмма

. Для ее нахождения диапазон возможных значений СП разбивается на  интервалов равной ширины, затем для каждого

интервалов равной ширины, затем для каждого  -го интервала подсчитывается количество

-го интервала подсчитывается количество  отсчетов выборки, попавших в него. Гистограмма представляет собой набор чисел

отсчетов выборки, попавших в него. Гистограмма представляет собой набор чисел  , обычно изображаемый в виде решетчатой диаграммы. Количество интервалов при заданном объеме выборки выбирается исходя из компромисса между точностью оценивания и разрешением (степенью подробности) гистограммы.

, обычно изображаемый в виде решетчатой диаграммы. Количество интервалов при заданном объеме выборки выбирается исходя из компромисса между точностью оценивания и разрешением (степенью подробности) гистограммы.

^

Корреляционно-спектральная теория случайных процессов

Если интересоваться только моментными характеристиками первого и второго порядка, которые определяют свойство стационарности в широком смысле, то описание стационарного СП осуществляется на уровне автокорреляционной функции  и спектральной плотности мощности

и спектральной плотности мощности  , связанных парой преобразований Фурье (теорема Винера–Хинчина

):

, связанных парой преобразований Фурье (теорема Винера–Хинчина

):

,

,  .

.

Очевидно, СПМ – неотрицательная

функция. Если процесс имеет ненулевое математическое ожидание , то к СПМ добавляется слагаемое  .

.

Для вещественного процесса АКФ и СПМ – четные вещественные функции.

Иногда можно ограничиться числовыми характеристиками – интервалом корреляции и эффективной шириной спектра. ^ Интервал корреляции определяют по-разному, в частности, известны следующие определе

Мы имели много случаев убедиться в том, какое большое значение в теории вероятностей имеют основные числовые характеристики случайных величин: математическое ожидание и дисперсия - для одной случайной величины, математические ожидания и корреляционная матрица - для системы случайных величин. Искусство пользоваться числовыми характеристиками, оставляя по возможности в стороне законы распределения, - основа прикладной теории вероятностей. Аппарат числовых характеристик представляет собой весьма гибкий и мощный аппарат, позволяющий сравнительно просто решать многие практические задачи.

Совершенно аналогичным аппаратом пользуются и в теории случайных функций. Для случайных функций также вводятся простейшие основные характеристики, аналогичные числовым характеристикам случайных величин, и устанавливаются правила действий с этими характеристиками. Такой аппарат оказывается достаточным для решения многих практических задач.

В отличие от числовых характеристик случайных величин, предоставляющих собой определенные числа, характеристики случайных функций представляют собой в общем случае не числа, а функции.

Математическое ожидание случайной функции определяется следующим образом. Рассмотрим сечение случайной функции при фиксированном . В этом сечении мы имеем обычную случайную величину; определим ее математическое ожидание. Очевидно, в общем случае оно зависит от , т. е. представляет собой некоторую функцию :

![]() . (15.3.1)

. (15.3.1)

Таким образом, математическим ожиданием случайной функции называется неслучайная функция , которая при каждом значении аргумента равна математическому ожиданию соответствующего сечения случайной функции.

По смыслу математическое ожидание случайной функции есть некоторая средняя функция, около которой различным образом варьируются конкретные реализации случайной функции.

На рис. 15.3.1 тонкими линиями показаны реализации случайной функции, жирной линией - ее математическое ожидание.

Аналогичным образом определяется дисперсия случайной функции.

Дисперсией случайной функции называется неслучайная функция , значение которой для каждого равно дисперсии соответствующего сечения случайной функции:

![]() . (15.3.2)

. (15.3.2)

Дисперсия случайной функции при каждом характеризует разброс возможных реализаций случайной функции относительно среднего, иными словами, «степень случайности» случайной функции.

Очевидно, есть неотрицательная функция. Извлекая из нее квадратный корень, получим функцию - среднее квадратическое отклонение случайной функции:

![]() . (15.3.3)

. (15.3.3)

Математическое ожидание и дисперсия представляют собой весьма важные характеристики случайной функции; однако для описания основных особенностей случайной функции этих характеристик недостаточно. Чтобы убедиться в этом, рассмотрим две случайные функции и , наглядно изображенные семействами реализаций на рис. 15.3.2 и 15.3.3.

У случайных функций и примерно одинаковые математические ожидания и дисперсии; однако характер этих случайных функций резко различен. Для случайной функции (рис. 15.3.2) характерно плавное, постепенное изменение. Если, например, в точке случайная функция приняла значение, заметно превышающее среднее, то весьма вероятно, что и в точке она также примет значение больше среднего. Для случайной функции характерна ярко выраженная зависимость между ее значениями при различных . Напротив, случайная функция (рис. 15.3.3) имеет резко колебательный характер с неправильными, беспорядочными колебаниями. Для такой случайной функции характерно быстрое затухание зависимости между ее значениями по мере увеличения расстояния по между ними.

Очевидно, внутренняя структура обоих случайных процессов совершенно различна, но это различие не улавливается ни математическим ожиданием, ни дисперсией; для его описания необходимо вести специальную характеристику. Эта характеристика называется корреляционной функцией (иначе - автокорреляционной функцией). Корреляционная функция характеризует степень зависимости между сечениями случайной функции, относящимися к различным .

Пусть имеется случайная функция (рис. 15.3.4); рассмотрим два ее сечения, относящихся к различным моментам: и , т. е. две случайные величины и . Очевидно, что при близких значениях и величины и связаны тесной зависимостью: если величина приняла какое-то значение, то и величина с большой вероятностью примет значение, близкое к нему. Очевидно также, что при увеличении интервала между сечениями , зависимость величин и вообще должна убывать.

Степень зависимости величин и может быть в значительной мере охарактеризована их корреляционным моментом; очевидно, он является функцией двух аргументов и . Эта функция и называется корреляционной функцией.

Таким образом, корреляционной функцией случайной функции называется неслучайная функция двух аргументов , которая при каждой паре значений , равна корреляционному моменту соответствующих сечений случайной функции:

![]() ,

(15.3.4)

,

(15.3.4)

![]() ,

,![]() .

.

Вернемся к примерам случайных функций и (рис. 15.3.2 и 15.3.3). Мы видим теперь, что при одинаковых математических ожиданиях и дисперсиях случайные функции и имеют совершенно различные корреляционные функции. Корреляционная функция случайной функции медленно убывает по мере увеличения промежутка ; напротив, корреляционная функция случайной функции быстро убывает с увеличением этого промежутка.

Выясним, во что обращается корреляционная функция , когда ее аргументы совпадают. Полагая , имеем:

![]() , (15.3.5)

, (15.3.5)

т. е. при корреляционная функция обращается в дисперсию случайной функции.

Таким образом, необходимость в дисперсии как отдельной характеристике случайной функции отпадает: в качестве основных характеристик случайной функции достаточно рассматривать ее математическое ожидание и корреляционную функцию.

Так как корреляционный момент двух случайных величин и не зависит от последовательности, в которой эти величины рассматриваются, то корреляционная функция симметрична относительно своих аргументов, т. е. не меняется при перемене аргументов местами:

![]() . (15.3.6)

. (15.3.6)

Если изобразить корреляционную функцию в виде поверхности, то эта поверхность будет симметрична относительно вертикальной плоскости , проходящей через биссектрису угла (рис. 15.3.5).

Заметим, что свойства корреляционной функции естественно вытекают из свойств корреляционной матрицы системы случайных величин. Действительно, заменим приближенно случайную функцию системой случайных величин . При увеличении и соответственном уменьшении промежутков между аргументами корреляционная матрица системы, представляющая собой таблицу о двух входах, в пределе переходит в функцию двух непрерывно изменяющихся аргументов, обладающую аналогичными свойствами. Свойство симметричности корреляционной матрицы относительно главной диагонали переходит в свойство симметричности корреляционной функции (15.3.6). По главной диагонали корреляционной матрицы стоят дисперсии случайных величин; аналогично при корреляционная функция обращается в дисперсию .

На практике, если требуется построить корреляционную функцию случайной функции , обычно поступают следующим образом: задаются рядом равноотстоящих значений аргумента и строят корреляционную матрицу полученной системы случайных величин. Эта матрица есть не что иное, как таблица значений корреляционной функции для прямоугольной сетки значений аргументов на плоскости . Далее, путем интерполирования или аппроксимации можно построить функцию двух аргументов .

Вместо корреляционной функции можно пользоваться нормированной корреляционной функцией:

![]() , (15.3.7)

, (15.3.7)

которая представляет собой коэффициент корреляции величин , . Нормированная корреляционная функция аналогична нормированной корреляционной матрице системы случайных величин. При нормированная корреляционная функция равна единице.