Количественное изучение биологических явлений обязательно требует создания гипотез, с помощью которых можно объяснить эти явления. Чтобы проверить ту или иную гипотезу ставят серию специальных опытов и полученные фактические данные сопоставляют с теоретически ожидаемыми согласно данной гипотезе. Если есть совпадениеэто может быть достаточным основанием для принятия гипотезы. Если же опытные данные плохо согласуются с теоретически ожидаемыми, возникает большое сомнение в правильности предложенной гипотезы.

Степень соответствия фактических данных ожидаемым (гипотетическим) измеряется критерием соответствия хи-квадрат:

фактически наблюдаемое значение признака вi- той;теоретически ожидаемое число или признак (показатель) для данной группы,k число групп данных.

Критерий был предложен К.Пирсоном в 1900 г. и иногда его называют критерием Пирсона.

Задача. Среди 164 детей, наследовавших от одного из родителей фактор, а от другогофактор, оказалось 46 детей с фактором, 50с фактором, 68с тем и другим,. Рассчитать ожидаемые частоты при отношении 1:2:1 между группами и определить степень соответствия эмпирических данных с помощью критерия Пирсона.

Решение: Отношение наблюдаемых частот 46:68:50, теоретически ожидаемых 41:82:41.

Зададимся уровнем значимости равным 0,05. Табличное значение критерия Пирсона для этого уровня значимости при числе степеней свободы, равном оказалось равным 5,99. Следовательно гипотезу о соответствии экспериментальных данных теоретическим можно принять, так как, .

Отметим, что при вычислении критерия хи-квадрат мы уже не ставим условия о непременной нормальности распределения. Критерий хи-квадрат может использоваться для любых распределений, которые мы вольны сами выбирать в своих предположениях. В этом есть некоторая универсальность этого критерия.

Еще одно приложение критерия Пирсона это сравнение эмпирического распределения с нормальным распределением Гаусса. При этом он может быть отнесен к группе критериев проверки нормальности распределения. Единственным ограничением является тот факт, что общее число значений (вариант) при пользовании этим критерием должно быть достаточно велико (не менее 40), и число значений в отдельных классах (интервалах) должно быть не менее 5. В противном случае следует объединять соседние интервалы. Число степенй свободы при проверке нормальности распределения должно вычисляться как:.

Критерий Фишера.

Этот параметрический критерий служит для проверки нулевой гипотезы о равенстве дисперсий нормально распределенных генеральных совокупностей.

![]() Или.

Или.

При малых объемах выборок применение критерия Стьюдента может быть корректным только при условии равенства дисперсий. Поэтому прежде чем проводить проверку равенства выборочных средних значений, необходимо убедиться в правомочности использования критерия Стьюдента.

где N 1 , N 2 объемы выборок, 1 , 2 числа степеней свободы для этих выборок.

При пользовании таблицами следует обратить внимание, что число степеней свободы для выборки с большей по величине дисперсией выбирается как номер столбца таблицы, а для меньшей по величине дисперсии как номер строки таблицы.

Для уровня значимости по таблицам математической статистики находим табличное значение. Если, то гипотеза о равенстве дисперсий отклоняется для выбранного уровня значимости.

Пример. Изучали влияние кобальта на массу тела кроликов. Опыт проводился на двух группах животных: опытной и контрольной. Опытные получали добавку к рациону в виде водного раствора хлористого кобальта. За время опыта прибавки в весе составили в граммах:

|

Контроль |

|

1. Сопоставляемые показатели должны быть измерены в номинальной шкале (например, пол пациента - мужской или женский) или в порядковой (например, степень артериальной гипертензии, принимающая значения от 0 до 3).

2. Данный метод позволяет проводить анализ не только четырехпольных таблиц, когда и фактор, и исход являются бинарными переменными, то есть имеют только два возможных значения (например, мужской или женский пол, наличие или отсутствие определенного заболевания в анамнезе...). Критерий хи-квадрат Пирсона может применяться и в случае анализа многопольных таблиц, когда фактор и (или) исход принимают три и более значений.

3. Сопоставляемые группы должны быть независимыми, то есть критерий хи-квадрат не должен применяться при сравнении наблюдений "до-"после". В этих случаях проводится тест Мак-Немара (при сравнении двух связанных совокупностей) или рассчитывается Q-критерий Кохрена (в случае сравнения трех и более групп).

4. При анализе четырехпольных таблиц ожидаемые значения в каждой из ячеек должны быть не менее 10. В том случае, если хотя бы в одной ячейке ожидаемое явление принимает значение от 5 до 9, критерий хи-квадрат должен рассчитываться с поправкой Йейтса . Если хотя бы в одной ячейке ожидаемое явление меньше 5, то для анализа должен использоваться точный критерий Фишера .

5. В случае анализа многопольных таблиц ожидаемое число наблюдений не должно принимать значения менее 5 более чем в 20% ячеек.

Для расчета критерия хи-квадрат необходимо:

1. Рассчитываем ожидаемое количество наблюдений для каждой из ячеек таблицы сопряженности (при условии справедливости нулевой гипотезы об отсутствии взаимосвязи) путем перемножения сумм рядов и столбцов с последующим делением полученного произведения на общее число наблюдений. Общий вид таблицы ожидаемых значений представлен ниже:

| Исход есть (1) | Исхода нет (0) | Всего | |

| Фактор риска есть (1) | (A+B)*(A+C) / (A+B+C+D) | (A+B)*(B+D)/ (A+B+C+D) | A + B |

| Фактор риска отсутствует (0) | (C+D)*(A+C)/ (A+B+C+D) | (C+D)*(B+D)/ (A+B+C+D) | C + D |

| Всего | A + C | B + D | A+B+C+D |

2. Находим значение критерия χ 2 по следующей формуле:

где i – номер строки (от 1 до r), j – номер столбца (от 1 до с), O ij – фактическое количество наблюдений в ячейке ij, E ij – ожидаемое число наблюдений в ячейке ij.

В том случае, если число ожидаемого явления меньше 10 хотя бы в одной ячейке, при анализе четырехпольных таблиц должен рассчитываться критерий хи-квадрат с поправкой Йейтса . Данная поправка позволяет уменьшить вероятность ошибки первого типа, т.е обнаружения различий там, где их нет. Поправка Йейтса заключается в вычитании 0,5 из абсолютного значения разности между фактическим и ожидаемым количеством наблюдений в каждой ячейке, что ведет к уменьшению величины критерия хи-квадрат.

Формула для расчета критерия χ 2 с поправкой Йейтса следующая:

3. Определяем число степеней свободы по формуле: f = (r – 1) × (c – 1) . Ссответственно, для четырехпольной таблицы, в которой 2 ряда (r = 2) и 2 столбца (c = 2), число степеней свободы составляет f 2x2 = (2 - 1)*(2 - 1) = 1.

4. Сравниваем значение критерия χ 2 с критическим значением при числе степеней свободы f (по таблице).

Данный алгоритм применим как для четырехпольных, так и для многопольных таблиц.

Как интерпретировать значение критерия хи-квадрат Пирсона?

В том случае, если полученное значение критерия χ 2 больше критического, делаем вывод о наличии статистической взаимосвязи между изучаемым фактором риска и исходом при соответствующем уровне значимости.

Пример расчета критерия хи-квадрат Пирсона

Определим статистическую значимость влияния фактора курения на частоту случаев артериальной гипертонии по рассмотренной выше таблице:

1. Рассчитываем ожидаемые значения для каждой ячейки:

2. Находим значение критерия хи-квадрат Пирсона:

χ 2 = (40-33.6) 2 /33.6 + (30-36.4) 2 /36.4 + (32-38.4) 2 /38.4 + (48-41.6) 2 /41.6 = 4.396.

3. Число степеней свободы f = (2-1)*(2-1) = 1. Находим по таблице критическое значение критерия хи-квадрат Пирсона, которое при уровне значимости p=0.05 и числе степеней свободы 1 составляет 3.841.

4. Сравниваем полученное значение критерия хи-квадрат с критическим: 4.396 > 3.841, следовательно зависимость частоты случаев артериальной гипертонии от наличия курения - статистически значима. Уровень значимости данной взаимосвязи соответствует p<0.05.

| Число степеней свободы, f | χ 2 при p=0.05 | χ 2 при p=0.01 |

| 3.841 | 6.635 | |

| 5.991 | 9.21 | |

| 7.815 | 11.345 | |

| 9.488 | 13.277 | |

| 11.07 | 15.086 | |

| 12.592 | 16.812 | |

| 14.067 | 18.475 | |

| 15.507 | 20.09 | |

| 16.919 | 21.666 | |

| 18.307 | 23.209 | |

| 19.675 | 24.725 | |

| 21.026 | 26.217 | |

| 22.362 | 27.688 | |

| 23.685 | 29.141 | |

| 24.996 | 30.578 | |

| 26.296 | ||

| 27.587 | 33.409 | |

| 28.869 | 34.805 | |

| 30.144 | 36.191 | |

| 31.41 | 37.566 |

Хи-квадрат критерий – универсальный метод проверки согласия результатов эксперимента и используемой статистической модели.

Расстояние Пирсона X 2

Пятницкий А.М.

Российский Государственный Медицинский Университет

В 1900 году Карл Пирсон предложил простой, универсальный и эффективный способ проверки согласия между предсказаниями модели и опытными данными. Предложенный им “хи-квадрат критерий” – это самый важный и наиболее часто используемыйстатистический критерий. Большинство задач, связанных с оценкой неизвестных параметров модели и проверки согласия модели и опытных данных, можно решить с его помощью.

Пусть имеется априорная (“до опытная”) модельизучаемого объекта или процесса (в статистике говорят о “нулевой гипотезе” H 0), и результаты опыта с этим объектом. Следует решить, адекватна ли модель (соответствует ли она реальности)? Не противоречат ли результаты опыта нашим представлениям о том, как устроена реальность, или иными словами - следует ли отвергнуть H 0 ? Часто эту задачу можно свести к сравнению наблюдаемых (O i = Observed )и ожидаемых согласно модели (E i =Expected ) средних частот появления неких событий. Считается, что наблюдаемые частоты получены в серии N независимых (!) наблюдений, производимых в постоянных (!) условиях. В результате каждого наблюдения регистрируется одно из M событий. Эти события не могут происходить одновременно (попарно несовместны) и одно из них обязательно происходит (их объединение образует достоверное событие). Совокупность всех наблюдений сводится к таблице (вектору) частот {O i }=(O 1 ,… O M ), которая полностью описывает результаты опыта. Значение O 2 =4 означает, что событие номер 2 произошло 4 раза. Сумма частот O 1 +… O M =N . Важно различать два случая: N – фиксировано, неслучайно, N – случайная величина. При фиксированном общем числе опытов N частоты имеют полиномиальное распределение. Поясним эту общую схему простым примером.

Применение хи-квадрат критерия для проверки простых гипотез.

Пусть модель (нулевая гипотеза H 0) заключается в том, что игральная кость является правильной - все грани выпадают одинаково часто с вероятностью p i =1/6, i =, M=6. Проведен опыт, который состоял в том, что кость бросили 60 раз (провели N =60 независимых испытаний). Согласно модели мы ожидаем, что все наблюдаемые частоты O i появления 1,2,... 6 очков должны быть близки к своим средним значениям E i =Np i =60∙(1/6)=10. Согласно H 0 вектор средних частот {E i }={Np i }=(10, 10, 10, 10, 10, 10). (Гипотезы, в которых средние частоты полностью известны до начала опыта, называются простыми.) Если бы наблюдаемый вектор {O i } был равен (34,0,0,0,0,26) , то сразу ясно, что модель неверна – кость не может быть правильной, так как60 раз выпадали только 1 и 6. Вероятность такого события для правильной игральной кости ничтожна: P = (2/6) 60 =2.4*10 -29 . Однако появление столь явных расхождений между моделью и опытом исключение. Пусть вектор наблюдаемых частот {O i } равен (5, 15, 6, 14, 4, 16). Согласуется ли это с H 0 ? Итак, нам надо сравнить два вектора частот {E i } и {O i }. При этом вектор ожидаемых частот {E i } не случаен, а вектор наблюдаемых {O i } случаен – при следующем опыте (в новой серии из 60 бросков) он окажется другим. Полезно ввести геометрическую интерпретацию задачи и считать, что в пространстве частот (в данном случае 6 мерном) даны две точки с координатами(5, 15, 6, 14, 4, 16) и (10, 10, 10, 10, 10, 10). Достаточно ли далеко они удалены друг от друга, чтобы счесть это несовместным сH 0 ? Иными словами нам надо:

- научиться измерять расстояния между частотами (точками пространства частот),

- иметь критерий того, какое расстояние следует считать слишком (“неправдоподобно”) большим, то есть несовместным с H 0 .

Квадрат обычного евклидова расстояниябыл бы равен:

X 2 Euclid = S (O i -E i) 2 = (5-10) 2 +(15-10) 2 + (6-10) 2 +(14-10) 2 +(4-10) 2 +(16-10) 2

При этом поверхности X 2 Euclid = const всегда являются сферами, если мы фиксируем значения E i и меняем O i . Карл Пирсон заметил, что использовать евклидово расстояние в пространстве частот не следует. Так, неправильно считать, что точки (O =1030 и E =1000) и (O =40 и E =10) находятся на равном расстоянии друг от друга, хотя в обоих случаях разность O -E =30. Ведь чем больше ожидаемая частота, тем большие отклонения от нее следует считать возможными. Поэтому точки (O =1030 и E =1000) должны считаться “близкими”, а точки (O =40 и E =10) “далекими” друг от друга. Можно показать, что если верна гипотеза H 0 , то флуктуации частоты O i относительно E i имеют величину порядка квадратного корня(!) из E i . Поэтому Пирсон предложил при вычислении расстояния возводить в квадраты не разности (O i -E i ), а нормированные разности (O i -E i )/E i 1/2 . Итак, вот формула, по которой вычисляется расстояние Пирсона (фактически это квадрат расстояния):

X 2 Pearson = S ((O i -E i )/E i 1/2) 2 =S (O i -E i ) 2 /E i

В нашем примере:

X 2 Pearson = (5-10) 2 /10+(15-10) 2 /10 +(6-10) 2 /10+(14-10) 2 /10+(4-10) 2 /10+(16-10) 2 /10=15.4

Для правильной игральной кости все ожидаемые частоты E i одинаковы, но обычно они различны, поэтому поверхности, на которых расстояние Пирсона постоянно (X 2 Pearson =const) оказываются уже эллипсоидами, а не сферами.

Теперь после того, как выбрана формула для подсчета расстояний, необходимо выяснить, какие расстояния следует считать “не слишком большими” (согласующимися с H 0).Так, например, что можно сказать по поводу вычисленного нами расстояния 15.4? В каком проценте случаев (или с какой вероятностью), проводя опыты с правильной игральной костью, мы получали бы расстояние большее, чем 15.4? Если этот процент будет мал (<0.05), то H 0 надо отвергнуть. Иными словами требуется найти распределение длярасстояния Пирсона. Если все ожидаемые частоты E i не слишком малы (≥5), и верна H 0 , то нормированные разности (O i - E i )/E i 1/2 приближенно эквивалентны стандартным гауссовским случайным величинам: (O i - E i )/E i 1/2 ≈N (0,1). Это, например, означает, что в 95% случаев| (O i - E i )/E i 1/2 | < 1.96 ≈ 2 (правило “двух сигм”).

Пояснение . Число измерений O i , попадающих в ячейку таблицы с номером i , имеет биномиальное распределение с параметрами: m =Np i =E i ,σ =(Np i (1-p i )) 1/2 , где N - число измерений (N »1), p i – вероятность для одного измерения попасть в данную ячейку (напомним, что измерения независимы и производятся в постоянных условиях). Если p i мало, то: σ≈(Np i ) 1/2 =E i и биномиальное распределение близко к пуассоновскому, в котором среднее число наблюдений E i =λ, а среднее квадратичное отклонение σ=λ 1/2 = E i 1/2 . Для λ≥5пуассоновскоераспределение близко к нормальному N (m =E i =λ, σ=E i 1/2 =λ 1/2), а нормированная величина (O i - E i )/E i 1/2 ≈ N (0,1).

Пирсон определил случайную величину χ 2 n – “хи-квадрат с n степенями свободы”, как сумму квадратов n независимых стандартных нормальных с.в.:

χ 2 n = T 1 2 + T 2 2 + …+ T n 2 , гдевсе T i = N(0,1) - н. о. р. с. в.

Попытаемся наглядно понять смысл этой важнейшей в статистике случайной величины. Для этого на плоскости (при n

=2) или в пространстве (при n

=3) представим облако точек, координаты которых независимы и имеют стандартное нормальное распределениеf

T

(x

) ~exp

(-x

2 /2). На плоскости согласно правилу “двух сигм”, которое независимо применяется к обеим координатам, 90% (0.95*0.95≈0.90) точек заключены внутри квадрата(-2 f χ 2 2 (a) =

Сexp(-a/2) = 0.5exp(-a/2).

При достаточно большом числе степеней свободы n

(n

>30) хи-квадрат распределение приближается к нормальному: N

(m

= n

; σ = (2n

) ½). Это следствие “центральной предельной теоремы”: сумма одинаково распределенных величин имеющих конечную дисперсию приближается к нормальному закону с ростом числа слагаемых. Практически надо запомнить, что средний квадрат расстояния равен m

(χ

2 n

)=n

, а его дисперсия σ 2 (χ

2 n

)=2n

. Отсюда легко заключить какие значения хи-квадрат следует считать слишком малыми и слишком большими:большая часть распределения заключена в пределахот n

-2∙(2n

) ½ до n

+2∙(2n

) ½ . Итак, расстояния Пирсона существенно превышающие n

+2∙ (2n

) ½ , следует считать неправдоподобно большими (не согласующимися с H

0) . Если результат близок к n

+2∙(2n

) ½ , то следует воспользоваться таблицами, в которых можно точно узнать в какой доле случаев могут появляться такие и большие значения хи-квадрат. Важно знать, как правильно выбирать значение числа степеней свободы (number degrees of freedom , сокращенно n

.d

.f

.). Казалось естественным считать, что n

просто равно числу разрядов: n

=M

. В своей статье Пирсон так и предположил. В примере с игральной костью это означало бы, что n

=6. Однако спустя несколько лет было показано, что Пирсон ошибся. Число степеней свободы всегда меньше числа разрядов, если между случайными величинами O i

есть связи. Для примера с игральной костью сумма O i

равна 60, и независимо менять можно лишь 5 частот, так что правильное значение n

=6-1=5. Для этого значения n

получаем n

+2∙(2n

) ½ =5+2∙(10) ½ =11.3. Так как15.4>11.3, то гипотезу H

0 - игральная кость правильная, следует отвергнуть. После выяснения ошибки, существовавшие таблицы χ

2 пришлось дополнить, так как исходно в них не было случая n

=1, так как наименьшее число разрядов =2. Теперь же оказалось, что могут быть случаи, когда расстояние Пирсона имеет распределение χ

2 n

=1 . Пример

. При 100 бросаниях монеты число гербов равно O

1 = 65, а решек O

2 = 35. Число разрядов M

=2. Если монета симметрична, то ожидаемые частотыE

1 =50, E

2 =50. X 2 Pearson =

S

(O i -E i) 2 /E i = (65-50) 2 /50 + (35-50) 2 /50 = 2*225/50 = 9.

Полученное значение следует сравнивать с теми, которые может принимать случайная величина χ

2 n

=1 , определенная как квадрат стандартной нормальной величины χ

2 n

=1 =T

1 2 ≥ 9 ó

T

1 ≥3 или T

1 ≤-3. Вероятность такого события весьма мала P

(χ

2 n

=1 ≥9) = 0.006. Поэтому монету нельзя считать симметричной: H

0 следует отвергнуть. То, что число степеней свободы не может быть равно числу разрядов видно из того, что сумма наблюдаемых частот всегда равна сумме ожидаемых, например O

1 +O

2 =65+35 = E

1 +E

2 =50+50=100. Поэтому случайные точки с координатами O

1 и O

2 располагаются на прямой: O

1 +O

2 =E

1 +E

2 =100 и расстояние до центра оказывается меньше, чем, если бы этого ограничения не было, и они располагались на всей плоскости. Действительно для двух независимые случайных величин с математическими ожиданиями E

1 =50, E

2 =50, сумма их реализаций не должна быть всегда равной 100 – допустимыми были бы, например, значения O

1 =60, O

2 =55. Пояснение

. Сравним результат, критерия Пирсона при M

=2 с тем, что дает формула Муавра Лапласа при оценке случайных колебаний частоты появления события ν

=K

/N

имеющего вероятность p

в серии N

независимых испытаний Бернулли (K

-число успехов): χ

2 n

=1 =S

(O i

-E i

) 2 /E i

= (O

1 -E

1) 2 /E

1 + (O

2 -E

2) 2 /E

2 = (Nν

-Np

) 2 /(Np

) + (N

(1-ν

)-N

(1-p

)) 2 /(N

(1-p

))= =(Nν-Np) 2 (1/p + 1/(1-p))/N=(Nν-Np) 2 /(Np(1-p))=((K-Np)/(Npq) ½) 2 = T 2

Величина T

=(K

-Np

)/(Npq

) ½ = (K

-m

(K

))/σ(K

) ≈N

(0,1) при σ(K

)=(Npq

) ½ ≥3. Мы видим, что в этом случае результат Пирсона в точности совпадает с тем, что дает применение нормальной аппроксимации для биномиального распределения. До сих пор мы рассматривали простые гипотезы, для которых ожидаемые средние частоты E i

полностью известны заранее. О том, как правильно выбирать число степеней свободы для сложных гипотез см. ниже. В примерах с правильной игральной костью и монетой ожидаемые частоты можно было определить до(!) проведения опыта. Подобные гипотезы называются “простыми”. На практике чаще встречаются “сложные гипотезы”. При этом для того, чтобы найти ожидаемые частоты E i

надо предварительно оценить одну или несколько величин (параметры модели), и сделать это можно только, воспользовавшись данными опыта. В результате для “сложных гипотез” ожидаемые частоты E i

оказываются зависящими от наблюдаемых частот O i

и потому сами становятся случайными величинами, меняющимися в зависимости от результатов опыта. В процессе подбора параметров расстояние Пирсона уменьшается – параметры подбираются так, чтобы улучшить согласие модели и опыта. Поэтому число степеней свободы должно уменьшаться. Как оценить параметры модели? Есть много разных способов оценки – “метод максимального правдоподобия”, “метод моментов”, “метод подстановки”. Однако можно не привлекать никаких дополнительных средств и найти оценки параметров минимизируя расстояние Пирсона. В докомпьютерную эпоху такой подход использовался редко: приручных расчетах он неудобен и, как правило, не поддается аналитическому решению. При расчетах на компьютере численная минимизация обычно легко осуществляется, а преимуществом такого способа является его универсальность. Итак, согласно “методу минимизации хи-квадрат”, мы подбираем значения неизвестных параметров так, чтобы расстояние Пирсона стало наименьшим. (Кстати, изучая изменения этого расстояния при небольших смещениях относительно найденного минимума можно оценить меру точности оценки: построить доверительные интервалы.) После того как параметры и само это минимальное расстояние найдено опять требуется ответить на вопрос достаточно ли оно мало. Общая последовательность действий такова:

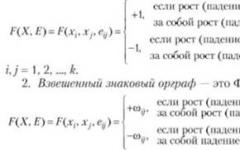

P

(χ

2 n

> χ

2 крит)=1-α, где α – “уровень значимости” или ”размер критерия” или “величина ошибки первого рода” (типичное значение α=0.05). Обычно число степеней свободы n

вычисляют по формуле n

= (число разрядов) – 1 – (число оцениваемых параметров) Если X

2 > χ

2 крит, то гипотеза H

0 отвергается, в противном случае принимается. В α∙100% случаев (то есть достаточно редко) такой способ проверки H

0 приведет к “ошибке первого рода”: гипотеза H

0 будет отвергнута ошибочно. Пример.

При исследовании 10 серий из 100 семян подсчитывалось число зараженных мухой-зеленоглазкой. Получены данные: O i

=(16, 18, 11, 18, 21, 10, 20, 18, 17, 21); Здесь неизвестен заранее вектор ожидаемых частот. Если данные однородны и получены для биномиального распределения, то неизвестен один параметр доля p

зараженных семян. Заметим, что в исходной таблице фактически имеется не 10 а 20 частот, удовлетворяющих 10 связям: 16+84=100, … 21+79=100.

X 2 = (16-100p) 2 /100p +(84-100(1-p)) 2 /(100(1-p))+…+

(21-100p) 2 /100p +(79-100(1-p)) 2 /(100(1-p))

Объединяя слагаемые в пары (как в примере с монетой), получаем ту форму записи критерия Пирсона, которую обычно пишут сразу: X 2 = (16-100p) 2 /(100p(1-p))+…+ (21-100p) 2 /(100p(1-p)).

Теперь если в качестве метода оценки р использовать минимум расстояния Пирсона, то необходимо найти такое p

, при котором X

2 =min

. (Модель старается по возможности “подстроиться” под данные эксперимента.) Критерий Пирсона - это наиболее универсальный из всех используемых в статистике. Его можно применять к одномерным и многомерным данным, количественным и качественным признакам. Однако именно в силу универсальности следует быть осторожным, чтобы не совершить ошибки. 1.Выбор разрядов.

Оценка параметров

. Использование “самодельных”, неэффективных методов оценки может привести к завышенным значениям расстояния Пирсона. Выбор правильного числа степеней свободы

. Если оценки параметров делаются не по частотам, а непосредственно по данным (например, в качестве оценки среднего берется среднее арифметическое), то точное число степеней свободы n

неизвестно. Известно лишь, что оно удовлетворяет неравенству: (число разрядов – 1 – число оцениваемых параметров) < n

< (число разрядов – 1) Поэтому необходимо сравнить X

2 с критическими значениями χ

2 крит вычисленными во всем этом диапазоне n

. Как интерпретировать неправдоподобно малые значения хи-квадрат?

Следует ли считать монету симметричной, если при 10000 бросаний, она 5000 раз выпала гербом? Ранее многие статистики считали, что H

0 при этом также следует отвергнуть. Теперь предлагается другой подход: принять H

0 , но подвергнуть данные и методику их анализа дополнительной проверке. Есть две возможности: либо слишком малое расстояние Пирсона означает, что увеличение числа параметров модели не сопровождалось должным уменьшением числа степеней свободы, или сами данные были сфальсифицированы (возможно ненамеренно подогнаны под ожидаемый результат). Пример.

Два исследователя А и B

подсчитывали долю рецессивных гомозигот aa

во втором поколении при моногибридном скрещивании AA

* aa

. Согласно законам Менделя эта доля равна 0.25. Каждый исследователь провел по 5 опытов, и в каждом опыте изучалось 100 организмов. Результаты А: 25, 24, 26, 25, 24. Вывод исследователя: закон Менделя справедлив(?). Результаты B

: 29, 21, 23, 30, 19. Вывод исследователя: закон Менделя не справедлив(?). Однако закон Менделя имеет статистическую природу, и количественный анализ результатов меняет выводы на обратные! Объединив пять опытов в один, мы приходим к хи-квадрат распределению с 5 степенями свободы (проверяется простая гипотеза): X 2 A = ((25-25) 2 +(24-25) 2 +(26-25) 2 +(25-25) 2 +(24-25) 2)/(100∙0.25∙0.75)=0.16

X 2 B = ((29-25) 2 +(21-25) 2 +(23-25) 2 +(30-25) 2 +(19-25) 2)/(100∙0.25∙0.75)=5.17

Среднее значение m

[χ

2 n

=5 ]=5, среднеквадратичное отклонение σ[χ

2 n

=5 ]=(2∙5) 1/2 =3.2. Поэтому без обращения к таблицам ясно, что значение X

2 B

типично, а значение X

2 A

неправдоподобно мало. Согласно таблицам P

(χ

2 n

=5 <0.16)<0.0001. Этот пример – адаптированный вариант реального случая, произошедшего в 1930-е годы (см. работу Колмогорова “Об еще одном доказательстве законов Менделя”). Любопытно, что исследователь A

был сторонником генетики, а исследователь B

– ее противником. Путаница в обозначениях.

Следует различать расстояние Пирсона, которое при своем вычислении требует дополнительных соглашений,от математического понятия случайной величины хи-квадрат. Расстояние Пирсона при определенных условиях имеет распределение близкое к хи-квадрат с n

степенями свободы. Поэтому желательно НЕ обозначать расстояние Пирсона символом χ

2 n

, а использовать похожее, но другое обозначение X

2. . Критерий Пирсона не всесилен.

Существует бесконечное множество альтернатив для H

0 , которые он не в состоянии учесть. Пусть вы проверяете гипотезу о том, что признак имел равномерное распределение, у вас имеется 10 разрядов и вектор наблюдаемых частот равен (130,125,121,118,116,115,114,113,111,110). Критерий Пирсона не c

может “заметить” того, что частоты монотонно уменьшаются и H

0 не будет отклонена. Если бы его дополнить критерием серий то да! Чтобы получить статистические критерии для таблиц сопряженности, щелкните на кнопке Statistics... (Статистика) в диалоговом окне Crosstabs.

Откроется диалоговое окно Crosstabs: Statistics (Таблицы сопряженности: Статистика) (см. рис. 11.9). Рис. 11.9:

Флажки в этом диалоговом окне позволяют выбрать один или несколько критериев. Тест хи-квадрат (X

2) Корреляции Меры связанности для переменных, относящихся к номинальной шкале Меры связанности для переменных, относящихся к порядковой шкале Меры связанности для переменных, относящихся к интервальной шкале Коэффициент каппа (к

) Мера риска Тест Мак-Немара Статистики Кохрана и Мантеля-Хэнзеля Эти критерии рассматриваются в двух последующих разделах, причем из-за того, что критерий хи-квадрат имеет большое значение в статистических вычислениях, ему посвящен отдельный раздел. Тест хи-квадрат (X

2)

При проведении теста хи-квадрат проверяется взаимная независимость двух переменных таблицы сопряженности и благодаря этому косвенно

выясняется зависимость обоих переменных.

Две переменные считаются взаимно независимыми, если наблюдаемые частоты (f о) в ячейках совпадают с ожидаемыми частотами (f e). Для того, чтобы провести тест хи-квадрат с помощью SPSS, выполните следующие действия: Выберите в меню команды Analyze (Анализ) Descriptive Statistics (Дескриптивные статистики) Crosstabs... (Таблицы сопряженности) Кнопкой Reset (Сброс) удалите возможные настройки. Перенесите переменную sex

в список строк, а переменную psyche

- в список столбцов. Щелкните на кнопке Cells...

(Ячейки). В диалоговом окне установите, кроме предлагаемого по умолчанию флажка Observed, еще флажки Expected и Standardized. Подтвердите выбор кнопкой Continue. Щелкните на кнопке Statistics...

(Статистика). Откроется описанное выше диалоговое окно Crosstabs: Statistics. Установите флажок Chi-square (Хи-квадрат). Щелкните на кнопке Continue, а в главном диалоговом окне - на ОК. Вы получите следующую таблицу сопряженности. Пол * Психическое состояние Таблица сопряженности

Кроме того, в окне просмотра будут показаны результаты теста хи-квадрат: Chi-Square Tests (Тесты хи-квадрат)

а. 2 cells (25,0%) have expected count less than 5. The minimum expected count is 2,49 (2 ячейки (25%) имеют ожидаемую частоту менее 5. Минимальная ожидаемая частота 2,49.) Для вычисления критерия хи-квадрат применяются три различных подхода: Обычно для вычисления критерия хи-квадрат используется формула Пирсона: Здесь вычисляется сумма квадратов стандартизованных остатков по всем полям таблицы сопряженности. Поэтому поля с более высоким стандартизованным остатком вносят более весомый вклад в

численное значение критерия хи-квадрат и, следовательно, - в значимый результат. Согласно правилу, приведенному в разделе 8.9 ,

стандартизованный остаток 2 (1,96) или более указывает на значимое расхождение между наблюдаемой и ожидаемой частотами в той или ячейке таблицы. В рассматриваемом примере формула Пирсона дает максимально значимую величину критерия хи-квадрат (р<0,0001). Если рассмотреть стандартизованные остатки в отдельных полях таблицы сопряженности,

то на основе вышеприведенного правила можно сделать вывод, что эта значимость в основном определяется полями, в которых переменная psyche

имеет значение "крайне неустойчивое".

У женщин это значение сильно повышено, а у мужчин - понижено. Корректность проведения

теста хи-квадрат определяется двумя условиями: Однако в рассматриваемом примере это условие выполняется не полностью. Как указывает примечание после таблицы теста хи-квадрат, 25% полей имеют ожидаемую частоту менее 5.

Однако, так как допустимый предел в 20% превышен лишь ненамного и эти поля, вследствие своего очень малого стандартизованного остатка, вносят весьма незначительную долю в величину критерия хи-квадрат,

это нарушение можно считать несущественным. Альтернативой формуле Пирсона для вычисления критерия хи-квадрат является поправка на правдоподобие: При большом объеме выборки формула Пирсона и подправленная формула дают очень близкие результаты. В нашем примере критерий хи-квадрат с поправкой на правдоподобие составляет 23,688.

Описание критерия

Назначения критерия

Критерий «хи-квадрат» Пирсона

Материалы лекции

Тема 6. Выявление различий в распределении признака

Критерий Пирсона: назначение критерия, его описание, область применения, алгоритм расчета.

Критерий Колмогорова–Смирнова для сравнения результатов количественного измерения: назначение критерия, его описание, область применения, алгоритм расчета.

При изучении данной темы необходимо учесть то, что оба критерия непараметрические, они оперируют частотами. Обратите особое внимание на правила принятия решения для рассмотренных критериев: эти правила могут быть противоположны. Внимательно изучите ограничения в применении критериев. После изучения материала лекции ответьте на контрольные вопросы, ответы занесите в конспект. Критерий «хи-квадрат» Пирсона может решать несколько задач, в том числе и сравнение распределений. Критерий χ 2 применяется в двух целях; 1) для сопоставления эмпирического

распределения признака с теоретическим -

равномерным, нормальным или каким-то иным; 2) для сопоставления двух, трех или более эмпирических

распределений одного и того же признака, то есть для проверки их однородности; 3) для оценки стохастической (вероятностной) независимости в системе случайных событий и т.д. Критерий χ 2 отвечает на вопрос о том, с одинаковой ли частотой встречаются разные значения признака в эмпирическом и теоретическом распределениях или в двух и более эмпирических распределениях. Преимущество метода состоит в том, что он позволяет сопоставлять распределения признаков, представленных в любой шкале, начиная от шкалы наименований. В самом простом случае альтернативного распределения ("да - нет", "допустил брак - не допустил брака", "решил задачу - не решил задачу" и т. п.) мы уже можем применить критерий χ 2 . 1. Объем выборки должен быть достаточно большим: N>30. При N<30 критерий χ 2 дает весьма приближенные значения. Точность критерия повышается при больших N. 2. Теоретическая частота для каждой ячейки таблицы не должна быть меньше 5: f ≥ 5.

Это означает, что если число разрядов задано заранее и не может быть изменено, то мы не можем применять метод χ 2 ,

не накопив определенного минимального числа наблюдений. Если, например, мы хотим проверить наши предположения о том, что частота обращений в телефонную службу Доверия неравномерно распределяются по 7 дням недели, то нам потребуется 5-7=35 обращений. Таким образом, если количество разрядов (k)

задано заранее, как в данном случае, минимальное число наблюдений (N min) определяется по формуле: .

3. Выбранные разряды должны "вычерпывать" все распределение, то есть охватывать весь диапазон вариативности признаков. При этом группировка на разряды должна быть одинаковой во всех сопоставляемых распределениях. 4. Необходимо вносить "поправку на непрерывность" при сопоставлении распределений признаков, которые принимают всего 2 значения. При внесении поправки значение χ 2 , уменьшается (см. пример с поправкой на непрерывность). 5. Разряды должны быть неперекрещивающимися: если наблюдение отнесено к одному разряду, то оно уже не может быть отнесено ни к какому другому разряду. Сумма наблюдений по разрядам всегда должна быть равна общему количеству наблюдений. Алгоритм расчета критерия χ 2

1. Составить таблицу взаимной сопряженности значений признаков следующего вида (по сути это двумерный вариационный ряд, в котором указываются частоты появления совместных значений признака) - таблица 19. В таблице располагаются условные частоты, которые мы обозначим в общем виде как f ij . Например, число градаций признака х

равно 3 (k=3), число градаций признака у

равно 4 (m=4); тогда i

меняется от 1 до k, а j

меняется от 1 до m. Таблица 19 2. Далее для удобства расчетов преобразуем исходную таблицу взаимной сопряженности в таблицу следующего вида (таблица 20), располагая столбики с условными частотами один под другим: Занести в таблицу наименования разрядов (столбцы 1 и 2) и соответствующие им эмпирические частоты (3-й столбец). Таблица 20 3. Рядом с каждой эмпирической частотой записать теоретическую частоту (4-й столбец), которая вычисляется по следующей формуле (итоговая частоты по соответствующей строчке умножается на итоговую частоту по соответствующему столбику и делится на общее количество наблюдений): 5. Определить число степеней свободы по формуле: ν=(k-1)(m-1)

,

где k -

количество разрядов признака х

, m - количество разрядов признака у

. Если ν=1, внести поправку на "непрерывность" и записать её в столбце 5а. Поправка на непрерывность состоит в том, что от разности между условной и теоретической частотой отнимается еще 0,5. Тогда заголовки столбиков в нашей таблице будет выглядеть следующим образом (таблица 21): Таблица 21 6. Возвести в квадрат полученные разности и занести их в 6-й столбец. 7. Разделить полученные квадраты разностей на теоретическую частоту и записать результаты в 7-й столбец. 8. Просуммировать значения 7-го столбца. Полученную сумму обозначить как χ 2 эмп. 9. Правило принятия решения:

Расчетное значение критерия необходимо сравнить с критическим (или табличным) значением. Критическое значение находится в зависимости от числа степеней свободы по таблице критических значений критерия χ 2 Пирсона (см. Приложение 1.6). Если χ 2 расч ≥ χ 2 табл, то расхождения между распределениями статистически достоверны, или признаки изменяются согласованно, или связь между признаками статистически значима. Если χ 2 расч < χ 2 табл, то расхождения между распределениями статистически недостоверны, или признаки изменяются несогласованно, или связи между признаками нет.Применение хи-квадрат критерия для проверки сложных гипотез

Важные моменты

Статистические критерии для таблиц сопряженности - Тест хи-квадрат

Психическое состояние

Total

Крайне неустойчивое

Неустойчивое

Устойчивое

Очень устойчивое

Пол

Женский

Count

16

18

9

1

44

Expected Count

7,9

16,6

17,0

2,5

44,0

Std. Residual

2,9

,3

-1,9

-.9

Мужской

Count

3

22

32

5

62

Expected Count

11,1

23,4

24,0

3,5

62,0

Std. Residual

-2,4

-,3

1,6

,8

Total

Count

19

40

41

6

106

Expected Count

19,0

40,0

41,0

6,0

106,0

Value (Значение)

df

Asymp. Sig. (2-sided)

(Асимптотическая значимость (двусторонняя))

Pearson Chi-Square

(Хи-квадрат по Пирсону)

22,455 (а)

3

,000

Likelihood Ratio

(Отношение правдоподобия)

23,688

3

,000

Linear-by-Linear Association

(Зависимость линейный-линейный)

20,391

1

,000

N of Valid Cases

(Кол-во допустимых случаев)

106

х i

у j

х 1

х 2

х 3

∑

у 1

f 11

f 21

f 31

f –1

у 2

f 12

f 22

f 32

f –2

у 3

f 13

f 23

f 33

f –3

у 4

f 14

f 24

f 34

f –4

∑

f 1–

f 2–

f 3–

N

х i

у j

f ij

f ij *

f ij – f ij *

(f ij – f ij *) 2

(f ij – f ij *) 2 / f ij *

1

2

3

4

5

6

7

х 1

у 1

f 11

f 11 *

х 1

у 2

f 12

f 12 *

х 1

у 3

f 13

f 13 *

х 1

у 4

f 14

f 14 *

х 2

у 1

f 21

f 21 *

х 2

у 2

f 22

f 22 *

х 2

у 3

f 23

f 23 *

х 2

у 4

f 24

f 24 *

х 3

у 1

f 31

f 31 *

х 3

у 2

f 32

f 32 *

х 3

у 3

f 33

f 33 *

х 3

у 4

f 34

f 34 *

∑=………….

х

у

f ij

f ij *

f ij – f ij *

f ij – f ij * – 0,5

(f ij – f ij * – 0,5) 2

(f ij – f ij * – 0,5) 2 / f ij *

1

2

3

4

5

5а

6

7