Если некоторая физическая величина зависит от другой величины, то эту зависимость можно исследовать, измеряя y при различных значениях x . В результате измерений получается ряд значений:

x 1 , x 2 , ..., x i , ... , x n ;

y 1 , y 2 , ..., y i , ... , y n .

По данным такого эксперимента можно построить график зависимости y = ƒ(x). Полученная кривая дает возможность судить о виде функции ƒ(x). Однако постоянные коэффициенты, которые входят в эту функцию, остаются неизвестными. Определить их позволяет метод наименьших квадратов. Экспериментальные точки, как правило, не ложатся точно на кривую. Метод наименьших квадратов требует, чтобы сумма квадратов отклонений экспериментальных точек от кривой, т.е. 2 была наименьшей.

На практике этот метод наиболее часто (и наиболее просто) используется в случае линейной зависимости, т.е. когда

y = kx или y = a + bx.

Линейная зависимость очень широко распространена в физике. И даже когда зависимость нелинейная, обычно стараются строить график так, чтобы получить прямую линию. Например, если предполагают, что показатель преломления стекла n связан с длиной λ световой волны соотношением n = a + b/λ 2 , то на графике строят зависимость n от λ -2 .

Рассмотрим зависимость y = kx (прямая, проходящая через начало координат). Составим величину φ сумму квадратов отклонений наших точек от прямой

Величина φ всегда положительна и оказывается тем меньше, чем ближе к прямой лежат наши точки. Метод наименьших квадратов утверждает, что для k следует выбирать такое значение, при котором φ имеет минимум

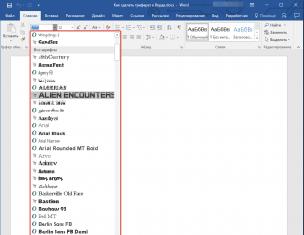

![]()

или

(19)

Вычисление показывает, что среднеквадратичная ошибка определения величины k равна при этом

, (20)

, (20)

где n число измерений.

Рассмотрим теперь несколько более трудный случай, когда точки должны удовлетворить формуле y = a + bx (прямая, не проходящая через начало координат).

Задача состоит в том, чтобы по имеющемуся набору значений x i , y i найти наилучшие значения a и b.

Снова составим квадратичную форму φ , равную сумме квадратов отклонений точек x i , y i от прямой

![]()

и найдем значения a и b , при которых φ имеет минимум

![]() ;

;

![]() .

.

Совместное решение этих уравнений дает

![]() (21)

(21)

Среднеквадратичные ошибки определения a и b равны

(23)

(23)

. (24)

. (24)

При обработке результатов измерения этим методом удобно все данные сводить в таблицу, в которой предварительно подсчитываются все суммы, входящие в формулы (19)(24). Формы этих таблиц приведены в рассматриваемых ниже примерах.

Пример 1. Исследовалось основное уравнение динамики вращательного движения ε = M/J (прямая, проходящая через начало координат). При различных значениях момента M измерялось угловое ускорение ε некоторого тела. Требуется определить момент инерции этого тела. Результаты измерений момента силы и углового ускорения занесены во второй и третий столбцы таблицы 5 .

Таблица 5

| n | M, Н · м | ε, c -1 | M 2 | M · ε | ε - kM | (ε - kM) 2 |

| 1 | 1.44 | 0.52 | 2.0736 | 0.7488 | 0.039432 | 0.001555 |

| 2 | 3.12 | 1.06 | 9.7344 | 3.3072 | 0.018768 | 0.000352 |

| 3 | 4.59 | 1.45 | 21.0681 | 6.6555 | -0.08181 | 0.006693 |

| 4 | 5.90 | 1.92 | 34.81 | 11.328 | -0.049 | 0.002401 |

| 5 | 7.45 | 2.56 | 55.5025 | 19.072 | 0.073725 | 0.005435 |

| ∑ | | | 123.1886 | 41.1115 | | 0.016436 |

По формуле (19) определяем:

![]() .

.

Для определения среднеквадратичной ошибки воспользуемся формулой (20)

0.005775 кг -1 · м -2 .

По формуле (18) имеем

S J = (2.996 · 0.005775)/0.3337 = 0.05185 кг · м 2 .

Задавшись надежностью P = 0.95 , по таблице коэффициентов Стьюдента для n = 5, находим t = 2.78 и определяем абсолютную ошибку ΔJ = 2.78 · 0.05185 = 0.1441 ≈ 0.2 кг · м 2 .

Результаты запишем в виде:

J = (3.0 ± 0.2) кг · м 2 ;

Пример 2. Вычислим температурный коэффициент сопротивления металла по методу наименьших квадратов. Сопротивление зависит от температуры по линейному закону

R t = R 0 (1 + α t°) = R 0 + R 0 α t°.

Свободный член определяет сопротивление R 0 при температуре 0° C , а угловой коэффициент произведение температурного коэффициента α на сопротивление R 0 .

Результаты измерений и расчетов приведены в таблице (см. таблицу 6 ).

Таблица 6

| n | t°, c | r, Ом | t-¯ t | (t-¯ t) 2 | (t-¯ t)r | r - bt - a | (r - bt - a) 2 ,10 -6 |

| 1 | 23 | 1.242 | -62.8333 | 3948.028 | -78.039 | 0.007673 | 58.8722 |

| 2 | 59 | 1.326 | -26.8333 | 720.0278 | -35.581 | -0.00353 | 12.4959 |

| 3 | 84 | 1.386 | -1.83333 | 3.361111 | -2.541 | -0.00965 | 93.1506 |

| 4 | 96 | 1.417 | 10.16667 | 103.3611 | 14.40617 | -0.01039 | 107.898 |

| 5 | 120 | 1.512 | 34.16667 | 1167.361 | 51.66 | 0.021141 | 446.932 |

| 6 | 133 | 1.520 | 47.16667 | 2224.694 | 71.69333 | -0.00524 | 27.4556 |

| ∑ | 515 | 8.403 | | 8166.833 | 21.5985 | | 746.804 |

| ∑/n | 85.83333 | 1.4005 | | | | | |

По формулам (21), (22) определяем

R 0 = ¯ R- α R 0 ¯ t = 1.4005 - 0.002645 · 85.83333 = 1.1735 Ом .

Найдем ошибку в определении α. Так как , то по формуле (18) имеем:

.

.

Пользуясь формулами (23), (24) имеем

;

;

0.014126 Ом .

Задавшись надежностью P = 0.95, по таблице коэффициентов Стьюдента для n = 6, находим t = 2.57 и определяем абсолютную ошибку Δα = 2.57 · 0.000132 = 0.000338 град -1 .

α = (23 ± 4) · 10 -4 град

-1 при P = 0.95.

Пример 3. Требуется определить радиус кривизны линзы по кольцам Ньютона. Измерялись радиусы колец Ньютона r m и определялись номера этих колец m. Радиусы колец Ньютона связаны с радиусом кривизны линзы R и номером кольца уравнением

r 2 m = mλR - 2d 0 R,

где d 0 толщина зазора между линзой и плоскопараллельной пластинкой (или деформация линзы),

λ длина волны падающего света.

λ = (600 ± 6) нм;

r 2 m = y;

m = x;

λR = b;

-2d 0 R = a,

тогда уравнение примет вид y = a + bx .

.Результаты измерений и вычислений занесены в таблицу 7 .

Таблица 7

| n | x = m | y = r 2 , 10 -2 мм 2 | m -¯ m | (m -¯ m) 2 | (m -¯ m)y | y - bx - a, 10 -4 | (y - bx - a) 2 , 10 -6 |

| 1 | 1 | 6.101 | -2.5 | 6.25 | -0.152525 | 12.01 | 1.44229 |

| 2 | 2 | 11.834 | -1.5 | 2.25 | -0.17751 | -9.6 | 0.930766 |

| 3 | 3 | 17.808 | -0.5 | 0.25 | -0.08904 | -7.2 | 0.519086 |

| 4 | 4 | 23.814 | 0.5 | 0.25 | 0.11907 | -1.6 | 0.0243955 |

| 5 | 5 | 29.812 | 1.5 | 2.25 | 0.44718 | 3.28 | 0.107646 |

| 6 | 6 | 35.760 | 2.5 | 6.25 | 0.894 | 3.12 | 0.0975819 |

| ∑ | 21 | 125.129 | | 17.5 | 1.041175 | | 3.12176 |

| ∑/n | 3.5 | 20.8548333 | | | | | |

Суть метода заключается в том, что критерием качества рассматриваемого решения является сумма квадратов ошибок, которую стремятся свести к минимуму. Для применения этого требуется провести как можно большее число измерений неизвестной случайной величины (чем больше — тем выше точность решения) и некоторое множество предполагаемых решений, из которых требуется выбрать наилучшее. Если множество решений параметризировано, то нужно найти оптимальное значение параметров.

Почему сводятся к минимуму квадраты ошибок, а не сами ошибки? Дело в том, что в большинстве случаев ошибки бывают в обе стороны: оценка может быть больше измерения или меньше его. Если складывать ошибки с разными знаками, то они будут взаимно компенсироваться, и в итоге сумма даст нам неверное представление о качестве оценки. Часто для того, чтобы итоговая оценка имела ту же размерность, что и измеряемые величины, из суммы квадратов ошибок извлекают квадратный корень.

Фото:

МНК используется в математике, в частности — в теории вероятностей и математической статистике. Наибольшее применение этот метод имеет в задачах фильтрации, когда необходимо отделить полезный сигнал от наложенного на него шума.

Его применяют и в математическом анализе для приближённого представления заданной функции более простыми функциями. Ещё одна из областей применения МНК — решение систем уравнений с количеством неизвестных меньшим, чем число уравнений.

Я придумал ещё несколько весьма неожиданных областей применения МНК, о которых хотел бы рассказать в этой статье.

МНК и опечатки

Бичом автоматических переводчиков и поисковых систем являются опечатки и орфографические ошибки. Действительно, если слово отличается всего на 1 букву, программа расценивает его уже как другое слово и переводит/ищет его неправильно или не переводит/не находит его вообще.

У меня возникла похожая проблема: имелось две базы данных с адресами московских домов, и надо было их объединить в одну. Но адреса были записаны в разном стиле. В одной базе был стандарт КЛАДР (всероссийский классификатор адресов), например: «БАБУШКИНА ЛЕТЧИКА УЛ., Д10К3». А в другой базе был почтовый стиль, например: «Ул. Летчика Бабушкина, дом 10 корп.3». Вроде бы ошибок нет в обоих случаях, а автоматизировать процесс невероятно сложно (в каждой базе по 40 тысяч записей!). Хотя и опечаток там тоже хватало… Как дать компьютеру понять, что 2 вышеприведённых адреса принадлежат одному и тому же дому? Тут-то мне и пригодился МНК.

Что я сделал? Найдя очередную букву в первом адресе, я искал ту же букву во втором адресе. Если они обе находились на одном и том же месте, то я полагал ошибку для этой буквы равной 0. Если они располагались на соседних позициях, то ошибка была равна 1. Если имелся сдвиг на 2 позиции, ошибка равнялась 2 и т. д. Если такой буквы вообще не имелось в другом адресе, то ошибка полагалась равной n+1, где n — число букв в 1-м адресе. Таким образом я вычислял сумму квадратов ошибок и соединял те записи, в которых эта сумма была минимальной.

Разумеется, номера домов и корпусов обрабатывались отдельно. Не знаю, изобрёл ли я очередной «велосипед», или это впрямь было , но задача была решена быстро и качественно. Интересно, применяется ли этот метод в поисковых системах? Возможно, применяется, поскольку каждый уважающий себя поисковик при встрече незнакомого слова предлагает замену из знакомых слов («возможно, вы имели в виду…»). Впрочем, они могут делать этот анализ как-то по-другому.

МНК и поиск по картинкам, лицам и картам

Этот метод можно применить и в поиске по картинкам, чертежам, картам и даже по лицам людей.

Фото:

Сейчас все поисковики, вместо поиска по картинкам, по сути, используют поиск по подписям к картинкам. Это, несомненно, полезный и удобный сервис, но я предлагаю дополнить его настоящим поиском по картинкам.

Вводится картинка-образец и для всех изображений составляется рейтинг по сумме квадратов отклонений характерных точек. Определение этих самых характерных точек есть сама по себе нетривиальная задача. Однако она вполне решаема: например, для лиц это уголки глаз, губ, кончик носа, ноздри, края и центры бровей, зрачки и т. д.

Сопоставив эти параметры, можно найти лицо, наиболее похожее на образец. Я уже видел сайты, где такой сервис работает, и вы можете найти знаменитость, наиболее похожую на предложенную вами фотографию, и даже составить анимацию, превращающую вас в знаменитость и обратно. Наверняка этот же метод работает в базах МВД, содержащих фотороботы преступников.

Фото: pixabay.com

Да и по отпечаткам пальцев можно тем же методом делать поиск. Поиск по картам ориентируется на естественные неровности географических объектов — изгибы рек, горных хребтов, очертания берегов, лесов и полей.

Вот такой замечательный и универсальный метод МНК. Я уверен, что вы, дорогие читатели, сможете и сами найти множество необычных и неожиданных областей применения этого метода.

Метод наименьших квадратов используется для оценки параметров уравнение регрессии.Одним из методов изучения стохастических связей между признаками является регрессионный анализ .

Регрессионный анализ представляет собой вывод уравнения регрессии, с помощью которого находится средняя величина случайной переменной (признака-результата), если величина другой (или других) переменных (признаков-факторов) известна. Он включает следующие этапы:

- выбор формы связи (вида аналитического уравнения регрессии);

- оценку параметров уравнения;

- оценку качества аналитического уравнения регрессии.

В случае линейной парной связи уравнение регрессии примет вид: y i =a+b·x i +u i . Параметры данного уравнения а и b оцениваются по данным статистического наблюдения x и y . Результатом такой оценки является уравнение: , где , - оценки параметров a и b , - значение результативного признака (переменной), полученное по уравнению регрессии (расчетное значение).

Наиболее часто для оценки параметров используют метод наименьших квадратов (МНК).

Метод наименьших квадратов дает наилучшие (состоятельные, эффективные и несмещенные) оценки параметров уравнения регрессии. Но только в том случае, если выполняются определенные предпосылки относительно случайного члена (u) и независимой переменной (x) (см. предпосылки МНК).

Задача оценивания параметров линейного парного уравнения методом наименьших квадратов

состоит в следующем: получить такие оценки параметров , , при которых сумма квадратов отклонений фактических значений результативного признака - y i от расчетных значений – минимальна.

Формально критерий МНК

можно записать так:  .

.

Классификация методов наименьших квадратов

- Метод наименьших квадратов.

- Метод максимального правдоподобия (для нормальной классической линейной модели регрессии постулируется нормальность регрессионных остатков).

- Обобщенный метод наименьших квадратов ОМНК применяется в случае автокорреляции ошибок и в случае гетероскедастичности.

- Метод взвешенных наименьших квадратов (частный случай ОМНК с гетероскедастичными остатками).

Проиллюстрируем суть классического метода наименьших квадратов графически

. Для этого построим точечный график по данным наблюдений (x i , y i , i=1;n) в прямоугольной системе координат (такой точечный график называют корреляционным полем). Попытаемся подобрать прямую линию, которая ближе всего расположена к точкам корреляционного поля. Согласно методу наименьших квадратов линия выбирается так, чтобы сумма квадратов расстояний по вертикали между точками корреляционного поля и этой линией была бы минимальной.

Математическая запись данной задачи:  .

.

Значения y i и x i =1...n нам известны, это данные наблюдений. В функции S они представляют собой константы. Переменными в данной функции являются искомые оценки параметров - , . Чтобы найти минимум функции 2-ух переменных необходимо вычислить частные производные данной функции по каждому из параметров и приравнять их нулю, т.е.  .

.

В результате получим систему из 2-ух нормальных линейных уравнений:

Решая данную систему, найдем искомые оценки параметров:

Правильность расчета параметров уравнения регрессии может быть проверена сравнением сумм (возможно некоторое расхождение из-за округления расчетов).

Для расчета оценок параметров , можно построить таблицу 1.

Знак коэффициента регрессии b указывает направление связи (если b >0, связь прямая, если b <0, то связь обратная). Величина b показывает на сколько единиц изменится в среднем признак-результат -y при изменении признака-фактора - х на 1 единицу своего измерения.

Формально значение параметра а – среднее значение y при х равном нулю. Если признак-фактор не имеет и не может иметь нулевого значения, то вышеуказанная трактовка параметра а не имеет смысла.

Оценка тесноты связи между признаками

осуществляется с помощью коэффициента линейной парной корреляции - r x,y .

Он может быть рассчитан по формуле:  . Кроме того, коэффициент линейной парной корреляции может быть определен через коэффициент регрессии b:

. Кроме того, коэффициент линейной парной корреляции может быть определен через коэффициент регрессии b:  .

.

Область допустимых значений линейного коэффициента парной корреляции от –1 до +1. Знак коэффициента корреляции указывает направление связи. Если r x, y >0, то связь прямая; если r x, y <0, то связь обратная.

Если данный коэффициент по модулю близок к единице, то связь между признаками может быть интерпретирована как довольно тесная линейная. Если его модуль равен единице ê r x , y ê =1, то связь между признаками функциональная линейная.

Если признаки х и y линейно независимы, то r x,y близок к 0.

Для расчета r x,y можно использовать также таблицу 1.

Таблица 1

| N наблюдения | x i | y i | x i ∙y i | ||

| 1 | x 1 | y 1 | x 1 ·y 1 | ||

| 2 | x 2 | y 2 | x 2 ·y 2 | ||

| ... | |||||

| n | x n | y n | x n ·y n | ||

| Сумма по столбцу | ∑x | ∑y | ∑x·y | ||

| Среднее значение |

|

|

,

,

где d 2 – объясненная уравнением регрессии дисперсия y ;

e 2 - остаточная (необъясненная уравнением регрессии) дисперсия y ;

s 2 y - общая (полная) дисперсия y .

Коэффициент детерминации характеризует долю вариации (дисперсии) результативного признака y , объясняемую регрессией (а, следовательно, и фактором х), в общей вариации (дисперсии) y . Коэффициент детерминации R 2 yx принимает значения от 0 до 1. Соответственно величина 1-R 2 yx характеризует долю дисперсии y , вызванную влиянием прочих неучтенных в модели факторов и ошибками спецификации.

При парной линейной регрессии R 2 yx =r 2 yx .

Метод наименьших квадратов (МНК, англ. Ordinary Least Squares, OLS ) -- математический метод, применяемый для решения различных задач, основанный на минимизации суммы квадратов отклонений некоторых функций от искомых переменных. Он может использоваться для «решения» переопределенных систем уравнений (когда количество уравнений превышает количество неизвестных), для поиска решения в случае обычных (не переопределенных) нелинейных систем уравнений, для аппроксимации точечных значений некоторой функцией. МНК является одним из базовых методов регрессионного анализа для оценки неизвестных параметров регрессионных моделей по выборочным данным.

Сущность метода наименьших квадратов

Пусть -- набор неизвестных переменных (параметров), -- совокупность функций от этого набора переменных. Задача заключается в подборе таких значений x, чтобы значения этих функций были максимально близки к некоторым значениям. По существу речь идет о «решении» переопределенной системы уравнений в указанном смысле максимальной близости левой и правой частей системы. Сущность МНК заключается в выборе в качестве «меры близости» суммы квадратов отклонений левых и правых частей -- . Таким образом, сущность МНК может быть выражена следующим образом:

В случае, если система уравнений имеет решение, то минимум суммы квадратов будет равен нулю и могут быть найдены точные решения системы уравнений аналитически или, например, различными численными методами оптимизации. Если система переопределена, то есть, говоря нестрого, количество независимых уравнений больше количества искомых переменных, то система не имеет точного решения и метод наименьших квадратов позволяет найти некоторый «оптимальный» вектор в смысле максимальной близости векторов и или максимальной близости вектора отклонений к нулю (близость понимается в смысле евклидова расстояния).

Пример -- система линейных уравнений

В частности, метод наименьших квадратов может использоваться для «решения» системы линейных уравнений

где матрица не квадратная, а прямоугольная размера (точнее ранг матрицы A больше количества искомых переменных).

Такая система уравнений, в общем случае не имеет решения. Поэтому эту систему можно «решить» только в смысле выбора такого вектора, чтобы минимизировать «расстояние» между векторами и. Для этого можно применить критерий минимизации суммы квадратов разностей левой и правой частей уравнений системы, то есть. Нетрудно показать, что решение этой задачи минимизации приводит к решению следующей системы уравнений

Используя оператор псевдоинверсии, решение можно переписать так:

где -- псевдообратная матрица для.

Данную задачу также можно «решить» используя так называемый взвешенный МНК (см. ниже), когда разные уравнения системы получают разный вес из теоретических соображений.

Строгое обоснование и установление границ содержательной применимости метода даны А. А. Марковым и А. Н. Колмогоровым.

МНК в регрессионном анализе (аппроксимация данных)[править | править вики-текст] Пусть имеется значений некоторой переменной (это могут быть результаты наблюдений, экспериментов и т. д.) и соответствующих переменных. Задача заключается в том, чтобы взаимосвязь между и аппроксимировать некоторой функцией, известной с точностью до некоторых неизвестных параметров, то есть фактически найти наилучшие значения параметров, максимально приближающие значения к фактическим значениям. Фактически это сводится к случаю «решения» переопределенной системы уравнений относительно:

В регрессионном анализе и в частности в эконометрике используются вероятностные модели зависимости между переменными

где -- так называемые случайные ошибки модели.

Соответственно, отклонения наблюдаемых значений от модельных предполагается уже в самой модели. Сущность МНК (обычного, классического) заключается в том, чтобы найти такие параметры, при которых сумма квадратов отклонений (ошибок, для регрессионных моделей их часто называют остатками регрессии) будет минимальной:

где -- англ. Residual Sum of Squares определяется как:

В общем случае решение этой задачи может осуществляться численными методами оптимизации (минимизации). В этом случае говорят о нелинейном МНК (NLS или NLLS -- англ. Non-Linear Least Squares). Во многих случаях можно получить аналитическое решение. Для решения задачи минимизации необходимо найти стационарные точки функции, продифференцировав её по неизвестным параметрам, приравняв производные к нулю и решив полученную систему уравнений:

МНК в случае линейной регрессии[править | править вики-текст]

Пусть регрессионная зависимость является линейной:

Пусть y -- вектор-столбец наблюдений объясняемой переменной, а -- это -матрица наблюдений факторов (строки матрицы -- векторы значений факторов в данном наблюдении, по столбцам -- вектор значений данного фактора во всех наблюдениях). Матричное представление линейной модели имеет вид:

Тогда вектор оценок объясняемой переменной и вектор остатков регрессии будут равны

соответственно сумма квадратов остатков регрессии будет равна

Дифференцируя эту функцию по вектору параметров и приравняв производные к нулю, получим систему уравнений (в матричной форме):

В расшифрованной матричной форме эта система уравнений выглядит следующим образом:

где все суммы берутся по всем допустимым значениям.

Если в модель включена константа (как обычно), то при всех, поэтому в левом верхнем углу матрицы системы уравнений находится количество наблюдений, а в остальных элементах первой строки и первого столбца -- просто суммы значений переменных: и первый элемент правой части системы -- .

Решение этой системы уравнений и дает общую формулу МНК-оценок для линейной модели:

Для аналитических целей оказывается полезным последнее представление этой формулы (в системе уравнений при делении на n, вместо сумм фигурируют средние арифметические). Если в регрессионной модели данные центрированы, то в этом представлении первая матрица имеет смысл выборочной ковариационной матрицы факторов, а вторая -- вектор ковариаций факторов с зависимой переменной. Если кроме того данные ещё инормированы на СКО (то есть в конечном итоге стандартизированы), то первая матрица имеет смысл выборочной корреляционной матрицы факторов, второй вектор -- вектора выборочных корреляций факторов с зависимой переменной.

Немаловажное свойство МНК-оценок для моделей с константой -- линия построенной регрессии проходит через центр тяжести выборочных данных, то есть выполняется равенство:

В частности, в крайнем случае, когда единственным регрессором является константа, получаем, что МНК-оценка единственного параметра (собственно константы) равна среднему значению объясняемой переменной. То есть среднее арифметическое, известное своими хорошими свойствами из законов больших чисел, также является МНК-оценкой -- удовлетворяет критерию минимума суммы квадратов отклонений от неё.

Простейшие частные случаи[править | править вики-текст]

В случае парной линейной регрессии, когда оценивается линейная зависимость одной переменной от другой, формулы расчета упрощаются (можно обойтись без матричной алгебры). Система уравнений имеет вид:

Отсюда несложно найти оценки коэффициентов:

Несмотря на то что в общем случае модели с константой предпочтительней, в некоторых случаях из теоретических соображений известно, что константа должна быть равна нулю. Например, в физике зависимость между напряжением и силой тока имеет вид; замеряя напряжение и силу тока, необходимо оценить сопротивление. В таком случае речь идёт о модели. В этом случае вместо системы уравнений имеем единственное уравнение

Следовательно, формула оценки единственного коэффициента имеет вид

Статистические свойства МНК-оценок[править | править вики-текст]

В первую очередь, отметим, что для линейных моделей МНК-оценки являются линейными оценками, как это следует из вышеприведённой формулы. Длянесмещенности МНК-оценок необходимо и достаточно выполнения важнейшего условия регрессионного анализа: условное по факторам математическое ожидание случайной ошибки должно быть равно нулю. Данное условие, в частности, выполнено, если математическое ожидание случайных ошибок равно нулю, и факторы и случайные ошибки -- независимые случайные величины.

Первое условие можно считать выполненным всегда для моделей с константой, так как константа берёт на себя ненулевое математическое ожидание ошибок (поэтому модели с константой в общем случае предпочтительнее). наименьший квадрат регрессионный ковариационный

Второе условие -- условие экзогенности факторов -- принципиальное. Если это свойство не выполнено, то можно считать, что практически любые оценки будут крайне неудовлетворительными: они не будут даже состоятельными (то есть даже очень большой объём данных не позволяет получить качественные оценки в этом случае). В классическом случае делается более сильное предположение о детерминированности факторов, в отличие от случайной ошибки, что автоматически означает выполнение условия экзогенности. В общем случае для состоятельности оценок достаточно выполнения условия экзогенности вместе со сходимостью матрицы к некоторой невырожденной матрице при увеличении объёма выборки до бесконечности.

Для того, чтобы кроме состоятельности и несмещенности, оценки (обычного) МНК были ещё и эффективными (наилучшими в классе линейных несмещенных оценок) необходимо выполнение дополнительных свойств случайной ошибки:

Постоянная (одинаковая) дисперсия случайных ошибок во всех наблюдениях (отсутствие гетероскедастичности):

Отсутствие корреляции (автокорреляции) случайных ошибок в разных наблюдениях между собой

Данные предположения можно сформулировать для ковариационной матрицы вектора случайных ошибок

Линейная модель, удовлетворяющая таким условиям, называется классической. МНК-оценки для классической линейной регрессии являютсянесмещёнными, состоятельными и наиболее эффективными оценками в классе всех линейных несмещённых оценок (в англоязычной литературе иногда употребляют аббревиатуру BLUE (Best Linear Unbiased Estimator) -- наилучшая линейная несмещённая оценка; в отечественной литературе чаще приводится теорема Гаусса -- Маркова). Как нетрудно показать, ковариационная матрица вектора оценок коэффициентов будет равна:

Эффективность означает, что эта ковариационная матрица является «минимальной» (любая линейная комбинация коэффициентов, и в частности сами коэффициенты, имеют минимальную дисперсию), то есть в классе линейных несмещенных оценок оценки МНК-наилучшие. Диагональные элементы этой матрицы -- дисперсии оценок коэффициентов -- важные параметры качества полученных оценок. Однако рассчитать ковариационную матрицу невозможно, поскольку дисперсия случайных ошибок неизвестна. Можно доказать, что несмещённой и состоятельной (для классической линейной модели) оценкой дисперсии случайных ошибок является величина:

Подставив данное значение в формулу для ковариационной матрицы и получим оценку ковариационной матрицы. Полученные оценки также являютсянесмещёнными и состоятельными. Важно также то, что оценка дисперсии ошибок (а значит и дисперсий коэффициентов) и оценки параметров модели являются независимыми случайными величинами, что позволяет получить тестовые статистики для проверки гипотез о коэффициентах модели.

Необходимо отметить, что если классические предположения не выполнены, МНК-оценки параметров не являются наиболее эффективными оценками (оставаясь несмещёнными и состоятельными). Однако, ещё более ухудшается оценка ковариационной матрицы -- она становится смещённой инесостоятельной. Это означает, что статистические выводы о качестве построенной модели в таком случае могут быть крайне недостоверными. Одним из вариантов решения последней проблемы является применение специальных оценок ковариационной матрицы, которые являются состоятельными при нарушениях классических предположений (стандартные ошибки в форме Уайта и стандартные ошибки в форме Ньюи-Уеста). Другой подход заключается в применении так называемого обобщённого МНК.

Обобщенный МНК[править | править вики-текст]

Основная статья: Обобщенный метод наименьших квадратов

Метод наименьших квадратов допускает широкое обобщение. Вместо минимизации суммы квадратов остатков можно минимизировать некоторую положительно определенную квадратичную форму от вектора остатков, где -- некоторая симметрическая положительно определенная весовая матрица. Обычный МНК является частным случаем данного подхода, когда весовая матрица пропорциональна единичной матрице. Как известно из теории симметрических матриц (или операторов) для таких матриц существует разложение. Следовательно, указанный функционал можно представить следующим образом

то есть этот функционал можно представить как сумму квадратов некоторых преобразованных «остатков». Таким образом, можно выделить класс методов наименьших квадратов -- LS-методы (Least Squares).

Доказано (теорема Айткена), что для обобщенной линейной регрессионной модели (в которой на ковариационную матрицу случайных ошибок не налагается никаких ограничений) наиболее эффективными (в классе линейных несмещенных оценок) являются оценки т. н. обобщенного МНК (ОМНК, GLS -- Generalized Least Squares) -- LS-метода с весовой матрицей, равной обратной ковариационной матрице случайных ошибок: .

Можно показать, что формула ОМНК-оценок параметров линейной модели имеет вид

Ковариационная матрица этих оценок соответственно будет равна

Фактически сущность ОМНК заключается в определенном (линейном) преобразовании (P) исходных данных и применении обычного МНК к преобразованным данным. Цель этого преобразования -- для преобразованных данных случайные ошибки уже удовлетворяют классическим предположениям.

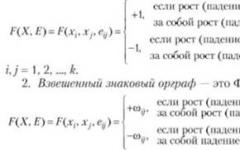

Взвешенный МНК[править | править вики-текст]

В случае диагональной весовой матрицы (а значит и ковариационной матрицы случайных ошибок) имеем так называемый взвешенный МНК (WLS -- Weighted Least Squares). В данном случае минимизируется взвешенная сумма квадратов остатков модели, то есть каждое наблюдение получает «вес», обратно пропорциональный дисперсии случайной ошибки в данном наблюдении:

Фактически данные преобразуются взвешиванием наблюдений (делением на величину, пропорциональную предполагаемому стандартному отклонению случайных ошибок), а к взвешенным данным применяется обычный МНК.

Аппроксимация опытных данных – это метод, основанный на замене экспериментально полученных данных аналитической функцией наиболее близко проходящей или совпадающей в узловых точках с исходными значениями (данными полученными в ходе опыта или эксперимента). В настоящее время существует два способа определения аналитической функции:

С помощью построения интерполяционного многочлена n-степени, который проходит непосредственно через все точки заданного массива данных. В данном случае аппроксимирующая функция представляется в виде: интерполяционного многочлена в форме Лагранжа или интерполяционного многочлена в форме Ньютона.

С помощью построения аппроксимирующего многочлена n-степени, который проходит в ближайшей близости от точек из заданного массива данных. Таким образом, аппроксимирующая функция сглаживает все случайные помехи (или погрешности), которые могут возникать при выполнении эксперимента: измеряемые значения в ходе опыта зависят от случайных факторов, которые колеблются по своим собственным случайным законам (погрешности измерений или приборов, неточность или ошибки опыта). В данном случае аппроксимирующая функция определяется по методу наименьших квадратов.

Метод наименьших квадратов (в англоязычной литературе Ordinary Least Squares, OLS) - математический метод, основанный на определении аппроксимирующей функции, которая строится в ближайшей близости от точек из заданного массива экспериментальных данных. Близость исходной и аппроксимирующей функции F(x) определяется числовой мерой, а именно: сумма квадратов отклонений экспериментальных данных от аппроксимирующей кривой F(x) должна быть наименьшей.

Аппроксимирующая кривая, построенная по методу наименьших квадратов

Метод наименьших квадратов используется:

Для решения переопределенных систем уравнений, когда количество уравнений превышает количество неизвестных;

Для поиска решения в случае обычных (не переопределенных) нелинейных систем уравнений;

Для аппроксимации точечных значений некоторой аппроксимирующей функцией.

Аппроксимирующая функция по методу наименьших квадратов определяется из условия минимума суммы квадратов отклонений расчетной аппроксимирующей функции от заданного массива экспериментальных данных. Данный критерий метода наименьших квадратов записывается в виде следующего выражения:

Значения расчетной аппроксимирующей функции в узловых точках ,

Заданный массив экспериментальных данных в узловых точках .

Квадратичный критерий обладает рядом "хороших" свойств, таких, как дифференцируемость, обеспечение единственного решения задачи аппроксимации при полиномиальных аппроксимирующих функциях.

В зависимости от условий задачи аппроксимирующая функция представляет собой многочлен степени m

Степень аппроксимирующей функции не зависит от числа узловых точек, но ее размерность должна быть всегда меньше размерности (количества точек) заданного массива экспериментальных данных.

![]()

∙ В случае если степень аппроксимирующей функции m=1, то мы аппроксимируем табличную функцию прямой линией (линейная регрессия).

∙ В случае если степень аппроксимирующей функции m=2, то мы аппроксимируем табличную функцию квадратичной параболой (квадратичная аппроксимация).

∙ В случае если степень аппроксимирующей функции m=3, то мы аппроксимируем табличную функцию кубической параболой (кубическая аппроксимация).

В общем случае, когда требуется построить аппроксимирующий многочлен степени m для заданных табличных значений, условие минимума суммы квадратов отклонений по всем узловым точкам переписывается в следующем виде:

![]() - неизвестные коэффициенты аппроксимирующего многочлена степени m;

- неизвестные коэффициенты аппроксимирующего многочлена степени m;

Количество заданных табличных значений.

Необходимым условием существования минимума функции является равенству нулю ее частных производных по неизвестным переменным ![]() . В результате получим следующую систему уравнений:

. В результате получим следующую систему уравнений:

Преобразуем полученную линейную систему уравнений: раскроем скобки и перенесем свободные слагаемые в правую часть выражения. В результате полученная система линейных алгебраических выражений будет записываться в следующем виде:

Данная система линейных алгебраических выражений может быть переписана в матричном виде:

В результате была получена система линейных уравнений размерностью m+1, которая состоит из m+1 неизвестных. Данная система может быть решена с помощью любого метода решения линейных алгебраических уравнений (например, методом Гаусса). В результате решения будут найдены неизвестные параметры аппроксимирующей функции, обеспечивающие минимальную сумму квадратов отклонений аппроксимирующей функции от исходных данных, т.е. наилучшее возможное квадратичное приближение. Следует помнить, что при изменении даже одного значения исходных данных все коэффициенты изменят свои значения, так как они полностью определяются исходными данными.

Аппроксимация исходных данных линейной зависимостью

(линейная регрессия)

В качестве примера, рассмотрим методику определения аппроксимирующей функции, которая задана в виде линейной зависимости. В соответствии с методом наименьших квадратов условие минимума суммы квадратов отклонений записывается в следующем виде:

Координаты узловых точек таблицы;

Неизвестные коэффициенты аппроксимирующей функции, которая задана в виде линейной зависимости.

Необходимым условием существования минимума функции является равенству нулю ее частных производных по неизвестным переменным. В результате получаем следующую систему уравнений:

Преобразуем полученную линейную систему уравнений.

Решаем полученную систему линейных уравнений. Коэффициенты аппроксимирующей функции в аналитическом виде определяются следующим образом (метод Крамера):

Данные коэффициенты обеспечивают построение линейной аппроксимирующей функции в соответствии с критерием минимизации суммы квадратов аппроксимирующей функции от заданных табличных значений (экспериментальные данные).

Алгоритм реализации метода наименьших квадратов

1. Начальные данные:

Задан массив экспериментальных данных с количеством измерений N

Задана степень аппроксимирующего многочлена (m)

2. Алгоритм вычисления:

2.1. Определяются коэффициенты для построения системы уравнений размерностью

Коэффициенты системы уравнений (левая часть уравнения)

![]()

![]() - индекс номера столбца квадратной матрицы системы уравнений

- индекс номера столбца квадратной матрицы системы уравнений

Свободные члены системы линейных уравнений (правая часть уравнения)

![]() - индекс номера строки квадратной матрицы системы уравнений

- индекс номера строки квадратной матрицы системы уравнений

2.2. Формирование системы линейных уравнений размерностью .

2.3. Решение системы линейных уравнений с целью определения неизвестных коэффициентов аппроксимирующего многочлена степени m.

2.4.Определение суммы квадратов отклонений аппроксимирующего многочлена от исходных значений по всем узловым точкам

Найденное значение суммы квадратов отклонений является минимально-возможным.

Аппроксимация с помощью других функций

Следует отметить, что при аппроксимации исходных данных в соответствии с методом наименьших квадратов в качестве аппроксимирующей функции иногда используют логарифмическую функцию, экспоненциальную функцию и степенную функцию.

Логарифмическая аппроксимация

Рассмотрим случай, когда аппроксимирующая функция задана логарифмической функцией вида: