Задание на курсовую работу

Дано: пять начальных моментов

а1 =

1, а2 = 2, а3 = 2, а4 = 1, а5 = 1 (µ

г

= 0, µ

0

=

1).

Найти: пять центральных моментов. Имея в своём распоряжении пять начальных и пять центральных моментов, вычислить значения: а)

математическое ожидание;

б)

дисперсию;

в)

стандартное отклонение;

г)

коэффициент вариации;

д)

коэффициент асимметрии;

е)

коэффициент эксцессии.

По полученным данным качественно описать плотность вероятности данного процесса.

1. Теоретические сведения

Распределения случайных величин и функции распределения

Распределение числовой случайной величины - это функция, которая однозначно определяет вероятность того, что случайная величина принимает заданное значение или принадлежит к некоторому заданному интервалу. Первое - если случайная величина принимает конечное число значений. Тогда распределение задается функцией Р (Х = х),

ставящей каждому возможному значению х

случайной величины X

вероятность того, что X = х.

Второе - если случайная величина принимает бесконечно много значений. Это возможно лишь тогда, когда вероятностное пространство, на котором определена случайная величина, состоит из бесконечного числа элементарных событий. Тогда распределение задается набором вероятностей Р (а

Х Р (а

Х Это соотношение показывает, что как распределение может быть рассчитано по функции распределения, так и, наоборот, функция распределения - по распределению. Используемые в вероятностно-статистических методах принятия решений и других прикладных исследованиях функции распределения бывают либо дискретными, либо непрерывными, либо их комбинациями. Дискретные функции распределения соответствуют дискретным случайным величинам, принимающим конечное число значений или же значения из множества, элементы которого можно перенумеровать натуральными числами (такие множества в математике называют счетными). Их график имеет вид ступенчатой лестницы (рис. 1). Пример 1.

Число X

дефектных изделий в партии принимает значение 0 с вероятностью 0,3, значение 1 с вероятностью 0,4, значение 2 с вероятностью 0,2 и значение 3 с вероятностью 0,1. График функции распределения случайной величины X

изображен на рис. 1.

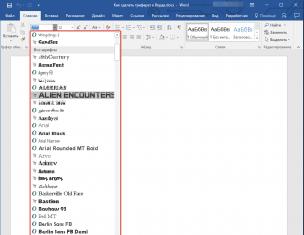

Рис. 1. График функции распределения числа дефектных изделий.

Непрерывные функции распределения не имеют скачков. Они монотонно возрастают при увеличении аргумента - от 0 при х→∞ до 1 при х→+∞. Случайные величины, имеющие непрерывные функции распределения, называют непрерывными. Непрерывные функции распределения, используемые в вероятностно-статистических методах принятия решений, имеют производные. Первая производная f(x)

функции распределения F(x)

называется плотностью вероятности,

По плотности вероятности можно определить функцию распределения: Для любой функции распределения

Перечисленные свойства функций распределения постоянно используются в вероятностно-статистических методах принятия решений. В частности, из последнего равенства вытекает конкретный вид констант в формулах для плотностей вероятностей, рассматриваемых ниже. Пример 2.

Часто используется следующая функция распределения:

(1)

где а

и b -

некоторые числа, а (в точках х

= а

их = b

производная функции F(x)

не существует).

Случайная величина с функцией распределения (1) называется «равномерно распределенной на отрезке ».

Смешанные функции распределения встречаются, в частности, тогда, когда наблюдения в какой-то момент прекращаются. Например, при анализе статистических данных, полученных при использовании планов испытании на надежность, предусматривающих прекращение испытаний по истечении некоторого срока. Или при анализе данных о технических изделиях, потребовавших гарантийного ремонта. Пример 3.

Пусть, например, срок службы электрической лампочки - случайная величина с функцией распределения F(t),

а испытание проводится до выхода лампочки из строя, если это произойдет менее чем за 100 часов от начала испытаний, или до момента t

0

= 100 часов. Пусть G(t) -

функция распределения времени эксплуатации лампочки в исправном состоянии при этом испытании. Тогда

Функция G(t)

имеет скачок в точке t

0

,

поскольку соответствующая случайная величина принимает значение t

0

с вероятностью 1-F(t

0

)>0.

Характеристики случайных величин.

В вероятностно-статистических методах принятия решений используется ряд характеристик случайных величин, выражающихся через функции распределения и плотности вероятностей.

При описании дифференциации доходов, при нахождении доверительных границ для параметров распределений случайных величин и во многих иных случаях используется такое понятие, как «квантиль порядка р»,

где 0 <р <

1 (обозначается х

р

).

Квантиль порядка р

- значение случайной величины, для которого функция распределения принимает значение р

или имеет место «скачок» со значения меньшер

до значения больше р

(рис. 2). Может случиться, что это условие выполняется для всех значений х, принадлежащих этому интервалу (т.е. функция распределения постоянна на этом интервале и равна р).

Тогда каждое такое значение называется «квантилем порядка р».

Для непрерывных функций распределения, как правило, существует единственный квантиль х

р

порядка р

(рис. 2), причем

F(x

p

)=p.

(2)

Рис. 2. Определение квантиля х

р

порядка р.

Пример 4.

Найдем квантиль х

р

порядка р

для функции распределения F(x)

из (1).

При 0 <р <

1 квантиль х

р

находится из уравнения

т.е. х

р

= а

+ p (b - а) = а (1-р) +bр.

При р =

0 любое х

а

является квантилем порядка p

= 0. Квантилем порядка р

= 1 является любое число х

b.

Для дискретных распределений, как правило, не существует х

р

,

удовлетворяющих уравнению (2). Точнее, если распределение случайной величины дается табл. 1, где x

1

< х

2

<… < х

к

,

то равенство (2), рассматриваемое как уравнение относительно х

р

,

имеет решения только для k

значений р,

а именно,

p =p

1

p =p

1

+p

2

,

p = p

1

+p

2

+p

3

,

p = p

1

+p

2

+

р

т

, 3<т<к,

р =р, + р

2

+…

+p

k

Таблица 1. Распределение дискретной случайной величины Значения х случайной величины Xх

1

х

2

…х

k

Вероятности Р (Х =х)P

1

Р

2

…Р

k

Для перечисленных к

значений вероятности р

решение х

р

уравнения (2) неединственно, а именно,

F(x) =р, +р

2

+…

+ Р

т

для всех х

таких, что х

т

< х < х

т+1

.

Т.е. х

р

- любое число из интервала (х

т

; x

m+1

).

Для всех остальных р

из промежутка (0; 1), не входящих в перечень (3), имеет место «скачок» со значения меньше р

до значения больше р.

А именно, если

p

1

+p

2

+…

+ p

т

то x

р

=x

т+1

.

Рассмотренное свойство дискретных распределений создает значительные трудности при табулировании и использовании подобных распределений, поскольку невозможным оказывается точно выдержать типовые численные значения характеристик распределения. В частности, это так для критических значений и уровней значимости непараметрических статистических критериев (см. ниже), поскольку распределения статистик этих критериев дискретны. Большое значение в статистике имеет квантиль порядка p =

½.

Он называется медианой (случайной величины X

или ее функции распределения F(x))

и обозначается Ме(Х).

В геометрии есть понятие «медиана» - прямая, проходящая через вершину треугольника и делящая противоположную его сторону пополам. В математической статистике медиана делит пополам не сторону треугольника, а распределение случайной величины: равенство F(x

0,5

)

= 0,5 означает, что вероятность попасть левее x

0,5

и вероятность попасть правее x

0,5

(или непосредственно x

0,5

) равны между собой и равны ½

,

т.е.

Медиана указывает «центр» распределения. С точки зрения одной из современных концепций - теории устойчивых статистических процедур - медиана является более хорошей характеристикой случайной величины, чем математическое ожидание . При обработке результатов измерений в порядковой шкале (см. главу о теории измерений) медианой можно пользоваться, а математическим ожиданием - нет. Ясный смысл имеет такая характеристика случайной величины, как мода - значение (или значения) случайной величины, соответствующее локальному максимуму плотности вероятности для непрерывной случайной величины или локальному максимуму вероятности для дискретной случайной величины. Если х

0

-

мода случайной величины с плотностью f(x),

то, как известно

из дифференциального исчисления,

У случайной величины может быть много мод. Так, для равномерного распределения (1) каждая точка х

такая, что а < х < b,

является модой. Однако это исключение. Большинство случайных величин, используемых в вероятностно-статистических методах принятия решений и других прикладных исследованиях, имеют одну моду. Случайные величины, плотности, распределения, имеющие одну моду, называются унимодальными.

Математическое ожидание для дискретных случайных величин с конечным числом значений рассмотрено в главе «События и вероятности». Для непрерывной случайной величины X

математическое ожидание М(Х)

удовлетворяет равенству

Пример 5.

Математическое ожидание для равномерно распределенной случайной величины X

равно

Для рассматриваемых в настоящей главе случайных величин верны все те свойства математических ожиданий и дисперсий, которые были рассмотрены ранее для дискретных случайных величин с конечным числом значений. Однако доказательства этих свойств не приводим, поскольку они требуют углубления в математические тонкости, не являющегося необходимым для понимания и квалифицированного применения вероятностно-статистических методов принятия решений. Замечание.

В настоящем учебнике сознательно обходятся математические тонкости, связанные, в частности, с понятиями измеримых множеств и измеримых функций, -алгебры событий и т.п. Желающим освоить эти понятия необходимо обратиться к специальной литературе, в частности, к энциклопедии . Каждая из трех характеристик - математическое ожидание, медиана, мода - описывает «центр» распределения вероятностей. Понятие «центр» можно определять разными способами - отсюда три разные характеристики. Однако для важного класса распределений - симметричных унимодальных - все три характеристики совпадают. Плотность распределения f(x)

- плотность симметричного распределения, если найдется число х

0

такое, что

(3)

Равенство (3) означает, что график функции у =f(х)

симметричен относительно вертикальной прямой, проходящей через центр симметрии х = х

0

.

Из (3) следует, что функция симметричного распределения удовлетворяет соотношению

(4)

Для симметричного распределения с одной модой математическое ожидание, медиана и мода совпадают и равны х

0

.

Наиболее важен случай симметрии относительно 0, т.е. х

п

=

0. Тогда (3) и (4) переходят в равенства

(5)

(6)

соответственно. Приведенные соотношения показывают, что симметричные распределения нет необходимости табулировать при всех х,

достаточно иметь таблицы при х х

0

.

Отметим еще одно свойство симметричных распределений, постоянно используемое в вероятностно-статистических методах принятия решений и других прикладных исследованиях. Для непрерывной функции распределения

Р(а) = Р (-а

<Х

а) = F(a) - F(-a),

где F

- функция распределения случайной величины X.

Если функция распределения F

симметрична относительно 0, т.е. для нее справедлива формула (6), то

Р(а) =2F(a) -

1.

Часто используют другую формулировку рассматриваемого утверждения: если

Если и - квантили порядка α

и 1-α

соответственно (см. (2)) функции распределения, симметричной относительно 0, то из (6) следует, что

От характеристик положения - математического ожидания, медианы, моды - перейдем к характеристикам разброса случайной величины X:

дисперсии , среднему квадратическому отклонению σ

и коэффициенту вариации v

. Определение и свойства дисперсии для дискретных случайных величин рассмотрены в предыдущей главе. Для непрерывных случайных величин

Среднее квадратическое отклонение - это неотрицательное значение квадратного корня из дисперсии:

Коэффициент вариации - это отношение среднего квадратического отклонения к математическому ожиданию:

Коэффициент вариации применяется при М(Х)>0.

Он измеряет разброс в относительных единицах, в то время как среднее квадратическое отклонение - в абсолютных.

Пример 6.

Для равномерно распределенной случайной величины X

найдем дисперсию, среднеквадратическое отклонение и коэффициент вариации. Дисперсия равна:

Замена переменной дает возможность записать:

где с = (b

- а

)/2. Следовательно, среднее квадратическое отклонение равно , а коэффициент вариации таков:

По каждой случайной величине X

определяют еще три величины - центрированную Y,

нормированную V

и приведенную U.

Центрированная случайная величина Y -

это разность между данной случайной величиной X

и ее математическим ожиданием М(Х),

т.е. Y= Х - М(Х).

Математическое ожидание центрированной случайной величины Г равно 0, а дисперсия - дисперсии данной случайной величины: M(Y) =

0, D(Y) = D(X).

Функция распределения F

Y

(x)

центрированной случайной величины Y

связана с функцией распределения F(x)

исходной случайной величины X

соотношением:

F

Y

(x) =F (x + М(Х)).

Для плотностей этих случайных величин справедливо равенство

f

Y

(x) =f (x + М(Х)).

Нормированная случайная величина V

-это отношение данной случайной величины Х

к

ее среднему квадратическому отклонению σ, т.е. . Математическое ожидание и дисперсия нормированной случайной величины V

выражаются через характеристики X

так:

где v

- коэффициент вариации исходной случайной величины X.

Для функции распределения F

v

(x)

и плотности f

v

(x)

нормированной случайной величины V

имеем:

где F(x)

- функция распределения исходной случайной величины X,

a f(x) -

ее плотность вероятности.

Приведенная случайная величина U -

это центрированная и нормированная случайная величина:

Для приведенной случайной величины:

(7)

Нормированные, центрированные и приведенные случайные величины постоянно используются как в теоретических исследованиях, так и в алгоритмах, программных продуктах, нормативно-технической и инструктивно-методической документации. В частности, потому, что позволяют упростить обоснования методов, формулировки теорем и расчетные формулы.

Используются преобразования случайных величин и более общего плана. Так, если Y= аХ+ b,

где а

и b

- некоторые числа, то

(8)

Пример 7.

Если то У -

приведенная случайная величина, и формулы (8) переходят в формулы (7).

С каждой случайной величиной X

можно связать множество случайных величин Y,

заданных формулой У

= аХ+b

при различных а>0

и b.

Это множество называют масштабно-сдвиговым семейством,

порожденным случайной величиной X.

Функции распределения F

Y

(x)

составляют масштабно сдвиговое семейство распределений, порожденное функцией распределения F(x).

Вместо Y= аХ+ b

часто используют запись

(9)

Число с

называют параметром сдвига, а число d

- параметром масштаба. Формула (9) показывает, что Х -

результат измерения некоторой величины - переходит в У - результат измерения той же величины, если начало измерения перенести в точку с,

а затем использовать новую единицу измерения, в d

раз большую старой.

Для масштабно-сдвигового семейства (9) распределение X называют стандартным. В вероятностно-статистических методах принятия решений и других прикладных исследованиях используют стандартное нормальное распределение, стандартное распределение Вейбулла-Гнеденко, стандартное гамма-распределение и др. (см. ниже). Применяют и другие преобразования случайных величин. Например, для положительной случайной величины X

рассматривают Y=

gX,

где lgX

-десятичный логарифм числа X.

Цепочка равенств

100 р бонус за первый заказ

Выберите тип работы Дипломная работа Курсовая работа Реферат Магистерская диссертация Отчёт по практике Статья Доклад Рецензия Контрольная работа Монография Решение задач Бизнес-план Ответы на вопросы Творческая работа Эссе Чертёж Сочинения Перевод Презентации Набор текста Другое Повышение уникальности текста Кандидатская диссертация Лабораторная работа Помощь on-line

Узнать цену

Случайная функция – функция, которая в результате опыта может принять тот или иной неизвестный заранее конкретный вид. Обычно аргументом случайной функции (с.ф.) является время, тогда с.ф. называют случайным процессом (с.п.).

С.ф. непрерывно изменяющегося аргумента t называется такая с.в., распределение которой зависит не только от аргумента t=t1 , но и от того, какие частные значения принимала эта величина при других значениях данного аргумента t=t 2. Эти с.в. корреляционно связаны между собой и тем больше, чем ближе одни к другим значения аргументов. В пределе при интервале между двумя значениями аргумента, стремящемся к нулю, коэффициент корреляции равен единице:

т.е. t 1 и t1+Dt1 при Dt1 ®0 связаны линейной зависимостью.

С.ф. принимает в результате одного опыта бесчисленное (в общем случае несчетное) множество значений – по одному для каждого значения аргумента или для каждой совокупности значений аргументов. Эта функция имеет одно вполне определенное значение для каждого момента времени. Результат измерения непрерывно изменяющейся величины является такой с.в., которая в каждом данном опыте представляет собой определенную функцию времени.

С.ф. можно также рассматривать как бесконечную совокупность с.в., зависящую от одного или нескольких непрерывно изменяющихся параметров t . Каждому данному значению параметра t соответствует одна с.в Xt. Вместе все с.в. X t определяют с.ф. X(t). Эти с.в. корреляционно связаны между собой и тем сильнее, чем ближе друг к другу.

Элементарная с.ф. – это произведение обычной с.в. Х на некоторую неслучайную функцию j(t): X(t)=X×j(t) , т.е. такая с.ф., у которой случайным является не вид, а только ее масштаб.

С.ф. ![]() - имеет м.о. равное нулю. p

– плотность распределения с.в. Х

(значения с.ф. X(t)

), взятой при произвольном значении t

1 аргумента t

.

- имеет м.о. равное нулю. p

– плотность распределения с.в. Х

(значения с.ф. X(t)

), взятой при произвольном значении t

1 аргумента t

.

Реализация с.ф. X(t) – описывается уравнением x=f1(t) при t=t1 и уравнением x=f2(t) при t=t2 .

Вообще функции x=f1(t) и x=f2(t) – различные функции. Но эти функции тождественны и линейны тем более, чем более (t1 ®t2 ) t 1 ближе к t 2.

Одномерная плотность вероятности с.ф. p(x,t) – зависит от х и от параметра t . Двумерная плотность вероятности p(x1,x2;t1,t2) – совместный закон распределения значений X(t1) и X(t2) с. ф. X(t) при двух произвольных значениях t и t ¢ аргумента t .

![]()

![]() . (66.5)

. (66.5)

В общем случае функция X(t)

характеризуется большим числом n

-мерных законов распределения ![]() .

.

М.о. с.ф. X(t)

- неслучайная функция , которая при каждом значении аргумента t

равна м.о. ординаты с.ф. при этом аргументе t.

М.о. с.ф. X(t)

- неслучайная функция , которая при каждом значении аргумента t

равна м.о. ординаты с.ф. при этом аргументе t.

![]() - функция, зависящая от x

и t

.

- функция, зависящая от x

и t

.

Аналогично и дисперсия - неслучайная функция.

Степень зависимости с.в. для различных значений аргумента характеризуется автокорреляционной функцией.

Автокорреляционная функция с.ф. X(t) Kx(ti,tj) , которая при каждой паре значений ti, tj равна корреляционному моменту соответствующих ординат с.ф. (при i=j корреляционная функция (к.ф.) обращается в дисперсию с.ф.);

где - совместная плотность распределения двух с.в. (значений с.ф.), взятых при двух произвольных значениях t 1 и t 2 аргумента t . При t1=t2=t получаем дисперсию D(t).

Автокорреляционная функция - совокупность м.о. произведений отклонений двух ординат с.ф. , взятых при аргументах t1 и t 2, от ординат неслучайной функции м.о. , взятых при тех же аргументах.

Автокорреляционная функция характеризует степень изменчивости с.ф. при изменении аргумента. На рис. видно, что зависимость между значениями с.ф., соответствующим двум данным значениям аргумента t - слабее в первом случае.

Рис . Корреляционно связанные случайные функции

Если две с.ф. X(t) и Y(t) , образующие систему не являются независимыми, то тождественно не равна нулю их взаимная корреляционная функция:

где - совместная плотность распределения двух с.в. (значений двух с.ф. X(t) и Y(t) ), взятых при двух произвольных аргументах (t 1 - аргумент функции X(t) , t 2 - аргумент функции Y(t) ).

Если X(t) и Y(t) независимы, то K

XY(t1,t2

)=0. Система из n с.ф. X

1(t), X2(t),...,Xn(t)

характеризуется n

м.о. ![]() , n

автокорреляционными функциями и еще n

(n

-1)/2 корреляционными функциями .

, n

автокорреляционными функциями и еще n

(n

-1)/2 корреляционными функциями .

Взаимная корреляционная функция (характеризует связь между двумя с.ф., т.е. стохастическую зависимость) двух с.ф. X(t) и Y(t) - неслучайная функция двух аргументов t i и t j, которая при каждой паре значений t i, t j равна корреляционному моменту соответствующих сечений с.ф. Она устанавливает связь между двумя значениями двух функций (значения - с.в.), при двух аргументах t 1 и t 2.

Особое значение имеют стационарные случайные функции , вероятностные характеристики которых не меняются при любом сдвиге аргумента. М.о. стационарной с.ф. постоянно (т.е. не является функцией), а корреляционная функция зависит лишь от разности значений аргументов t i и t j.

Это четная функция (симметрично OY ).

При большом значении интервала времени t=t2-t1 отклонение ординаты с.ф. от ее м.о. в момент времени t 2 становится практически независимым от значения этого отклонения в момент времени t 1. В этом случае функция KX(t), дающая значение корреляционного момента между X(t1) и X(t2), при ½t ½®¥ стремится к нулю.

Многие стационарные с.ф. обладают эргодическим свойством, которое заключается в том, что при неограниченно возрастающем интервале наблюдения среднее наблюденное значение стационарной с.ф. с вероятностью, равной 1, будет неограниченно приближаться к ее м.о. Наблюдение стационарной с.ф. при разных значениях t на достаточно большом интервале в одном опыте равноценно наблюдению ее значений при одном и том же значении t в ряде опытов.

Иногда требуется определить характеристики преобразованных с.ф. по характеристикам исходных с.ф. Так если

![]() (70.5),

(70.5),

то ![]() т.е. м.о. интеграла (производной) от с.ф. равно интегралу (производной) от м.о. (y(t)

- скорость изменения с.ф. X(t)

, - скорость изменения м.о.).

т.е. м.о. интеграла (производной) от с.ф. равно интегралу (производной) от м.о. (y(t)

- скорость изменения с.ф. X(t)

, - скорость изменения м.о.).

При интегрировании или дифференцировании с.ф. получаем также с.ф. Если X(t)

распределена нормально, то Z(t)

и Y(t)

распределены тоже нормально. Если X(t)

– стационарная с.ф., то Z(t)

уже не стационарная с.ф., т.к. ![]() зависит от t

.

зависит от t

.

Примеры корреляционных функций.

1) ![]() (из (2) при b®0); 2)

(из (2) при b®0); 2) ![]() ;

;

3) ![]() ; 4)

; 4) ![]() ;

;

5)![]() (из (3) при b

®0); 6)

(из (3) при b

®0); 6) ![]() (из (4) при b

®0).

(из (4) при b

®0).

На графиках a = 1, b = 5, s = 1.

a - характеризует быстроту убывания корреляционной связи между ординатами с.ф. при увеличении разности аргументов этих ординат t.

a/b

- характеризует "степень нерегулярности процесса". При малом a/b

ординаты процесса оказываются сильно коррелированными и реализация процесса похожа на синусоиду; при большом a/b

(71.5).

(71.5).

Формула (71) для стационарной функции примет вид:

Корреляционная функция с.ф. и ее производной ![]() . Для дифференцируемого стационарного процесса ордината с.ф. и ее производной, взятая в тот же момент времени являются некоррелированными с.в. (а для нормального процесса и независимыми).

. Для дифференцируемого стационарного процесса ордината с.ф. и ее производной, взятая в тот же момент времени являются некоррелированными с.в. (а для нормального процесса и независимыми).

При умножении с.ф. на детерминированную получаем с.ф. Z(t)=a(t)X(t) , корреляционная функция которой равна

KZ(t1,t2)=a(t1)a(t2) KX(t1,t2) (72.5),

где a(t) - детерминированная функция.

Сумма двух с.ф. является тоже с.ф. Z(t)=X(t)+Y(t) и ее корреляционная функция при наличии корреляционной связи между X(t) и Y(t):

KZ(t1,t2)=KX(t1,t2)+ KY(t1,t2)+ 2KXY(t1,t2), (73.5)

где KXY(t1,t2) - см. (68.5) - взаимная корреляционная функция двух зависимых с.ф. X(t) и Y(t).

Если X(t)

и Y(t)

независимы, то KXY(t1,t2)

=0. М.о. с.ф. Z(t): ![]() .

.

Комплексной слуюйной функцией называютфункцию

Z (t )=X (t )+Y (t )i ,

где Х (t ) и Y (t )-действительные случайные функции действительного аргумента t .

Обобщим определения математического ожидания и дисперсии на комплексные случайные функции так, чтобы, в частности, при Y=0 эти характеристики совпали с ранее введенными характеристиками для действительных случайных функций, т. е. чтобы выполнялись требования:

m z (t )=m x (t )(*)

D z (t )=D x (t )(**)

Математическим , ожиданием , комплексной случайной функции Z (t )=Х (t )+Y (t )i называют комплексную функцию (неслучайную)

m z (t )=m x (t )+m y (t )i .

В частности, при Y=0 получим т z (t )=т x (t ),т.е. требование (*) выполняется.

Дисперсией комплексной случайной функции Z (t ) называют математическое ожидание квадрата модуля центрированной функции Z (t ):

D z (t )=M [| (t )| 2 ].

В частности, при Y==0 получим D z (t )= M [| (t )|] 2 =D x (t ), т. е. требование (**) выполняется.

Учитывая, что математическое ожидание суммы равно сумме математических ожиданий слагаемых, имеем

D z (t )=M [| (t )| 2 ]= M {[ (t )] 2 + [ (t ) 2 ]}= M [ (t )] 2 +M [ (t ) 2 ]= D x (t )+D y (t ).

Итак,дисперсия комплексной случайной функции равна сумме дисперсий ее действительной и мнимой частей:

D z (t )=D x (t )+D y (t ).

Известно, что корреляционная функция действительной случайной функции Х (t ) при разных значениях аргументов равна дисперсии D x (t ). Обобщим определение корреляционной функции на комплексные случайные функции Z (t ) так, чтобы при равных значениях аргументов t 1 =t 2 =t корреляционная функция K z (t , t ) была равна дисперсии D z (t ), т. е. чтобы выполнялось требование

K z (t , t )=D z (t ). (***)

Корреляционной функцией комплексной случайной функции Z (t ) называют корреляционный момент сечений (t 1)и (t 2)

K z (t 1 , t 2)= M .

В частности, при равных значениях аргументов

K z (t , t )= M =M [| | 2 ]= D z (t ).

т. е. требование (***) выполняется.

Если действительные случайные функции Х (t ) и Y (t )коррелированы, то

K z (t 1 , t 2)= K x (t 1 , t 2)+K y (t 1 , t 2)+ [R xy (t 2 ,t 1)]+ [ R xy (t 1 ,t 1)].

если Х (t ) и Y (t ) не коррелированы, то

K z (t 1 , t 2)= K x (t 1 , t 2)+K y (t 1 , t 2).

Обобщим определение взаимной корреляционной функции на комплексные случайные функции Z 1 (t )=Х 1 (t )+ Y 1 (t )i и Z 2 (t )=Х 2 (t )+ Y 2 (t )i так, чтобы, в частности, при Y 1 =Y 2 = 0 выполнялось требование

Взаимной корреляционной функцией двух комплексных случайных функций называют функцию (неслучайную)

В частности, при Y 1 =Y 2 =0 получим

т. е. требование (****) выполняется.

Взаимная корреляционная функция двух комплексных случайных функций выражается через взаимные корреляционные функции их действительных и мнимых частей следующей формулой:

Задачи

1. Найти математическое ожидание случайных функций:

a) X (t )=Ut 2 , где U- случайная величина, причем M (U )=5 ,

б ) Х (t )=U cos2t+Vt , где U и V- случайные величины, причем M (U )=3 , M (V )=4 .

Отв. а) m x (t)=5t 2 ; б) т x (t)=3 cos2t+4t.

2. К х (t 1 ,t 2) случайной функции X (t ). Найти корреляционные функции случайных функций:

a) Y (t )=X (t )+t; б) Y (t )=(t +1)X (t ); в) Y (t )=4X (t ).

Отв. a) К y (t 1 ,t 2)= К х (t 1 ,t 2); б) К y (t 1 ,t 2)=(t 1 +1)(t 2 +1) К х (t 1 ,t 2); в) К y (t 1 ,t 2)=16 К x (t 1 ,t 2)=.

3. Задана дисперсия D x (t ) случайной функции Х (t ). Найти дисперсию случайных функций: a) Y (t )=Х (t )+e t б ) Y (t )=tX (t ).

Отв . a) D y (t )=D x (t ); б) D y (t )=t 2 D x (t ).

4. Найти: а) математическое ожидание; б) корреляционную функцию; в) дисперсию случайной функции Х (t )=Usin 2t , где U- случайная величина, причем M (U )=3 , D (U )=6 .

Отв . а)m x (t ) =3sin 2t; б) К х (t 1 ,t 2)= 6sin 2t 1 sin 2t 2 ; в) D x (t )=6sin 2 2t .

5. Найти нормированную корреляционную функцию случайной функции X (t ), зная ее корреляционную функцию К х (t 1 ,t 2)=3cos (t 2 -t 1).

Отв. ρ x (t 1 ,t 2)=cos(t 2 -t 1).

6. Найти: а) взаимную корреляционную функцию; б) нормированную взаимную корреляционную функцию двух случайных функций X (t )=(t +1)U , и Y(t )= (t 2 + 1)U , где U- случайная величина, причем D (U )=7.

Отв . a) R xy (t 1 ,t 2)=7(t 1 +l)(t 2 2 +l); б) ρ xy (t 1 ,t 2)=1.

7. Заданы случайные функции Х (t )= (t- 1)U и Y (t )=t 2 U , где U и V - некоррелированные случайные величины, причем M (U )=2, M (V )= 3, D (U )=4 , D (V )=5 . Найти: а) математическое ожидание; б) корреляционную функцию; в) дисперсию суммы Z (t )=X (t )+Y (t ).

Указание. Убедиться, что взаимная корреляционная функция заданных случайных функций равна нулю и, следовательно, Х (t ) и Y (t ) не коррелированы.

Отв . а) m z (t )=2(t - 1)+3t 2 ; б) К z (t 1 ,t 2)=4(t 1 - l)(t 2 - 1)+6t 1 2 t 2 2 ; в) D z (t )=4(t - 1) 2 +6t 4 .

8. Задано математическое ожидание m x (t )=t 2 +1 случайной функции Х (t ). Найти математическое ожидание ее производной.

9. Задано математическое ожидание m x (t )=t 2 +3 случайной функции Х (t ). Найти математическое ожидание случайной функции Y (t )=tХ" (t )+t 3 .

Отв. m y (t)=t 2 (t+2).

10. Задана корреляционная функция К х (t 1 ,t 2)= случайной функции X (t ). Найти корреляционную функцию ее производной.

11. Задана корреляционная функция К х (t 1 ,t 2)= случайной функции Х (t ). Найти взаимные корреляционные функции.

Во всех предыдущих параграфах этой главы предполагалось, что управляющие и возмущающие воздействия являются определенными функциями времени. Однако для систем автоматического управления, работающих в реальных условиях, характерно, что эти воздействия носят случайный характер и принципиально непредсказуемы.

Рассмотрим, например, работу следящей системы, управляющей антенной радиолокатора. Для этой системы управляющим воздействием является положение цели, а возмущающими воздействиями можно считать ветровые нагрузки на антенну, отклонения луча от направления на цель из-за рефракции в атмосфере, собственные шумы в усилительном тракте системы, помехи от источников питания и т. п. Все эти процессы обусловлены множеством взаимодействующих причин и носят настолько сложный характер, что их нельзя представить какой-либо заданной функцией времени. То же самое можно сказать и относительно управляющего воздействия. На практике его нельзя считать типовым, например ступенчатым, линейно-растущим, синусоидальным или каким-либо регулярным сигналом. Реально цель маневрирует, поэтому ее положение в любой последующий момент не может быть точно предсказано. На этом маневрирование накладывается постоянное блуждание отражающей точки по корпусу цели.

Таким образом, сигналы управления и возмущения в реальных условиях являются случайными процессами. Случайным, или стохастическим процессом

называют такую функцию времени которая при каждом значении аргумента является случайной величиной. Если вместо времени употребляют другую независимую переменную, то используют термин случайная функция. При многократном воспроизведении условий протекания случайного процесса последний принимает каждый раз различные конкретные значения. Эти значения как функции времени называют реализациями случайного процесса. Типичный вид нескольких реализаций стохастического процесса ошибки угловой координаты цели, отслеживаемой радиолокационной станцией, представлен на рис. XIII. 14.

Математическое описание случайного процесса. При фиксированном значении аргумента случайный процесс является случайной величиной, полное описание которой дает функция распределения

т. е. вероятность того, что в данный момент случайная величина примет значение, меньшее Как известно из теории вероятностей, вместо функции распределения часто удобнее пользоваться плотностью вероятности, являющейся ее производной (в обобщенном смысле):

![]()

Если зафиксировать два момента времени то значения случайного процесса образуют систему двух случайных величин или двумерный случайный вектор. Для его полного описания требуется знать двумерную функцию распределения

Рис. ХIII.14. Стохастический процесс ошибки измерения угловой координаты цели, отслеживаемой радиолокационной станцией

или двумерную плотность

которые зависят от как от параметров.

Для более подробного описания случайного процесса в произвольные моменты времени аналогично вводятся функции распределения и плотности более высоких порядков. Таким образом, полное статистическое описание случайной функции (процесса) даетесконечная последовательность ее функций распределения:

или последовательность их производных

Каждый из членов этих последовательностей имеет обычные свойства функций распределения или соответственно плотностей. Кроме того, каждый следующий член последовательности определяет все предыдущие. Например, если положить то

аналогичные формулы имеем и для любых других моментов времени.

Это условие называют условием согласованности семейства функций распределения. Справедливо также условие симметрии:

В общем случае плотности или функции распределения более высокого порядка не определяются плотностями или функциями более низких порядков.

Однако часто полезно рассматривать так называемый абсолютно случайный процесс, значения которого независимы в совокупности для любых Для такого процесса плотность распределения любого порядка определяется через одномерную:

Такой процесс является математическим упрощением, поскольку при достаточно близких значениях значения любого реального процесса близки, и, следовательно, зависимы. Другим крайним случаем является вырожденный, или сингулярный процесс, определяемый одной или несколькими случайными величинами; например,

где - случайная величина; - известные константы. Такой процесс становится полностью известным, если можно измерить его в какой-либо момент времени. В более общем случае сингулярный случайный процесс характеризуется совокупностью случайных величин например,

![]()

где - обычные (детерминированные функции времени).

Рис. XIII.15. Возможные реализации двух случайных функций: а - с высокочастотными составляющими; б - с низкочастотными составляющими

Моментные функции. В практических задачах обычно пользуются более простыми характеристиками случайных процессов - моментными функциями. Моментом первого порядка или математическим ожиданием процесса называют выражение

Если эту функцию рассматривать в зависимости от то около среднего значения функции будут группироваться все реализации случайного процесса (рис. XIII.15).

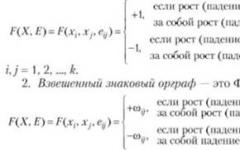

Математические ожидания более высоких степеней носятназвания начальных моментов порядка

Случайная функция имеет нулевое среднее значение и называется центрированной. Центральным моментом -порядка процесса называется математическое ожидание степени центрированного процесса

Меру рассеяния значений случайного процесса относительно математического ожидания его определяет момент второго порядка, называемый чаще дисперсией:

Однако характеристики случайного процесса, основанные на первой плотности не отражают изменения реализаций во времени. Например, два процесса с одной и той же первой плотностью (рис. XIII. 15, а и б) различаются по скорости изменения реализаций, т. е. по степени взаимосвязи между двумя значениями, принимаемыми в одной реализации в различные моменты времени. Для описания временной внутренней структуры случайных процессов используют корреляционную функцию

Эту функцию часто называют также автокорреляционной, или ковариацией, она играет основную роль в теории случайных процессов.

Легко показать, что корреляционная функция симметрична относительно своих аргументов а при ее значение равно дисперсии случайного процесса . В самом деле,

Для характеристики точности систем автоматического регулирования удобно использовать нецентрированную корреляционную функцию:

называемую также вторым начальным моментом процесса.

Связь между устанавливается следующими преобразованиями:

При средний квадрат процесса будет

В системах автоматического регулирования часто действует несколько случайных возмущающих или управляющих сигналов, независимых или взаимосвязанных. Мерой взаимосвязи двух случайных процессов служит взаимная корреляционная функция

где - совместная плотность вероятности для независимых процессов

Для взаимной корреляционной функции справедливо равенство

Теория случайных процессов, в которой используются лишь моменты первого и второго порядков называется корреляционной теорией. Она была создана основополагающими работами А. Н. Колмогорова , Д. Я. Хинчина , Н. Вииера. Большой вклад в ее развитие внесли советские ученые В. С. Пугачев , В. В. Солодовников и др.

Стационарные случайные процессы. При рассмотрении различных случайных процессов выделяют группу процессов, статистические свойства которых не изменяются при сдвиге во времени. Такие процессы называются стационарными. Рассматривая множество реализаций случайного процесса, приведенного на рис. XIII. 14, можно предположить, что в данном случае начало отсчета времени может быть выбрано произвольно, т. е. налицо стационарный процесс. Напротив, на рис. XIII. 15, очевидно, имеем примеры нестационарных процессов.

Исследование систем, случайные процессы в которых стационарны, значительно проще, чем исследование систем с нестационарными процессами. Однако процессы во многих системах регулирования можно приближенно рассматривать как стационарные. Это имеет большое прикладное значение в теории стационарных случайных процессов.

По определению стационарного случайного процесса его математическое ожидание должно быть постоянно при сдвиге аргумента на любой тервал Т:

а корреляционная функция удовлетворяет соотношению

Полагая находим, что корреляционная функция стационарного процесса зависит только от разности отсчетов

Эргодические свойства случайных процессов. Если мы имеем совокупность, или, как говорят, ансамбль реализаций, то математическое ожидание и корреляционная функция получаются усреднением по ансамблю реализаций случайного процесса, т. е. «поперек» процесса в одном или соответственно двух его сечениях. Интересно рассмотреть также результаты усреднения реализаций стационарного процесса по времени вдоль оси на интервале , определив эту операцию естественным образом:

Эта величина различна для разных реализаций случайного процесса и сама является случайной. Можно показать, что ее математическое ожидание для стационарного процесса равно . В то же время дисперсия этой величины, как показывают непосредственные расчеты,

Рис. XIII.16. Структурная схема коррелятора

Условия эргодичности процесса по , сформулированные В. С. Пугачевым , содержат более высокие моменты случайного процесса и здесь не приводятся.

Свойства эргодичности случайных процессов позволяют заменить усреднение по множеству реализаций, практически редко осуществимое, усреднением по времени, взятым по одной реализации, когда Т велико..

Не все стационарные процессы имеют эргодические свойства. Например, процесс, все реализации которого есть случайные величины, не изменяющиеся во времени, как легко убедиться, неэргодичен. Отсюда следует, что физический смысл эргодичности заключается в «хорошей перемешиваемости» реализаций случайного процесса. Поскольку это имеет место практически во всех приложениях, в дальнейшем будем предполагать рассматриваемые процессы эргодическими.

Для таких процессов можно экспериментально определить среднее значение и корреляционную функцию процесса с помощью специальных приборов - корреляторов. Принцип действия корреляторов ясен из рис. XIII.16.

Подавая на вход коррелятора единичный сигнал, на его выходе при достаточно большом времени интегрирования Т будем иметь среднее значение процесса х, приблизительно совпадающее с его математическим ожиданием Если же то в результате будем иметь второй начальный момент по которому легко определить и корреляционную функцию.

Предварительные замечания. Найдем изображение Фурье от d -функции.

Очевидно, справедливо и обратное преобразование Фурье:

А также:

1. Пусть процесс представляет собой постоянную величину x(t)=A o . Как уже было выяснено ранее, корреляционная функция такого процесса равна Найдем спектральную плотность процесса путем прямого преобразования Фурье функции R(t):

![]()

Спектр процесса состоит из единственного пика типа импульсной функции, расположенной в начале координат. Таким образом, если в процессе присутствует только одна частота w =0, то это значит, что вся мощность процесса сосредоточена на этой частоте, что и подтверждает вид функции S(w). Если случайная функция содержит постоянную составляющую, т.е. среднее значение , то S(w) будет иметь разрыв непрерывности в начале координат и будет характеризоваться наличием d -функции в точке w =0.

2. Для гармонической функции X=A o sin(w 0 t+j) корреляционная функция:

![]()

Спектральная плотность равна

График S(w) будет иметь два пика типа импульсной функции, расположенных симметрично относительно начала координат при w= +w 0 и w= -w 0 . Это говорит о том, что мощность процесса сосредоточена на двух частотах +w 0 и -w 0 .

Если случайная функция имеет гармонические составляющие, то спектральная плотность имеет разрывы непрерывности в точках w = ±w 0 и характеризуется наличием двух дельта-функций, расположенных в этих точках.

Белый шум . Под белым шумом понимают случайный процесс, имеющий одинаковые значения спектральной плотности на всех частотах от -¥ до +¥ : S(w ) = Const.

Примером такого процесса при определенных допущениях являются тепловые шумы, космическое излучение и др. Корреляционная функция такого процесса равна

![]()

Таким образом R(t) представляет собой импульсную функцию, расположенную в начале координат.

Этот процесс является чисто случайным процессом, т.к. при любом t ¹0 отсутствует корреляция между последующими и предыдущими значениями случайной функции. Процесс с такой спектральной плотностью является физически нереальным, т.к. ему соответствуют бесконечно большие дисперсия и средний квадрат случайной величины:

![]()

Такому процессу соответствует бесконечно большая мощность и источник с бесконечно большой энергией.

2. Белый шум с ограниченной полосой частот. Такой процесс характеризуется спектральной плотностью вида

S(w)=C при ½w½ <w n ,

S(w) =0 при ½w½>w n .

где (-w n , w n) полоса частот для спектральной плотности.

Это такой случайный процесс, спектральная плотность которого остается практически постоянной в диапазоне частот, могущих оказать влияние на рассматриваемую систему управления, т.е. в диапазоне частот, пропускаемых системой. Вид кривой S (w ) вне этого диапазона не имеет значения, т.к. часть кривой, соответствующая высшим частотам, не окажет влияния на работу системы. Этому процессу соответствует корреляционная функция

Дисперсия процесса равна

5. Типовой входной сигнал следящей системы. В качестве типового сигнала принимают сигнал, график которого показан на рис.63. Скорость вращения задающего вала следящей системы сохраняет постоянное значение в течение некоторых интервалов времени t 1 , t 2 ,...

Переход от одного значения к другому совершается мгновенно. Интервалы времени подчиняются закону распределения Пуассона. Математическое ожидание

Рис.63. Типовой сигнал

График такого вида получается в первом приближении при слежении РЛС за движущейся целью. Постоянные значения скорости соответствуют движению цели по прямой. Перемена знака или величины скорости соответствует маневру цели.

Пусть m -среднее число перемен скорости за 1 с. Тогда Т=1/m будет среднее значение интервалов времени, в течение которых угловая скорость сохраняет свое постоянное значение. Применительно к РЛС это значение будет средним временем движения цели по прямой. Для определения корреляционной функции необходимо найти среднее значение произведения

![]()

При нахождении этого значения могут быть два случая.

1. Моменты времени t и t+t относятся к одному интервалу. Тогда среднее произведения угловых скоростей будет равно среднему квадрату угловой скорости или дисперсии:

2. Моменты времениt и t+t относятся к разным интервалам. Тогда среднее произведения скоростей будет равно нулю, так как величины W(t) и W(t+t) для разных интервалов можно считать независимыми величинами:

Корреляционная функция равна:

где, Р 1 - вероятность нахождения моментов времени t и t+t в одном интервале, а Р 2 =1- Р 1 вероятность нахождения их в разных интервалах.

Оценим величину Р 1 . Вероятность появления перемены скорости на малом интервале времени Dt пропорциональна этому интервалу и равна mDt или Dt/Т. Вероятность отсутствия перемены скорости для этого же интервала будет равна 1-Dt/Т. Для интервала времени t вероятность отсутствия перемены скорости т.е. вероятность нахождения моментов времени t и t+t в одном интервале постоянной скорости будет равна произведению вероятности отсутствий перемены скорости на каждом элементарном промежутке Dt, т.к. эти события независимые. Для конечного промежутка получаем, что число промежутков равно t/Dt и

![]()

Перейдя к пределу, получим