Корреляционный анализ .

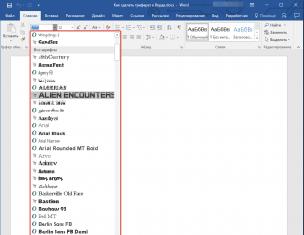

Уравнение парной регрессии .

Использование графического метода .

Этот метод применяют для наглядного изображения формы связи между изучаемыми экономическими показателями. Для этого в прямоугольной системе координат строят график, по оси ординат откладывают индивидуальные значения результативного признака Y, а по оси абсцисс - индивидуальные значения факторного признака X.

Совокупность точек результативного и факторного признаков называется полем корреляции .

На основании поля корреляции можно выдвинуть гипотезу (для генеральной совокупности) о том, что связь между всеми возможными значениями X и Y носит линейный характер.

Линейное уравнение регрессии имеет вид y = bx + a + ε

Здесь ε - случайная ошибка (отклонение, возмущение).

Причины существования случайной ошибки:

1. Невключение в регрессионную модель значимых объясняющих переменных;

2. Агрегирование переменных. Например, функция суммарного потребления – это попытка общего выражения совокупности решений отдельных индивидов о расходах. Это лишь аппроксимация отдельных соотношений, которые имеют разные параметры.

3. Неправильное описание структуры модели;

4. Неправильная функциональная спецификация;

5. Ошибки измерения.

Так как отклонения ε i для каждого конкретного наблюдения i – случайны и их значения в выборке неизвестны, то:

1) по наблюдениям x i и y i можно получить только оценки параметров α и β

2) Оценками параметров α и β регрессионной модели являются соответственно величины а и b, которые носят случайный характер, т.к. соответствуют случайной выборке;

Тогда оценочное уравнение регрессии (построенное по выборочным данным) будет иметь вид y = bx + a + ε, где e i – наблюдаемые значения (оценки) ошибок ε i , а и b соответственно оценки параметров α и β регрессионной модели, которые следует найти.

Для оценки параметров α и β - используют МНК (метод наименьших квадратов). Метод наименьших квадратов дает наилучшие (состоятельные, эффективные и несмещенные) оценки параметров уравнения регрессии.

Но только в том случае, если выполняются определенные предпосылки относительно случайного члена (ε) и независимой переменной (x).

Формально критерий МНК можно записать так:

S = ∑(y i - y * i) 2 → min

Система нормальных уравнений.

a n + b∑x = ∑y

a∑x + b∑x 2 = ∑y x

Для наших данных система уравнений имеет вид

15a + 186.4 b = 17.01

186.4 a + 2360.9 b = 208.25

Из первого уравнения выражаем а и подставим во второе уравнение:

Получаем эмпирические коэффициенты регрессии: b = -0.07024, a = 2.0069

Уравнение регрессии (эмпирическое уравнение регрессии):

y = -0.07024 x + 2.0069

Эмпирические коэффициенты регрессии a и b являются лишь оценками теоретических коэффициентов β i , а само уравнение отражает лишь общую тенденцию в поведении рассматриваемых переменных.

Для расчета параметров регрессии построим расчетную таблицу (табл. 1)

1. Параметры уравнения регрессии.

Выборочные средние.

Выборочные дисперсии:

Среднеквадратическое отклонение

1.1. Коэффициент корреляции

Ковариация .

Рассчитываем показатель тесноты связи. Таким показателем является выборочный линейный коэффициент корреляции, который рассчитывается по формуле:

Линейный коэффициент корреляции принимает значения от –1 до +1.

Связи между признаками могут быть слабыми и сильными (тесными). Их критерии оцениваются по шкале Чеддока:

0.1 < r xy < 0.3: слабая;

0.3 < r xy < 0.5: умеренная;

0.5 < r xy < 0.7: заметная;

0.7 < r xy < 0.9: высокая;

0.9 < r xy < 1: весьма высокая;

В нашем примере связь между признаком Y фактором X высокая и обратная.

Кроме того, коэффициент линейной парной корреляции может быть определен через коэффициент регрессии b:

1.2. Уравнение регрессии (оценка уравнения регрессии).

Линейное уравнение регрессии имеет вид y = -0.0702 x + 2.01

Коэффициентам уравнения линейной регрессии можно придать экономический смысл.

Коэффициент регрессии b = -0.0702 показывает среднее изменение результативного показателя (в единицах измерения у) с повышением или понижением величины фактора х на единицу его измерения. В данном примере с увеличением на 1 единицу y понижается в среднем на -0.0702.

Коэффициент a = 2.01 формально показывает прогнозируемый уровень у, но только в том случае, если х=0 находится близко с выборочными значениями.

Но если х=0 находится далеко от выборочных значений х, то буквальная интерпретация может привести к неверным результатам, и даже если линия регрессии довольно точно описывает значения наблюдаемой выборки, нет гарантий, что также будет при экстраполяции влево или вправо.

Подставив в уравнение регрессии соответствующие значения х, можно определить выровненные (предсказанные) значения результативного показателя y(x) для каждого наблюдения.

Связь между у и х определяет знак коэффициента регрессии b (если > 0 – прямая связь, иначе - обратная). В нашем примере связь обратная.

1.3. Коэффициент эластичности .

Коэффициенты регрессии (в примере b) нежелательно использовать для непосредственной оценки влияния факторов на результативный признак в том случае, если существует различие единиц измерения результативного показателя у и факторного признака х.

Для этих целей вычисляются коэффициенты эластичности и бета - коэффициенты.

Средний коэффициент эластичности E показывает, на сколько процентов в среднем по совокупности изменится результат у от своей средней величины при изменении фактора x на 1% от своего среднего значения.

Коэффициент эластичности находится по формуле:

Коэффициент эластичности меньше 1. Следовательно, при изменении Х на 1%, Y изменится менее чем на 1%. Другими словами - влияние Х на Y не существенно.

Бета – коэффициент

Бета – коэффициент показывает, на какую часть величины своего среднего квадратичного отклонения изменится в среднем значение результативного признака при изменении факторного признака на величину его среднеквадратического отклонения при фиксированном на постоянном уровне значении остальных независимых переменных:

Т.е. увеличение x на величину среднеквадратического отклонения S x приведет к уменьшению среднего значения Y на 0.82 среднеквадратичного отклонения S y .

1.4. Ошибка аппроксимации .

Оценим качество уравнения регрессии с помощью ошибки абсолютной аппроксимации. Средняя ошибка аппроксимации - среднее отклонение расчетных значений от фактических:

Ошибка аппроксимации в пределах 5%-7% свидетельствует о хорошем подборе уравнения регрессии к исходным данным.

Поскольку ошибка меньше 7%, то данное уравнение можно использовать в качестве регрессии.

100 р бонус за первый заказ

Выберите тип работы Дипломная работа Курсовая работа Реферат Магистерская диссертация Отчёт по практике Статья Доклад Рецензия Контрольная работа Монография Решение задач Бизнес-план Ответы на вопросы Творческая работа Эссе Чертёж Сочинения Перевод Презентации Набор текста Другое Повышение уникальности текста Кандидатская диссертация Лабораторная работа Помощь on-line

Узнать цену

При оценке параметров уравнения регрессии применяется метод наименьших квадратов (МНК). При этом делаются определенные предпосылки относительно случайной составляющей e. В модели – случайная составляющая e представляет собой ненаблюдаемую величину. После того как произведена оценка параметров модели, рассчитывая разности фактических и теоретических значений результативного признака y , можно определить оценки случайной составляющей . Поскольку они не являются реальными случайными остатками, их можно считать некоторой выборочной реализацией неизвестного остатка заданного уравнения, т. е. ei.

При изменении спецификации модели, добавлении в нее новых наблюдений выборочные оценки остатков ei могут меняться. Поэтому в задачу регрессионного анализа входит не только построение самой модели, но и исследование случайных отклонений ei, т. е. остаточных величин.

При использовании критериев Фишера и Стьюдента делаются предположения относительно поведения остатков ei – остатки представляют собой независимые случайные величины и их среднее значение равно 0; они имеют одинаковую (постоянную) дисперсию и подчиняются нормальному распределению.

Статистические проверки параметров регрессии, показателей корреляции основаны на непроверяемых предпосылках распределения случайной составляющей ei. Они носят лишь предварительный характер. После построения уравнения регрессии проводится проверка наличия у

оценок ei (случайных остатков) тех свойств, которые предполагались. Связано это с тем, что оценки параметров регрессии должны отвечать определенным критериям. Они должны быть несмещенными, состоятельными и эффективными. Эти свойства оценок, полученных по МНК, имеют чрезвычайно важное практическое значение в использовании результатов регрессии и корреляции.

Несмещенность оценки означает, что математическое ожидание остатков равно нулю. Если оценки обладают свойством несмещенности, то их можно сравнивать по разным исследованиям.

Оценки считаются эффективными , если они характеризуются наименьшей дисперсией. В практических исследованиях это означает возможность перехода от точечного оценивания к интервальному.

Состоятельность оценок характеризует увеличение их точности с увеличением объема выборки. Большой практический интерес представляют те результаты регрессии, для которых доверительный интервал ожидаемого значения параметра регрессии bi имеет предел значений вероятности, равный единице. Иными словами, вероятность получения оценки на заданном расстоянии от истинного значения параметра близка к единице.

Указанные критерии оценок (несмещенность, состоятельность и эффективность) обязательно учитываются при разных способах оценивания. Метод наименьших квадратов строит оценки регрессии на основе минимизации суммы квадратов остатков. Поэтому очень важно исследовать поведение остаточных величин регрессии ei. Условия, необходимые для получения несмещенных, состоятельных и эффективных оценок, представляют собой предпосылки МНК, соблюдение которых желательно для получения достоверных результатов регрессии.

Исследования остатков ei предполагают проверку наличия следующих пяти предпосылок МНК :

1. случайный характер остатков;

2. нулевая средняя величина остатков, не зависящая от xi;

3. гомоскедастичность – дисперсия каждого отклонения ei, одинакова для всех значений x ;

4. отсутствие автокорреляции остатков – значения остатков ei распределены независимо друг от друга;

5. остатки подчиняются нормальному распределению.

Если распределение случайных остатков ei не соответствует некоторым предпосылкам МНК, то следует корректировать модель.

Прежде всего, проверяется случайный характер остатков ei – первая предпосылка МНК. С этой целью стоится график зависимости остатков ei от теоретических значений результативного признака.

Если на графике получена горизонтальная полоса, то остатки ei представляют собой случайные величины и МНК оправдан, теоретические значения хорошо аппроксимируют фактические значения y.

Возможны следующие случаи, если ei зависит от то:

1) остатки ei не случайны

1) остатки ei не случайны

2) остатки ei не имеют постоянной дисперсии

3) остатки ei носят систематический характер.

В этих случаях необходимо либо применять другую функцию, либо вводить дополнительную информацию и заново строить уравнение регрессии до тех пор, пока остатки ei не будут случайными величинами.

Вторая предпосылка МНК относительно нулевой средней величины остатков означает, что ![]() . Это выполнимо для линейных моделей и моделей, нелинейных относительно включаемых переменных.

. Это выполнимо для линейных моделей и моделей, нелинейных относительно включаемых переменных.

Вместе с тем несмещенность оценок коэффициентов регрессии, полученных МНК, зависит от независимости случайных остатков и величин x, что также исследуется в рамках соблюдения второй предпосылки МНК. С этой целью наряду с изложенным графиком зависимости остатков ei от теоретических значений результативного признака строится график зависимости случайных остатков ei от факторов, включенных в регрессию xj.

Если остатки на графике расположены в виде горизонтальной полосы, то они независимы от значений xj. Если же график показывает наличие зависимости ei и xj, то модель неадекватна. Причины неадекватности могут быть разные. Возможно, что нарушена третья предпосылка МНК и дисперсия остатков не постоянна для каждого значения фактора xj. Может быть неправильна спецификация модели и в нее необходимо ввести

дополнительные члены от xj, например . Скопление точек в определенных участках значений фактора xj говорит о наличии систематической погрешности модели.

Предпосылка о нормальном распределении остатков позволяет проводить проверку параметров регрессии и корреляции с помощью F - и t -критериев. Вместе с тем оценки регрессии, найденные с применением МНК, обладают хорошими свойствами даже при отсутствии нормального распределения остатков, т.е. при нарушении пятой предпосылки МНК.

Совершенно необходимым для получения по МНК состоятельных оценок параметров регрессии является соблюдение третьей и четвертой предпосылок.

В соответствии с третьей предпосылкой МНК требуется, чтобы дисперсия остатков была гомоскедастичной

. Это значит, что для каждого значения фактора xj

остатки ei имеют одинаковую дисперсию. Если это условие применения МНК не соблюдается, то имеет место гетероскедастичность

. Наличие гетероскедастичности можно наглядно видеть из поля корреляции:

В соответствии с третьей предпосылкой МНК требуется, чтобы дисперсия остатков была гомоскедастичной

. Это значит, что для каждого значения фактора xj

остатки ei имеют одинаковую дисперсию. Если это условие применения МНК не соблюдается, то имеет место гетероскедастичность

. Наличие гетероскедастичности можно наглядно видеть из поля корреляции:

1. Дисперсия остатков растет по мере увеличения x.

Тогда имеем следующий вид гетероскедастичности: большая дисперсия ei для больших значений

2. Дисперсия остатков достигает максимальной величины при средних значениях x, и уменьшается при минимальных и максимальных значениях.

Тогда имеем следующий вид гетероскедастичности: большая дисперсия ei для средних значений , и малая дисперсия ei для малых и больших значений

Тогда имеем следующий вид гетероскедастичности: большая дисперсия ei для средних значений , и малая дисперсия ei для малых и больших значений

3. Максимальная дисперсия остатков при малых значениях x и дисперсия остатков однородна по мере увеличения x.

3. Максимальная дисперсия остатков при малых значениях x и дисперсия остатков однородна по мере увеличения x.

Тогда имеем следующий вид гетероскедастичности: большая дисперсия ei для малых значений , уменьшение дисперсии остатков ei по мере увеличения

Тогда имеем следующий вид гетероскедастичности: большая дисперсия ei для малых значений , уменьшение дисперсии остатков ei по мере увеличения

При построении регрессионных моделей чрезвычайно важно соблюдение четвертой предпосылки МНК – отсутствие автокорреляции остатков, т. е. значения остатков ei распределены независимо друг от друга.

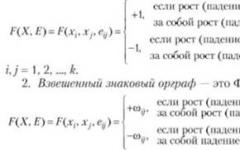

Автокорреляция остатков означает наличие корреляции между остатками текущих и предыдущих (последующих) наблюдений. Коэффициент корреляции между ei и ej , где ei – остатки текущих наблюдений, ej – остатки предыдущих наблюдений (например, j=i-1), может быть определен как:

т. е. по обычной формуле линейного коэффициента корреляции. Если этот коэффициент окажется существенно отличным от нуля, то остатки автокоррелированы и функция плотности вероятности F(e) зависит от j –й точки наблюдения и от распределения значений остатков в других точках наблюдения.

Отсутствие автокорреляции остаточных величин обеспечивает состоятельность и эффективность оценок коэффициентов регрессии. Особенно актуально соблюдение данной предпосылки МНК при построении регрессионных моделей по рядам динамики, где ввиду наличия тенденции последующие уровни динамического ряда, как правило, зависят от своих предыдущих уровней.

При несоблюдении основных предпосылок МНК приходится корректировать модель, изменяя ее спецификацию, добавлять (исключать) некоторые факторы, преобразовывать исходные данные для того, чтобы получить оценки коэффициентов регрессии, которые обладают свойством несмещенности, имеют меньшее значение дисперсии остатков и обеспечивают в связи с этим более эффективную статистическую проверку значимости параметров регрессии.

Первое выражение позволяет по заданным значениям фактора x рассчитать теоретические значения результативного признака, подставляя в него фактические значения фактора x . На графике теоретические значения лежат на прямой, которые представляют собой линию регрессии.

Построение линейной регрессии сводится к оценке ее параметров- а и b . Классический подход к оцениванию параметров линейной регрессии основан на методе наименьших квадратов (МНК).

Для нахождения минимума надо вычислить частные производные суммы (4) по каждому из параметров – а и b – и приравнять их к нулю.

(5)

(5)

Преобразуем, получаем систему нормальных уравнений:

(6)

(6)

В этой системе n- объем выборки, суммы легко рассчитываются из исходных данных. Решаем систему относительно а и b , получаем:

(7)

(7)

. (8)

. (8)

Выражение (7) можно записать в другом виде:

(9)

(9)

где ![]() ковариация признаков, дисперсия фактора x.

ковариация признаков, дисперсия фактора x.

Параметр b называется коэффициентом регрессии. Его величина показывает среднее изменение результата с изменением фактора на одну единицу. Возможность четкой экономической интерпретации коэффициента регрессии сделала линейное уравнение парной регрессии достаточно распространенным в эконометрических исследованиях.

Формально a – значение y при x=0. Если x не имеет и не может иметь нулевого значения, то такая трактовка свободного члена a не имеет смысла. Параметр a может не иметь экономического содержания. Попытки экономически интерпретировать его могут привести к абсурду, особенно при a < 0. Интерпретировать можно лишь знак при параметре a. Если a > 0, то относительное изменение результата происходит медленнее, чем изменение фактора. Сравним эти относительные изменения:

< при > 0, > 0  <

<

Иногда линейное уравнение парной регрессии записывают для отклонений от средних значений:

где , . При этом свободный член равен нулю, что и отражено в выражении (10). Этот факт следует из геометрических соображений: уравнению регрессии отвечает та же прямая (3), но при оценке регрессии в отклонениях начало координат перемещается в точку с координатами . При этом в выражении (8) обе суммы будут равны нулю, что и повлечет равенство нулю свободного члена.

Рассмотрим в качестве примера по группе предприятий, выпускающих один вид продукции, регрессионную зависимость издержек от выпуска продукции ![]() .

.

Таблица 1

| Выпуск продукции тыс.ед.() | Затраты на производство, млн.руб.() | ||||

| 31,1 | |||||

| 67,9 | |||||

| 141,6 | |||||

| 104,7 | |||||

| 178,4 | |||||

| 104,7 | |||||

| 141,6 | |||||

| Итого: 22 | 770,0 |

Система нормальных уравнений будет иметь вид:

Решая её, получаем a= -5,79, b=36,84.

Уравнение регрессии имеет вид:

Подставив в уравнение значения х , найдем теоретические значения y (последняя колонка таблицы).

Величина a не имеет экономического смысла. Если переменные x и y выразить через отклонения от средних уровней, то линия регрессии на графике пройдет через начало координат. Оценка коэффициента регрессии при этом не изменится:

![]() , где , .

, где , .

В качестве другого примера рассмотрим функцию потребления в виде:

![]() ,

,

где С- потребление, y –доход, K,L- параметры. Данное уравнение линейной регрессии обычно используется в увязке с балансовым равенством:

![]() ,

,

где I – размер инвестиций, r – сбережения.

Для простоты предположим, что доход расходуется на потребление и инвестиции. Таким образом, рассматривается система уравнений:

Наличие балансового равенства накладывает ограничения на величину коэффициента регрессии, которая не может быть больше единицы, т.е. .

Предположим, что функция потребления составила:

![]() .

.

Коэффициент регрессии характеризует склонность к потреблению. Он показывает, что из каждой тысячи рублей дохода на потребление расходуется в среднем 650 руб., а 350 руб. инвестируется. Если рассчитать регрессию размера инвестиций от дохода, т.е. , то уравнение регрессии составит ![]() . Это уравнение можно и не определять, поскольку оно выводится из функции потребления. Коэффициенты регрессии этих двух уравнений связаны равенством:

. Это уравнение можно и не определять, поскольку оно выводится из функции потребления. Коэффициенты регрессии этих двух уравнений связаны равенством:

Если коэффициент регрессии оказывается больше единицы, то , и на потребление расходуются не только доходы, но и сбережения.

Коэффициент регрессии в функции потребления используется для расчета мультипликатора:

Здесь m ≈2,86, поэтому дополнительные вложения 1 тыс. руб. на длительный срок приведут при прочих равных условиях к дополнительному доходу 2,86 тыс. руб.

При линейной регрессии в качестве показателя тесноты связи выступает линейный коэффициент корреляции r:

| (11) |

Его значения находятся в границах: . Если b

> 0, то при b

< 0 ![]() . По данным примера , что означает очень тесную зависимость затрат на производство от величины объема выпускаемой продукции.

. По данным примера , что означает очень тесную зависимость затрат на производство от величины объема выпускаемой продукции.

Для оценки качества подбора линейной функции рассчитывается коэффициент детерминации как квадрат линейного коэффициента корреляции r 2 . Он характеризует долю дисперсии результативного признака y , объясняемую регрессией, в общей дисперсии результативного признака:

| (12) |

Величина характеризует долю дисперсии y , вызванную влиянием остальных, не учтенных в модели факторов.

В примере . Уравнением регрессии объясняется 98,2% дисперсии , а на прочие факторы приходится 1,8%, это остаточная дисперсия.

1.3. Предпосылки МНК (условия Гаусса-Маркова)

Как было сказано выше, связь между y и x в парной регрессии является не функциональной, а корреляционной. Поэтому оценки параметров a и b являются случайными величинами, свойства которых существенно зависят от свойств случайной составляющей ε. Для получения по МНК наилучших результатов необходимо выполнение следующих предпосылок относительно случайного отклонения (условия Гаусса-Маркова):

1 0 . Математическое ожидание случайного отклонения равно нулю для всех наблюдений: ![]() .

.

2 0 . Дисперсия случайных отклонений постоянна: .

Выполнимость данной предпосылки называется гомоскедастичностью (постоянством дисперсии отклонений). Невыполнимость данной предпосылки называется гетероскедастичностью (непостоянством дисперсии отклонений)

3 0 . Случайные отклонения ε i и ε j являются независимыми друг от друга для :

Выполнимость этого условия называется отсутствием автокорреляции .

4 0 . Случайное отклонение должно быть независимо от объясняющих переменных.

Обычно это условие выполняется автоматически, если объясняющие переменные в данной модели не являются случайными. Кроме того, выполнимость данной предпосылки для эконометрических моделей не столь критична по сравнению с первыми тремя.

При выполнимости указанных предпосылок имеет место теорема Гаусса -Маркова : оценки (7) и (8), полученные по МНК, имеют наименьшую дисперсию в классе всех линейных несмещенных оценок .

Таким образом, при выполнении условий Гаусса-Маркова оценки (7) и (8) являются не только несмещенными оценками коэффициентов регрессии, но и наиболее эффективными, т.е. имеют наименьшую дисперсию по сравнению с любыми другими оценками данных параметров, линейными относительно величин y i .

Именно понимание важности условий Гаусса-Маркова отличает компетентного исследователя, использующего регрессионный анализ, от некомпетентного. Если эти условия не выполнены, исследователь должен это сознавать. Если корректирующие действия возможны, то аналитик должен быть в состоянии их выполнить. Если ситуацию исправить невозможно, исследователь должен быть способен оценить, насколько серьезно это может повлиять на результаты.

Введение

В эконометрике широко используются методы статистики. Ставя цель дать количественное описание взаимосвязей между экономическими переменными, эконометрика, прежде всего, связана с методами регрессии и корреляции.

В зависимости от количества факторов, включенных в уравнение регрессии, принято различать простую (парную) и множественную регрессии.

Простая регрессия представляет собой модель, где среднее значение зависимой (объясняемой) переменной у рассматривается как функция одной независимой (объясняющей) переменной х, т.е. это модель вида

Множественная регрессия представляет собой модель, где среднее значение зависимой (объясняемой) переменной у рассматривается как функция нескольких независимых (объясняющих) переменных х 1 , х 2 ,..., т.е. это модель вида

У = ѓ (х 1 , х 2 …, х k).

Методам простой или парной регрессии и корреляции, возможностям их применения в эконометрике посвящена данная работа.

Линейная регрессия и корреляция: смысл и оценка параметров

Линейная регрессия находит широкое применение в эконометрике ввиду четкой экономической интерпретации ее параметров. Линейная регрессия сводится к нахождению уравнения вида

y x = a + b * x или y = a + b * x + е. (1)

Уравнение вида y x = a + b * x позволяет по заданным значениям фактора x иметь теоретические значения результативного признака подстановкой в него фактических значений фактора x (рис 1)

Построение линейной регрессии сводится к оценке ее параметров - a и b. Оценки параметров линейной регрессии могут быть найдены разными методами. Можно обратиться к полю корреляции и, выбрав на графике две точки, провести через них прямую линию (см. рис.1), затем по графику найти значения параметров. Параметр a определим, как точку пересечения линии регрессии с осью oy а параметр b оценим исходя из угла наклона линии регрессии как dy/dx, где dy - приращение результата y, а dx - приращение фактора x т. е.

Классический подход к оцениванию параметров линейной регрессии основан на методе наименьших квадратов (МНК).

Метод наименьших квадратов позволяет получить такие оценки параметров а и b, при которых сумма квадратов отклонений фактических значений результативного признака у от расчетных (теоретических) у х минимальна:

У(yi - yx i) 2 > min (2)

Иными словами, из всего множества линий линия регрессии на графике выбирается так, чтобы сумма квадратов расстояний по вертикали между точками и этой линией была бы минимальной (рис. 2.):

е i = y i - y x ,

следовательно,

Для того чтобы найти минимум функции (2), надо вычислить частные производные по каждому из параметров a и b и приравнять их к нулю.

Обозначим У е i 2 через S, тогда:

S = У(y i - y x)2 = У(y - a - b *x)2 ;

dS / da = - 2Уy + 2 * n*a + 2 *bУx= 0; (3)

dS / da = - 2Уy * x + 2 *a Уx + 2 * b Уx 2 = 0.

Преобразовывая формулу (3), получим следующую систему нормальных уравнений для оценки параметров a и b:

N *a + bУx = Уy,

aУx + b Уx 2 = Уy * x. (4)

Решая систему нормальных уравнений (4) либо методом последовательного исключения переменных, либо методом определителей, найдем искомые оценки параметров а и Ь. Можно воспользоваться следующими формулами для a и b:

a = y - b * x (5)

Формула (5) получена из первого уравнения системы (4), если всего его члены разделить на n:

b = cov(x,y) / у 2 x

где cov(x,y) - ковариация признаков; у 2 x - дисперсия признака х.

Поскольку cov(x,y) = yx - y * x , а у 2 x = x 2 - x -2 , получим следующую формулу расчета оценки параметра b:

b = yx - y * x / x 2 - x 2 (6)

Формула (6) получается также при решении системы (4) методом определителей, если все элементы расчета разделить на n 2 .

Параметр b называется коэффициентом регрессии. Его величина показывает среднее изменение результата с изменением фактора на одну единицу. Так, если функция издержек (y, тыс. руб.) выражается как y x = 3000 + 2 * x , (x - количество единиц продукции), то, следовательно, с увеличением объема продукции x на одну единицу издержки производства возрастают в среднем на 2 тыс. руб., т. е. дополнительный прирост продукции на одну единицу потребует увеличения затрат в среднем на 2 тыс. руб.

Знак при коэффициенте регрессии b показывает направление связи: при b > 0 - связь прямая, а при b < 0 - связь обратная.

Возможность четкой экономической интерпретации коэффициента регрессии сделала линейное уравнение регрессии достаточно распространенным в эконометрических исследованиях.

Формально a - значение y при x = 0. Если признак-фактор x не имеет и не может иметь нулевого значения, то трактовка свободного члена a не имеет смысла. Параметр a может не иметь экономического содержания. Попытки экономически интерпретировать параметр a могут привести к абсурду, особенно при a < 0.

Интерпретировать можно лишь знак при параметре a. Если a < 0, то относительное изменение результата происходит медленнее, чем изменение фактора. Иными словами, вариация результата меньше вариации фактора - коэффициент вариации по фактору x выше коэффициента вариации для результата y: Vx > Vy. Для доказательства данного положения сравнимо относительные изменения фактора x и результата y:

Уравнение регрессии всегда дополняется показателем тесноты связи. При использовании линейной регрессии в качестве такого показателя выступает линейный коэффициент корреляции r xy . Имеются разные модификации формулы линейного коэффициента корреляции, например:

к чн = и * у ч. у н = сщм(чбн) . у ч * у н = нч - н * ч. у ч * у н (7)

Как известно, линейный коэффициент корреляции находиться в границах - 1 ? r xy ? 0.

Если коэффициент регрессии b > 0, то 0 ? r xy ? 1, и, наоборот, при b < 0 - 1 ? r xy ? 0.

Следует иметь в виду, что величина линейного коэффициента корреляции оценивает тесноту связи рассматриваемых признаков в ее линейной форме. Поэтому близость абсолютной величины линейного коэффициента корреляции к нулю еще не означает отсутствия связи между признаками. При иной спецификации модели связь между признаками может оказаться достаточно тесной.

Для оценки качества подбора линейной функции рассчитывается квадрат линейного коэффициента корреляции r 2 xy , называемый коэффициентом детерминации. Коэффициент детерминации характеризует долю дисперсии результативного признака у, объясняемую регрессией, в общей дисперсии результативного признака:

r 2 xy = у 2 y объясн. / у 2 y общ (8)

Соответственно величина 1 - r 2 характеризует долю дисперсии у, вызванную влиянием остальных, не учтенных в модели факторов.

Величина коэффициента детерминации является одним из критериев оценки качества линейной модели. Чем больше доля объясненной вариации, тем соответственно меньше роль прочих факторов и, следовательно, линейная модель хорошо аппроксимирует исходные данные, и ею можно воспользоваться для прогноза значений результативного признака. Линейный коэффициент корреляции по содержанию отличается от коэффициента регрессии. Выступая показателем силы связи, коэффициент регрессии b на первый взгляд может быть использован как измеритель ее тесноты. Величина коэффициента регрессии зависит от единиц измерения переменных, от размерности признаков. Кроме того, коэффициенты регрессии - величины именованные, и потому несравнимы для разных признаков.

Сделать коэффициенты регрессии сопоставимыми по разным признакам позволяет определение аналогичного показателя в стандартизованной системе единиц, где в качестве единицы измерения признака используется его среднее квадратическое отклонение (у). Поскольку коэффициент регрессии b имеет единицы измерения дробные (результат/фактор), то умножив, его на среднее квадратическое отклонение фактора х (у x) и разделив на среднее квадратическое отклонение результата (у y), получим показатель, пригодный для сравнения интенсивности изменения результата под влиянием разных факторов. Иными словами, мы придем к формуле линейного коэффициента корреляции:

r xy = b y/x * у x / у y

Его величина выступает в качестве стандартизованного коэффициента регрессии и характеризует среднее в сигмах (у y) изменение результата с изменением фактора на одну у x .

Линейный коэффициент корреляции как измеритель тесноты линейной связи признаков логически связан не только с коэффициентом регрессии b, но и с коэффициентом эластичности, который является показателем силы связи, выраженным в процентах. При линейной связи признаков х и у средний коэффициент эластичности в целом по совокупности определяется как

Э y/x = b y/x * x / y,

т.е. его формула по построению близка к формуле линейного коэффициента корреляции

r xy = b y/x * у x / у y ,

Как и линейный коэффициент корреляции, коэффициент эластичности сравним по разным признакам.

Если Э y/x = 0,8 %, а Э y/z = 0,2 % , то можно заключить, что фактор х в большей мере влияет на результат у, чем фактор z, ибо с ростом х на 1% у возрастает на 0,8 %, а с ростом z на 1 % - только на 0,2 %.

Несмотря на схожесть этих показателей, измерителем тесноты связи выступает линейный коэффициент корреляции (r xy), а коэффициент регрессии (b y/x) и коэффициент эластичности (Э y/x) - показатели силы связи: коэффициент регрессии является абсолютной мерой, ибо имеет единицы измерения, присущие изучаемым признакам у и х, а коэффициент эластичности - относительным показателем силы связи, потому что выражает в процентах.

Для пояснения тесноты связи рассмотрим рисунок 3. Несмотря на всю важность измерения тесноты связи, в эконометрике больший практический интерес приобретает коэффициент детерминации r 2 xy , ибо он дает относительную меру влияния фактора на результат, фиксируя одновременно и роль ошибок, т.е. случайных составляющих в формировании моделируемой переменной. Чем ближе коэффициент детерминации к 1 , тем в большей степени уравнение регрессии пригодно для прогнозирования.

Рис. 3 Типы корреляции

а - полная корреляция: r xy = 1; б - сильная корреляция: r xy ? 0,8: 0,9;

в - слабая корреляция: r xy ? 0,2

корреляция линейный нелинейный регрессия

Линейная регрессия сводится к нахождению уравнения вида:

(или

) (3)

) (3)

Первое выражение позволяет по заданным значениям фактора х рассчитать теоретические значения результативного признака, подставляя в него фактические значения факторах . На графике теоретические значения лежат на прямой, которые представляют собой линию регрессии.

Построение линейной регрессии сводится к оценке ее параметров - а иb . Классический подход к оцениванию параметров линейной регрессии основан на методе наименьших квадратов (МНК).

МНК позволяет получить такие оценки

параметров а

иb

,

при которых сумма квадратов отклонений

фактических значенийу

от

теоретических

минимальна:

минимальна:

,

или

,

или (4)

(4)

Для нахождения минимума надо вычислить частные производные суммы (4) по каждому из параметров - а иb - и приравнять их к нулю.

(5)

(5)

Преобразуем, получаем систему нормальных уравнений:

(6)

(6)

В этой системе n - объем выборки, суммы легко рассчитываются из исходных данных. Решаем систему относительноа иb , получаем:

(7)

(7)

(8)

(8)

Выражение (7) можно записать в другом виде:

(9)

(9)

где со

v

(х,у) -

ковариация признаков,

- дисперсия факторах

.

- дисперсия факторах

.

Параметр b называется коэффициентом регрессии. Его величина показывает среднее изменение результата с изменением фактора на одну единицу. Возможность четкой экономической интерпретации коэффициента регрессии сделала линейное уравнение парной регрессии достаточно распространенным в эконометрических исследованиях.

Формально а - значениеу прих=0. Еслих не имеет и не может иметь нулевого значения, то такая трактовка свободного членаа не имеет смысла. Параметра может не иметь экономического содержания. Попытки экономически интерпретировать его могут привести к абсурду, особенно приа < 0 . Интерпретировать можно лишь знак при параметреа . Еслиа > 0 , то относительное изменение результата происходит медленнее, чем изменение фактора. Сравним эти относительные изменения:

при.

при.

Иногда линейное уравнение парной регрессии записывают для отклонений от средних значений:

y′ = b·x" , (10)

где

,

, .

При этом свободный член равен нулю, что

и отражено в выражении (10). Этот факт

следует из геометрических соображений:

уравнению регрессии отвечает та же

прямая (3), но при оценке регрессии в

отклонениях начало координат перемещается

в точку с координатами

.

При этом свободный член равен нулю, что

и отражено в выражении (10). Этот факт

следует из геометрических соображений:

уравнению регрессии отвечает та же

прямая (3), но при оценке регрессии в

отклонениях начало координат перемещается

в точку с координатами .

При этом в выражении (8) обе суммы будут

равны нулю, что и повлечет равенство

нулю свободного члена.

.

При этом в выражении (8) обе суммы будут

равны нулю, что и повлечет равенство

нулю свободного члена.

Рассмотрим в качестве примера по группе предприятий, выпускающих один вид продукции, регрессионную зависимость издержек от выпуска продукции у = a + bx + ε.

Таблица 1

|

Выпуск продукции тыс.ед.(x ) |

Затраты на производство, млн.руб.(y ) |

x 2 |

y 2 |

|

|

Система нормальных уравнений будет иметь вид:

Решая её, получаем а = -5,79, b = 36,84.

Уравнение регрессии имеет вид:

Подставив в уравнение значения х , найдем теоретические значенияy (последняя колонка таблицы).

Величина а не имеет экономического смысла. Если переменныех иу выразить через отклонения от средних уровней, то линия регрессии на графике пройдет через начало координат. Оценка коэффициента регрессии при этом не изменится:

,

где

,

где ,

,

В качестве другого примера рассмотрим функцию потребления в виде:

С = К·у + L

где С - потребление,у -доход,K , L – параметры. Данное уравнение линейной регрессии обычно используется в увязке с балансовым равенством:

y = C + I – r,

где I – размер инвестиций,r – сбережения.

Для простоты предположим, что доход расходуется на потребление и инвестиции. Таким образом, рассматривается система уравнений:

Наличие балансового равенства накладывает ограничения на величину коэффициента регрессии, которая не может быть больше единицы, т.е. К ≤ 1.

Предположим, что функция потребления составила:

Коэффициент регрессии характеризует

склонность к потреблению. Он показывает,

что из каждой тысячи рублей дохода на

потребление расходуется в среднем 650

руб., а 350 руб. инвестируется. Если

рассчитать регрессию размера инвестиций

от дохода, т.е.

,

то уравнение регрессии составит

,

то уравнение регрессии составит .

Это уравнение можно и не определять,

поскольку оно выводится из функции

потребления. Коэффициенты регрессии

этих двух уравнений связаны равенством:

.

Это уравнение можно и не определять,

поскольку оно выводится из функции

потребления. Коэффициенты регрессии

этих двух уравнений связаны равенством:

Если коэффициент регрессии оказывается больше единицы, то у < С + 1, и на потребление расходуются не только доходы, но и сбережения.

Коэффициент регрессии в функции потребления используется для расчета мультипликатора:

.

.

Здесь m≈ 2,86, поэтому дополнительные вложения 1 тыс. руб. на длительный срок приведут при прочих равных условиях к дополнительному доходу 2,86 тыс. руб.

При линейной регрессии в качестве показателя тесноты связи выступает линейный коэффициент корреляции r :

(11)

(11)

Его значения находятся в границах: 0 < r ≤ 1 . Еслиb > 0 , то0 ≤ r ≤ 1 , приb < 0, – 1 ≤ r < 0 . По данным примераr =0,991, что означает очень тесную зависимость затрат на производство от величины объема выпускаемой продукции.

Для оценки качества подбора линейной функции рассчитывается коэффициент детерминации как квадрат линейного коэффициента корреляцииr 2 . Он характеризует долю дисперсии результативного признакаy , объясняемую регрессией, в общей дисперсии результативного признака:

12

12

Величина 1 - r 2 характеризует долю дисперсииу, вызванную влиянием остальных, не учтенных в модели факторов.

В примере σ 2 = 0,092. Уравнением регрессии объясняется 98,2% дисперсииу, а на прочие факторы приходится 1,8%, это остаточная дисперсия.