В этой статье речь будет идти о исследовании зависимости между признаками, или как больше нравится - случайными величинами, переменными. В частности, мы разберем как ввести меру зависимости между признаками, используя критерий Хи-квадрат и сравним её с коэффициентом корреляции.

Для чего это может понадобиться? К примеру, для того, чтобы понять какие признаки сильнее зависимы от целевой переменной при построении кредитного скоринга - определении вероятности дефолта клиента. Или, как в моем случае, понять какие показатели нобходимо использовать для программирования торгового робота.

Отдельно отмечу, что для анализа данных я использую язык c#. Возможно это все уже реализовано на R или Python, но использование c# для меня позволяет детально разобраться в теме, более того это мой любимый язык программирования.

Начнем с совсем простого примера, создадим в экселе четыре колонки, используя генератор случайных чисел:

X

=СЛУЧМЕЖДУ(-100;100)

Y

=X

*10+20

Z

=X

*X

T

=СЛУЧМЕЖДУ(-100;100)

Как видно, переменная Y линейно зависима от X ; переменная Z квадратично зависима от X ; переменные X и Т независимы. Такой выбор я сделал специально, потому что нашу меру зависимости мы будем сравнивать с коэффициентом корреляции . Как известно, между двумя случайными величинами он равен по модулю 1 если между ними самый «жесткий» вид зависимости - линейный. Между двумя независимыми случайными величинами корреляция нулевая, но из равенства коэффициента корреляции нулю не следует независимость . Далее мы это увидим на примере переменных X и Z .

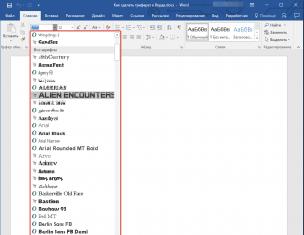

Сохраняем файл как data.csv и начинаем первые прикиди. Для начала рассчитаем коэффициент корреляции между величинами. Код в статью я вставлять не стал, он есть на моем github . Получаем корреляцию по всевозможным парам:

Видно, что у линейно зависимых X и Y коэффициент корреляции равен 1. А вот у X и Z он равен 0.01, хотя зависимость мы задали явную Z =X *X . Ясно, что нам нужна мера, которая «чувствует» зависимость лучше. Но прежде, чем переходить к критерию Хи-квадрат, давайте рассмотрим что такое матрица сопряженности.

Чтобы построить матрицу сопряженности мы разобьём диапазон значений переменных на интервалы (или категорируем). Есть много способов такого разбиения, при этом какого-то универсального не существует. Некоторые из них разбивают на интервалы так, чтобы в них попадало одинаковое количество переменных, другие разбивают на равные по длине интервалы. Мне лично по духу комбинировать эти подходы. Я решил воспользоваться таким способом: из переменной я вычитаю оценку мат. ожидания, потом полученное делю на оценку стандартного отклонения. Иными словами я центрирую и нормирую случайную величину. Полученное значение умножается на коэффициент (в этом примере он равен 1), после чего все округляется до целого. На выходе получается переменная типа int, являющаяся идентификатором класса.

Итак, возьмем наши признаки X и Z , категорируем описанным выше способом, после чего посчитаем количество и вероятности появления каждого класса и вероятности появления пар признаков:

Это матрица по количеству. Здесь в строках - количества появлений классов переменной X , в столбцах - количества появлений классов переменной Z , в клетках - количества появлений пар классов одновременно. К примеру, класс 0 встретился 865 раз для переменной X , 823 раза для переменной Z и ни разу не было пары (0,0). Перейдем к вероятностям, поделив все значения на 3000 (общее число наблюдений):

Получили матрицу сопряженности, полученную после категорирования признаков. Теперь пора задуматься над критерием. По определению, случайные величины независимы, если независимы сигма-алгебры , порожденные этими случайными величинами. Независимость сигма-алгебр подразумевает попарную независимость событий из них. Два события называются независимыми, если вероятность их совместного появления равна произведению вероятностей этих событий: Pij = Pi*Pj . Именно этой формулой мы будем пользоваться для построения критерия.

Нулевая гипотеза : категорированные признаки X и Z независимы. Эквивалентная ей: распределение матрицы сопряженности задается исключительно вероятностями появления классов переменных (вероятности строк и столбцов). Или так: ячейки матрицы находятся произведением соответствующих вероятностей строк и столбцов. Эту формулировку нулевой гипотезы мы будем использовать для построения решающего правила: существенное расхождение между Pij и Pi*Pj будет являться основанием для отклонения нулевой гипотезы.

Пусть - вероятность появления класса 0 у переменной X

. Всего у нас n

классов у X

и m

классов у Z

. Получается, чтобы задать распределение матрицы нам нужно знать эти n

и m

вероятностей. Но на самом деле если мы знаем n-1

вероятность для X

, то последняя находится вычитанием из 1 суммы других. Таким образом для нахождения распределения матрицы сопряженности нам надо знать l=(n-1)+(m-1)

значений. Или мы имеем l

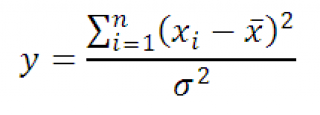

-мерное параметрическое пространство, вектор из которого задает нам наше искомое распределение. Статистика Хи-квадрат будет иметь следующий вид:

и, согласно теореме Фишера, иметь распределение Хи-квадрат с n*m-l-1=(n-1)(m-1)

степенями свободы.

Зададимся уровнем значимости 0.95 (или вероятность ошибки первого рода равна 0.05). Найдем квантиль распределения Хи квадрат для данного уровня значимости и степеней свободы из примера (n-1)(m-1)=4*3=12 : 21.02606982. Сама статистика Хи-квадрат для переменных X и Z равна 4088.006631. Видно, что гипотеза о независимости не принимается. Удобно рассматривать отношение статистики Хи-квадрат к пороговому значению - в данном случае оно равно Chi2Coeff=194.4256186 . Если это отношение меньше 1, то гипотеза о независимости принимается, если больше, то нет. Найдем это отношение для всех пар признаков:

Здесь Factor1

и Factor2

- имена признаков

src_cnt1

и src_cnt2

- количество уникальных значений исходных признаков

mod_cnt1

и mod_cnt2

- количество уникальных значений признаков после категорирования

chi2

- статистика Хи-квадрат

chi2max

- пороговое значение статистики Хи-квадрат для уровня значимости 0.95

chi2Coeff

- отношение статистики Хи-квадрат к пороговому значению

corr

- коэффициент корреляции

Видно, что независимы (chi2coeff<1) получились следующие пары признаков - (X,T ), (Y,T ) и (Z,T ), что логично, так как переменная T генерируется случайно. Переменные X и Z зависимы, но менее, чем линейно зависимые X и Y , что тоже логично.

Код утилиты, рассчитывающей данные показатели я выложил на github, там же файл data.csv. Утилита принимает на вход csv-файл и высчитывает зависимости между всеми парами колонок: PtProject.Dependency.exe data.csv

Критерий χ 2 Пирсона – это непараметрический метод, который позволяет оценить значимость различий между фактическим (выявленным в результате исследования) количеством исходов или качественных характеристик выборки, попадающих в каждую категорию, и теоретическим количеством, которое можно ожидать в изучаемых группах при справедливости нулевой гипотезы. Выражаясь проще, метод позволяет оценить статистическую значимость различий двух или нескольких относительных показателей (частот, долей).

1. История разработки критерия χ 2

Критерий хи-квадрат для анализа таблиц сопряженности был разработан и предложен в 1900 году английским математиком, статистиком, биологом и философом, основателем математической статистики и одним из основоположников биометрики Карлом Пирсоном (1857-1936).

2. Для чего используется критерий χ 2 Пирсона?

Критерий хи-квадрат может применяться при анализе таблиц сопряженности , содержащих сведения о частоте исходов в зависимости от наличия фактора риска. Например, четырехпольная таблица сопряженности выглядит следующим образом:

| Исход есть (1) | Исхода нет (0) | Всего | |

| Фактор риска есть (1) | A | B | A + B |

| Фактор риска отсутствует (0) | C | D | C + D |

| Всего | A + C | B + D | A + B + C + D |

Как заполнить такую таблицу сопряженности? Рассмотрим небольшой пример.

Проводится исследование влияния курения на риск развития артериальной гипертонии. Для этого были отобраны две группы исследуемых - в первую вошли 70 человек, ежедневно выкуривающих не менее 1 пачки сигарет, во вторую - 80 некурящих такого же возраста. В первой группе у 40 человек отмечалось повышенное артериальное давление. Во второй - артериальная гипертония наблюдалась у 32 человек. Соответственно, нормальное артериальное давление в группе курильщиков было у 30 человек (70 - 40 = 30) а в группе некурящих - у 48 (80 - 32 = 48).

Заполняем исходными данными четырехпольную таблицу сопряженности:

В полученной таблице сопряженности каждая строчка соответствует определенной группе исследуемых. Столбцы - показывают число лиц с артериальной гипертонией или с нормальным артериальным давлением.

Задача, которая ставится перед исследователем: имеются ли статистически значимые различия между частотой лиц с артериальным давлением среди курящих и некурящих? Ответить на этот вопрос можно, рассчитав критерий хи-квадрат Пирсона и сравнив получившееся значение с критическим.

3. Условия и ограничения применения критерия хи-квадрат Пирсона

- Сопоставляемые показатели должны быть измерены в номинальной шкале (например, пол пациента - мужской или женский) или в порядковой (например, степень артериальной гипертензии, принимающая значения от 0 до 3).

- Данный метод позволяет проводить анализ не только четырехпольных таблиц, когда и фактор, и исход являются бинарными переменными, то есть имеют только два возможных значения (например, мужской или женский пол, наличие или отсутствие определенного заболевания в анамнезе...). Критерий хи-квадрат Пирсона может применяться и в случае анализа многопольных таблиц, когда фактор и (или) исход принимают три и более значений.

- Сопоставляемые группы должны быть независимыми, то есть критерий хи-квадрат не должен применяться при сравнении наблюдений "до-"после". В этих случаях проводится тест Мак-Немара (при сравнении двух связанных совокупностей) или рассчитывается Q-критерий Кохрена (в случае сравнения трех и более групп).

- При анализе четырехпольных таблиц ожидаемые значения в каждой из ячеек должны быть не менее 10. В том случае, если хотя бы в одной ячейке ожидаемое явление принимает значение от 5 до 9, критерий хи-квадрат должен рассчитываться с поправкой Йейтса . Если хотя бы в одной ячейке ожидаемое явление меньше 5, то для анализа должен использоваться точный критерий Фишера .

- В случае анализа многопольных таблиц ожидаемое число наблюдений не должно принимать значения менее 5 более чем в 20% ячеек.

4. Как рассчитать критерий хи-квадрат Пирсона?

Для расчета критерия хи-квадрат необходимо:

Данный алгоритм применим как для четырехпольных, так и для многопольных таблиц.

5. Как интерпретировать значение критерия хи-квадрат Пирсона?

В том случае, если полученное значение критерия χ 2 больше критического, делаем вывод о наличии статистической взаимосвязи между изучаемым фактором риска и исходом при соответствующем уровне значимости.

6. Пример расчета критерия хи-квадрат Пирсона

Определим статистическую значимость влияния фактора курения на частоту случаев артериальной гипертонии по рассмотренной выше таблице:

- Рассчитываем ожидаемые значения для каждой ячейки:

- Находим значение критерия хи-квадрат Пирсона:

χ 2 = (40-33.6) 2 /33.6 + (30-36.4) 2 /36.4 + (32-38.4) 2 /38.4 + (48-41.6) 2 /41.6 = 4.396.

- Число степеней свободы f = (2-1)*(2-1) = 1. Находим по таблице критическое значение критерия хи-квадрат Пирсона, которое при уровне значимости p=0.05 и числе степеней свободы 1 составляет 3.841.

- Сравниваем полученное значение критерия хи-квадрат с критическим: 4.396 > 3.841, следовательно зависимость частоты случаев артериальной гипертонии от наличия курения - статистически значима. Уровень значимости данной взаимосвязи соответствует p<0.05.

1. Сопоставляемые показатели должны быть измерены в номинальной шкале (например, пол пациента - мужской или женский) или в порядковой (например, степень артериальной гипертензии, принимающая значения от 0 до 3).

2. Данный метод позволяет проводить анализ не только четырехпольных таблиц, когда и фактор, и исход являются бинарными переменными, то есть имеют только два возможных значения (например, мужской или женский пол, наличие или отсутствие определенного заболевания в анамнезе...). Критерий хи-квадрат Пирсона может применяться и в случае анализа многопольных таблиц, когда фактор и (или) исход принимают три и более значений.

3. Сопоставляемые группы должны быть независимыми, то есть критерий хи-квадрат не должен применяться при сравнении наблюдений "до-"после". В этих случаях проводится тест Мак-Немара (при сравнении двух связанных совокупностей) или рассчитывается Q-критерий Кохрена (в случае сравнения трех и более групп).

4. При анализе четырехпольных таблиц ожидаемые значения в каждой из ячеек должны быть не менее 10. В том случае, если хотя бы в одной ячейке ожидаемое явление принимает значение от 5 до 9, критерий хи-квадрат должен рассчитываться с поправкой Йейтса . Если хотя бы в одной ячейке ожидаемое явление меньше 5, то для анализа должен использоваться точный критерий Фишера .

5. В случае анализа многопольных таблиц ожидаемое число наблюдений не должно принимать значения менее 5 более чем в 20% ячеек.

Для расчета критерия хи-квадрат необходимо:

1. Рассчитываем ожидаемое количество наблюдений для каждой из ячеек таблицы сопряженности (при условии справедливости нулевой гипотезы об отсутствии взаимосвязи) путем перемножения сумм рядов и столбцов с последующим делением полученного произведения на общее число наблюдений. Общий вид таблицы ожидаемых значений представлен ниже:

| Исход есть (1) | Исхода нет (0) | Всего | |

| Фактор риска есть (1) | (A+B)*(A+C) / (A+B+C+D) | (A+B)*(B+D)/ (A+B+C+D) | A + B |

| Фактор риска отсутствует (0) | (C+D)*(A+C)/ (A+B+C+D) | (C+D)*(B+D)/ (A+B+C+D) | C + D |

| Всего | A + C | B + D | A+B+C+D |

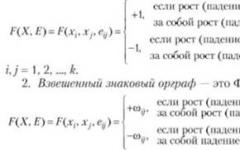

2. Находим значение критерия χ 2 по следующей формуле:

где i – номер строки (от 1 до r), j – номер столбца (от 1 до с), O ij – фактическое количество наблюдений в ячейке ij, E ij – ожидаемое число наблюдений в ячейке ij.

В том случае, если число ожидаемого явления меньше 10 хотя бы в одной ячейке, при анализе четырехпольных таблиц должен рассчитываться критерий хи-квадрат с поправкой Йейтса . Данная поправка позволяет уменьшить вероятность ошибки первого типа, т.е обнаружения различий там, где их нет. Поправка Йейтса заключается в вычитании 0,5 из абсолютного значения разности между фактическим и ожидаемым количеством наблюдений в каждой ячейке, что ведет к уменьшению величины критерия хи-квадрат.

Формула для расчета критерия χ 2 с поправкой Йейтса следующая:

3. Определяем число степеней свободы по формуле: f = (r – 1) × (c – 1) . Ссответственно, для четырехпольной таблицы, в которой 2 ряда (r = 2) и 2 столбца (c = 2), число степеней свободы составляет f 2x2 = (2 - 1)*(2 - 1) = 1.

4. Сравниваем значение критерия χ 2 с критическим значением при числе степеней свободы f (по таблице).

Данный алгоритм применим как для четырехпольных, так и для многопольных таблиц.

Как интерпретировать значение критерия хи-квадрат Пирсона?

В том случае, если полученное значение критерия χ 2 больше критического, делаем вывод о наличии статистической взаимосвязи между изучаемым фактором риска и исходом при соответствующем уровне значимости.

Пример расчета критерия хи-квадрат Пирсона

Определим статистическую значимость влияния фактора курения на частоту случаев артериальной гипертонии по рассмотренной выше таблице:

1. Рассчитываем ожидаемые значения для каждой ячейки:

2. Находим значение критерия хи-квадрат Пирсона:

χ 2 = (40-33.6) 2 /33.6 + (30-36.4) 2 /36.4 + (32-38.4) 2 /38.4 + (48-41.6) 2 /41.6 = 4.396.

3. Число степеней свободы f = (2-1)*(2-1) = 1. Находим по таблице критическое значение критерия хи-квадрат Пирсона, которое при уровне значимости p=0.05 и числе степеней свободы 1 составляет 3.841.

4. Сравниваем полученное значение критерия хи-квадрат с критическим: 4.396 > 3.841, следовательно зависимость частоты случаев артериальной гипертонии от наличия курения - статистически значима. Уровень значимости данной взаимосвязи соответствует p<0.05.

| Число степеней свободы, f | χ 2 при p=0.05 | χ 2 при p=0.01 |

| 3.841 | 6.635 | |

| 5.991 | 9.21 | |

| 7.815 | 11.345 | |

| 9.488 | 13.277 | |

| 11.07 | 15.086 | |

| 12.592 | 16.812 | |

| 14.067 | 18.475 | |

| 15.507 | 20.09 | |

| 16.919 | 21.666 | |

| 18.307 | 23.209 | |

| 19.675 | 24.725 | |

| 21.026 | 26.217 | |

| 22.362 | 27.688 | |

| 23.685 | 29.141 | |

| 24.996 | 30.578 | |

| 26.296 | ||

| 27.587 | 33.409 | |

| 28.869 | 34.805 | |

| 30.144 | 36.191 | |

| 31.41 | 37.566 |

Рассмотрим Распределение ХИ-квадрат. С помощью функции MS EXCEL ХИ2.РАСП() построим графики функции распределения и плотности вероятности, поясним применение этого распределения для целей математической статистики.

Распределение ХИ-квадрат (Х 2 , ХИ2, англ. Chi - squared distribution ) применяется в различных методах математической статистики:

- при построении ;

- при ;

- при (согласуются ли эмпирические данные с нашим предположением о теоретической функции распределения или нет, англ. Goodness-of-fit)

- при (используется для определения связи между двумя категориальными переменными, англ. Chi-square test of association).

Определение : Если x 1 , x 2 , …, x n независимые случайные величины, распределенные по N(0;1), то распределение случайной величины Y=x 1 2 + x 2 2 +…+ x n 2 имеет распределение Х 2 с n степенями свободы.

Распределение Х 2 зависит от одного параметра, который называется степенью свободы (df , degrees of freedom ). Например, при построении число степеней свободы равно df=n-1, где n – размер выборки .

Плотность распределения

Х 2

выражается формулой:

Графики функций

Распределение Х 2 имеет несимметричную форму, равно n, равна 2n.

В файле примера на листе График приведены графики плотности распределения вероятности и интегральной функции распределения .

Полезное свойство ХИ2-распределения

Пусть x 1 , x 2 , …, x n независимые случайные величины, распределенные по нормальному закону

с одинаковыми параметрами μ и σ, а X cр

является арифметическим средним

этих величин x.

Тогда случайная величина y

равная

Имеет Х 2 -распределение с n-1 степенью свободы. Используя определение вышеуказанное выражение можно переписать следующим образом:

Следовательно, выборочное распределение статистики y, при выборке из нормального распределения , имеет Х 2 -распределение с n-1 степенью свободы.

Это свойство нам потребуется при . Т.к. дисперсия может быть только положительным числом, а Х 2 -распределение используется для его оценки, то y д.б. >0, как и указано в определении.

ХИ2-распределение в MS EXCEL

В MS EXCEL, начиная с версии 2010, для Х 2 -распределения имеется специальная функция ХИ2.РАСП() , английское название – CHISQ.DIST(), которая позволяет вычислить плотность вероятности (см. формулу выше) и (вероятность, что случайная величина Х, имеющая ХИ2 -распределение , примет значение меньше или равное х, P{X <= x}).

Примечание : Т.к. ХИ2-распределение является частным случаем , то формула =ГАММА.РАСП(x;n/2;2;ИСТИНА) для целого положительного n возвращает тот же результат, что и формула =ХИ2.РАСП(x;n; ИСТИНА) или =1-ХИ2.РАСП.ПХ(x;n) . А формула =ГАММА.РАСП(x;n/2;2;ЛОЖЬ) возвращает тот же результат, что и формула =ХИ2.РАСП(x;n; ЛОЖЬ) , т.е. плотность вероятности ХИ2-распределения.

Функция ХИ2.РАСП.ПХ()

возвращает функцию распределения

, точнее - правостороннюю вероятность, т.е. P{X > x}. Очевидно, что справедливо равенство

=ХИ2.РАСП.ПХ(x;n)+ ХИ2.РАСП(x;n;ИСТИНА)=1

т.к. первое слагаемое вычисляет вероятность P{X > x}, а второе P{X <= x}.

До MS EXCEL 2010 в EXCEL была только функция ХИ2РАСП() , которая позволяет вычислить правостороннюю вероятность, т.е. P{X > x}. Возможности новых функций MS EXCEL 2010 ХИ2.РАСП() и ХИ2.РАСП.ПХ() перекрывают возможности этой функции. Функция ХИ2РАСП() оставлена в MS EXCEL 2010 для совместимости.

ХИ2.РАСП() является единственной функцией, которая возвращает плотность вероятности ХИ2-распределения (третий аргумент должен быть равным ЛОЖЬ). Остальные функции возвращают интегральную функцию распределения , т.е. вероятность того, что случайная величина примет значение из указанного диапазона: P{X <= x}.

Вышеуказанные функции MS EXCEL приведены в .

Примеры

Найдем вероятность, что случайная величина Х примет значение меньше или равное заданного x : P{X <= x}. Это можно сделать несколькими функциями:

ХИ2.РАСП(x; n; ИСТИНА)

=1-ХИ2.РАСП.ПХ(x; n)

=1-ХИ2РАСП(x; n)

Функция ХИ2.РАСП.ПХ() возвращает вероятность P{X > x}, так называемую правостороннюю вероятность, поэтому, чтобы найти P{X <= x}, необходимо вычесть ее результат от 1.

Найдем вероятность, что случайная величина Х примет значение больше заданного x : P{X > x}. Это можно сделать несколькими функциями:

1-ХИ2.РАСП(x; n; ИСТИНА)

=ХИ2.РАСП.ПХ(x; n)

=ХИ2РАСП(x; n)

Обратная функция ХИ2-распределения

Обратная функция используется для вычисления альфа - , т.е. для вычисления значений x при заданной вероятности альфа , причем х должен удовлетворять выражению P{X <= x}=альфа .

Функция ХИ2.ОБР() используется для вычисления доверительных интервалов дисперсии нормального распределения .

Функция ХИ2.ОБР.ПХ() используется для вычисления , т.е. если в качестве аргумента функции указан уровень значимости, например 0,05, то функция вернет такое значение случайной величины х, для которого P{X>x}=0,05. В качестве сравнения: функция ХИ2.ОБР() вернет такое значение случайной величины х, для которого P{X<=x}=0,05.

В MS EXCEL 2007 и ранее вместо ХИ2.ОБР.ПХ() использовалась функция ХИ2ОБР() .

Вышеуказанные функции можно взаимозаменять, т.к. следующие формулы возвращают один и тот же результат:

=ХИ.ОБР(альфа;n)

=ХИ2.ОБР.ПХ(1-альфа;n)

=ХИ2ОБР(1- альфа;n)

Некоторые примеры расчетов приведены в файле примера на листе Функции .

Функции MS EXCEL, использующие ХИ2-распределение

Ниже приведено соответствие русских и английских названий функций:

ХИ2.РАСП.ПХ()

- англ. название CHISQ.DIST.RT, т.е. CHI-SQuared DISTribution Right Tail, the right-tailed Chi-square(d) distribution

ХИ2.ОБР()

- англ. название CHISQ.INV, т.е. CHI-SQuared distribution INVerse

ХИ2.ПХ.ОБР()

- англ. название CHISQ.INV.RT, т.е. CHI-SQuared distribution INVerse Right Tail

ХИ2РАСП()

- англ. название CHIDIST, функция эквивалентна CHISQ.DIST.RT

ХИ2ОБР()

- англ. название CHIINV, т.е. CHI-SQuared distribution INVerse

Оценка параметров распределения

Т.к. обычно ХИ2-распределение используется для целей математической статистики (вычисление доверительных интервалов, проверки гипотез и др.), и практически никогда для построения моделей реальных величин, то для этого распределения обсуждение оценки параметров распределения здесь не производится.

Приближение ХИ2-распределения нормальным распределением

При числе степеней свободы n>30 распределение Х 2

хорошо аппроксимируется нормальным распределением

со средним значением

μ=n и дисперсией σ

=2*n (см. файл примера лист Приближение

).

При проведении теста хи-квадрат проверяется взаимная независимость двух переменных таблицы сопряженности и благодаря этому косвенно выясняется зависимость обоих переменных. Две переменные считаются взаимно независимыми, если наблюдаемые частоты (f 0) в ячейках совпадают с ожидаемыми частотами (f e).

Для того, чтобы провести тест хи-квадрат с помощью SPSS, выполните следующие действия:

- Выберите в меню команды Analyze (Анализ) › Descriptive Statistics (Дескриптивные статистики) › Crosstabs… (Таблицы сопряженности)

- Кнопкой Reset (Сброс) удалите возможные настройки.

- Перенесите переменную sex в список строк, а переменную psyche - в список столбцов.

- Щелкните на кнопке Cells… (Ячейки). В диалоговом окне установите, кроме предлагаемого по умолчанию флажка Observed , еще флажки Expected и Standardized . Подтвердите выбор кнопкой Continue .

- Щелкните на кнопке Statistics… (Статистика).

Откроется описанное выше диалоговое окно Crosstabs: Statistics .

- Установите флажок Chi-square (Хи-квадрат). Щелкните на кнопке Continue , а в главном диалоговом окне - на ОК .

Вы получите следующую таблицу сопряженности.

Пол * Психическое состояние. Таблица сопряженности .

| Психическое состояние | Total | ||||||

| Крайне неустойчивое | Неустойчивое | Устойчивое | Очень устойчивое | ||||

| Пол | женский | Count | 16 | 18 | 9 | 1 | 44 |

| Expected Count | 7.9 | 16.6 | 17.0 | 2.5 | 44.0 | ||

| Std. Residual | 2.9 | 0.3 | -1.9 | -0.9 | |||

| Мужской | Count | 3 | 22 | 32 | 5 | 62 | |

| Expected Count | 11.1 | 23.4 | 24.0 | 3.5 | 62.0 | ||

| Std. Residual | -2.4 | -0.3 | 1.6 | 0.8 | |||

| Total | Count | 19 | 40 | 41 | 6 | 106 | |

| Expected Count | 19.0 | 40.0 | 41.0 | 6.0 | 106.0 | ||

Кроме того, в окне просмотра будут показаны результаты теста хи-квадрат:

Chi-Square Tests (Тесты хи-квадрат)

- а. 2 cells (25.0%) have expected count less than 5. The minimum expected count is 2.49 (2 ячейки (25%) имеют ожидаемую частоту менее 5. Минимальная ожидаемая частота 2.49.)

Для вычисления критерия хи-квадрат применяются три различных подхода: формула Пирсона, поправка на правдоподобие и тест Мантеля-Хэнзеля. Если таблица сопряженности имеет четыре поля и ожидаемая вероятность менее 5, дополнительно выполняется точный тест Фишера.

Критерий хи-квадрат по Пирсону

Обычно для вычисления критерия хи-квадрат используется формула Пирсона:

Здесь вычисляется сумма квадратов стандартизованных остатков по всем полям таблицы сопряженности. Поэтому поля с более высоким стандартизованным остатком вносят более весомый вклад в численное значение критерия хи-квадрат и, следовательно, - в значимый результат. Согласно правилу, приведенному в разделе 8.7.2, стандартизованный остаток 2 или более указывает на значимое расхождение между наблюдаемой и ожидаемой частотами.

В рассматриваемом нами примере формула Пирсона дает максимально значимую величину критерия хи-квадрат (р<0.001). Если рассмотреть стандартизованные остатки в отдельных полях таблицы сопряженности, то на основе вышеприведенного правила можно сделать вывод, что эта значимость в основном определяется полями, в которых переменная psyche имеет значение "крайне неустойчивое". У женщин это значение сильно повышено, а у мужчин - понижено.

Корректность проведения теста хи-квадрат определяется двумя условиями: во-первых, ожидаемые частоты < 5 должны встречаться не более чем в 20% полей таблицы; во-вторых, суммы по строкам и столбцам всегда должны быть больше нуля.

Однако в рассматриваемом примере это условие выполняется не полностью. Как указывает примечание после таблицы теста хи-квадрат, 25% полей имеют ожидаемую частоту менее 5. Однако, так как допустимый предел4в 20% превышен лишь ненамного и эти поля, вследствие своего очень малого стандартизованного остатка, вносят весьма незначительную долю в величину критерия хи-квадрат, это нарушение можно считать несущественным.

Критерий хи-квадрат с поправкой на правдоподобие

Альтернативой формуле Пирсона для вычисления критерия хи-квадрат является поправка на правдоподобие:

При большом объеме выборки формула Пирсона и подправленная формула дают очень близкие результаты. В нашем примере критерий хи-квадрат с поправкой на правдоподобие составляет 23.688.

Тест Мантеля-Хэнзеля

Дополнительно в таблице сопряженности под обозначением linear-by-linear ("линейный-по-линейному") выводится значение теста Мантеля-Хэнзеля (20.391). Эта форма критерия хи-квадрат с поправкой Мантеля-Хэнзеля - еще одна мера линейной зависимости между строками и столбцами таблицы сопряженности. Она определяется как произведение коэффициента корреляции Пирсона на количество наблюдений, уменьшенное на единицу:

![]()

Полученный таким образом критерий имеет одну степень свободы. Метод Мантеля-Хэнзеля используется всегда, когда в диалоговом окне Crosstabs: Statistics установлен флажок Chi-square . Однако для данных, относящихся к с номинальной шкале, этот критерий неприменим.